4 月 29 日,部分用户发现 DeepSeek 网页版和 App 悄然上线了 "识图模式",支持上传图片进行内容理解与分析。这一功能的灰度测试,标志着 DeepSeek 从纯文本对话正式迈向多模态交互。

"Now, we see you"—— 鲸鱼摘下眼罩

就在功能上线当日,DeepSeek 多模态团队负责人陈小康在 X 平台发布了一条极具象征意义的动态:"Now, we see you. 👀",配图是两只 DeepSeek 标志性鲸鱼 —— 一只仍戴着眼罩,另一只已经摘下眼罩、睁眼视物。

这并非偶然。前一日(4 月 28 日),陈小康曾发布 "Soon, we see you" 后迅速删除。从 "Soon" 到 "Now",短短 24 小时,DeepSeek 完成了从预告到落地的全过程。

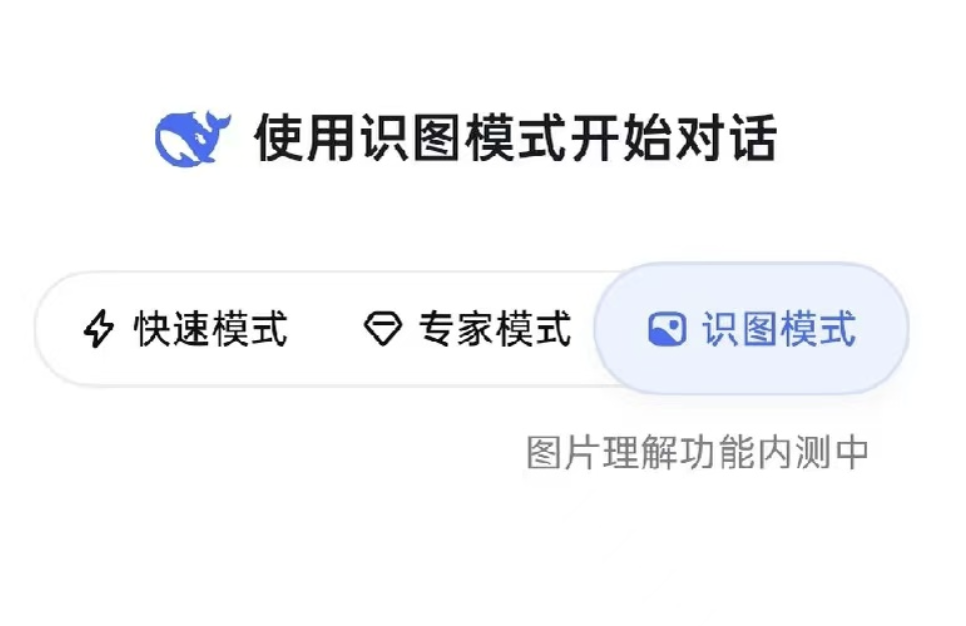

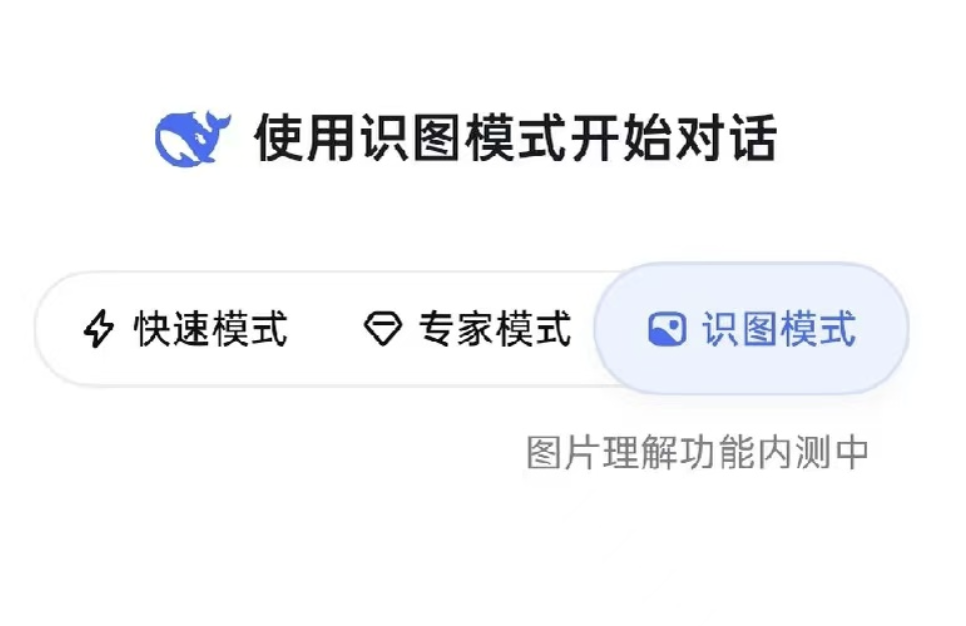

在 DeepSeek App 和网页版的对话界面中,部分用户可以看到新增了一个 "识图模式" 按钮,与月初上线的 "快速模式" 和 "专家模式" 并列。界面标注 "图片理解功能内测中",欢迎语为 "使用识图模式开始对话"。用户上传图片后,DeepSeek 能够输出结构化的图片描述,涵盖人物、场景、动作、颜色、文字(OCR)等多个维度。与此前 "专家模式" 仅能提取图片中的文字不同,识图模式具备真正的视觉理解能力。

技术定位:V4 主干上的视觉模块

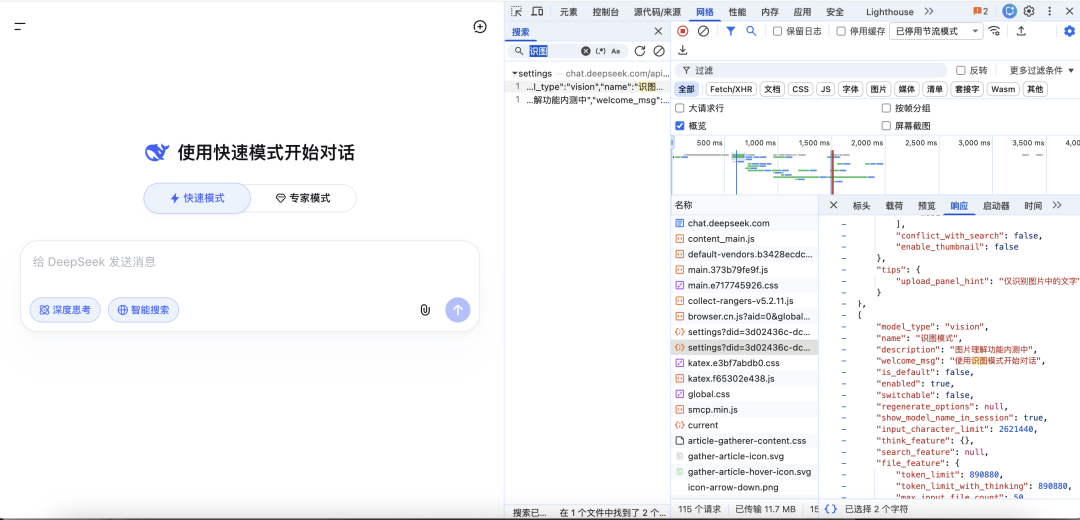

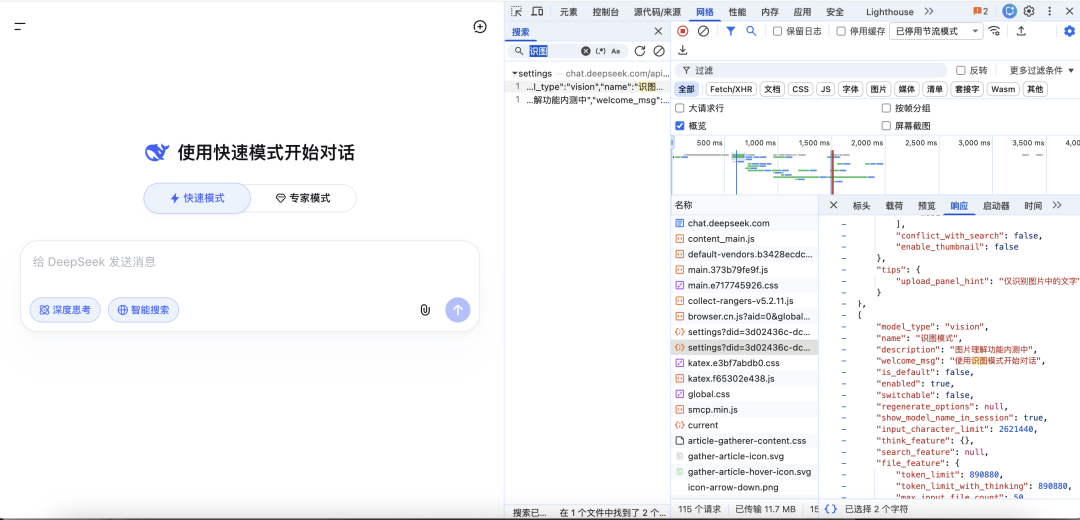

根据开发者工具抓取到的后端配置,识图模式的 model_type 为 "vision",name 为 "识图模式",description 为 "图片理解功能内测中"。该配置已启用(enabled: true),但默认关闭且不可手动切换,印证了灰度测试的特性。

值得注意的是,4 月 24 日发布的 DeepSeek V4(Pro 版 1.6T 参数、Flash 版 284B 参数)仍为纯文本模型,技术报告明确下一步将 "融入多模态能力"。因此,当前的识图模式更接近于挂载在 V4 上的视觉理解模块,而非原生多模态生成模型。

团队背景与人才变动

陈小康是 DeepSeek 多模态方向的核心研究者,北京大学博士毕业,研究领域涵盖视觉 - 语言模型、目标检测、语义分割等。他主导了 DeepSeek-VL2、Janus-Pro 等多模态模型的研发工作。

不过,DeepSeek 多模态团队近期经历了人才流失:4 月 12 日,元戎启行确认前 DeepSeek 多模态研究员阮翀加盟;另一位核心成员魏浩然也在春节前后离职。此次识图模式的灰度上线,是团队近三个月来首次释放产品进展信号。

开放范围与展望

目前识图模式仅限部分用户可见,尚未全量推送。有用户虽然看到了按钮,但点击后收到提示 "识图模式暂不可用,请稍后再试"。官方未明确说明开放范围及时间表,但从陈小康 "Soon→Now" 的预告节奏判断,更大范围的开放可能在数日之内。

从纯文本到图文交互,DeepSeek 的这一步虽然来得比 GPT-4V、Claude 等竞品晚了一些,但凭借 V4 强大的文本基座能力,其多模态理解的表现仍然值得期待。

参考来源:

https://www.tmtpost.com/nictation/7971982.html

https://finance.sina.com.cn/tech/roll/2026-04-29/doc-inhwefuw7911461.shtml