来源商业新知网,原标题:简单粗暴!一文理解Skip-Gram上下文的预测算法

自然语言处理属于人工智能领域,它将人类语言当做文本或语音来处理,以使计算机和人类更相似,是人工智能最复杂的领域之一。 由于人类的语言数据格式没有固定的规则和条理,机器往往很难理解原始文本。

要想使机器能从原始文本中学习,就需要将数据转换成计算机易于处理的向量格式,这个过程叫做词表示法。

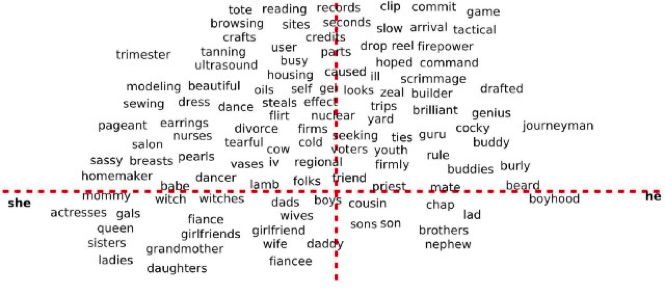

![1_jpeg 1_jpeg]()

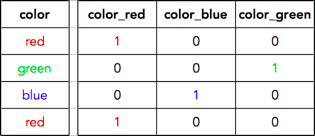

词向量

词表示法在向量空间内表达词语。 所以,如果词向量之间距离较近,这就意味着这些词是相互关联的。 在上图中,可以看到与女性有关的词语聚集在左边,而与男性有关的词语聚集在右边。 所以,如果我们给出“耳环”这种词语,电脑会把它和女性联系起来,这在逻辑上是正确的。

语言的词汇量很大,人类难以对其进行一一分类和标识; 因此我们需要使用无监督学习技术,该技术可以独立学习词语的上下文。 无监督学习是指: 没有标注的训练数据集,需要根据样本间的规律统计对样本进行分析,常见如任务聚类等。 Skip-gram就是一种无监督学习技术,常用于查找给定单词的最相关词语。

Skip-gram用于预测与给定中心词相对应的上下文词。 它和连续词袋模型(CBOW)算法相反。 在Skip-gram中,中心词是输入词(input word),上下文词是输出词(output word)。 因为要预测多个上下文词,所以这一过程比较困难。

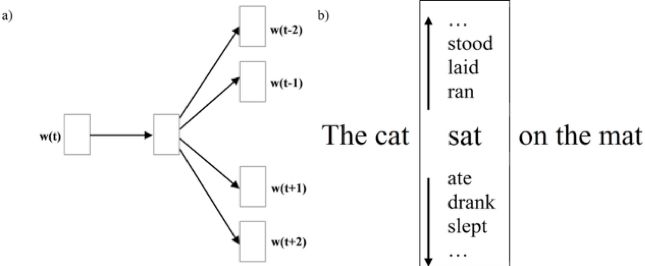

![2_jpeg 2_jpeg]()

Skip-gram示例

给定 “sat” 一词后,鉴于sat位于0位,我们会尝试在-1位上预测单词 “cat” ,在3位上预测单词 “mat” 。 我们不预测常用词和停用词,比如 “the”。

**架构

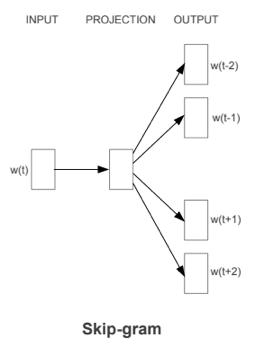

![3 3]()

Skip-gram模型架构

上图中,w(t)就是中心词,也叫给定输入词。 其中有一个隐藏层,它执行权重矩阵和输入向量w(t)之间的点积运算。 隐藏层中不使用激活函数。 现在,隐藏层中的点积运算结果被传递到输出层。 输出层计算隐藏层输出向量和输出层权重矩阵之间的点积。 然后用softmax激活函数来计算在给定上下文位置中,单词出现在w(t)上下文中的概率。

使用到的变量

- 在数据库或文本中出现的特殊单词的汇总词典。 这个词典就叫做词汇量,是系统的已知词。 词汇量用字母“v”来表示。

- “N”代表隐藏层中神经元的数量。

- 窗口大小就是预测单词的最大的上下文位置。 “c” 代表窗口大小。 比如,在给定的架构图中窗口大小为2,因此,我们会在 (t-2), (t-1), (t+1) 和 (t+2) 的上下文位置中预测单词。

- 上下文窗口是指会在给定词的范围内出现的、要预测的单词数量。 对于2*c的并且由K表示的窗口大小来说,上下文窗口值是该窗口大小的两倍。 给定图像的上下文窗口值是4。

- 输入向量的维度等于|V|。 每个单词都要进行one-hot编码。

- 隐藏层的权重矩阵(W)的维度是[|V|, N]。 “||” 是把数组值还原的模函数。

- 隐藏层的输出向量是H[N]。

- 隐藏层和输出层之间的权重矩阵 (W’) 维度是[N,|V|]。

- W’和H之间的点积生成输出向量U[|v|]。

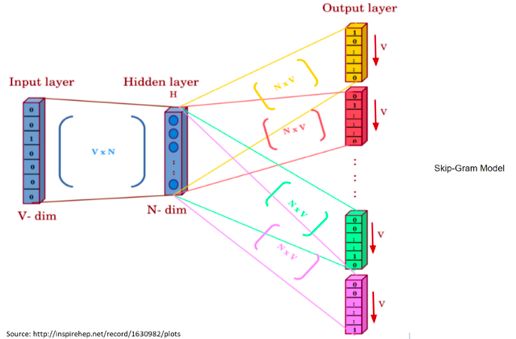

![4_jpeg 4_jpeg]()

N = 上下文窗口

工作步骤

- 利用one-hot编码将单词转换为向量,这些向量的维度是 [1,|v|]。

![5 5]()

one-hot编码

- 单词w(t)从|V|神经元被传递到隐藏层。

- 隐藏层执行权重向量W[|v|, N] 和输入向量w(t)之间的点积运算。 这里,我们可以总结出: 第(t)行的W[|v|, N] 会输出(H[1, N])。

- 谨记: 隐藏层不使用激活函数,所以H[1,k] 会直接传递到输出层。

- 输出层会执行 H[1, N] 和 W’[N, |v|] 之间的点积运算,并给出向量 U 。

- 现在,要得出每个向量的概率,我们要使用softmax函数,因为每次迭代都得出输出向量U,这是一种one-hot编码模式。

- 概率最大的那个单词就是最终结果。 如果在指定上下文位置中预测的单词是错误的,我们会使用反向传播算法来修正权重向量W和W’。

以上步骤对字典中的每个单词w(t) 都要执行。 而且,每个单词w(t) 会被传递K次。 所以我们可以得知,正向传播算法在每段时间内会执行 |v|*k次。

概率函数

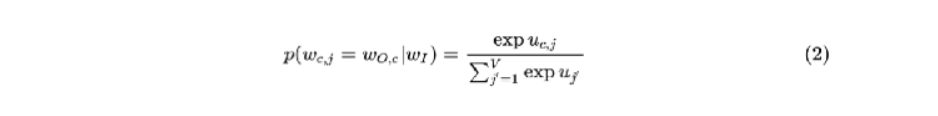

![6 6]()

Softmax概率

w(c, j) 是在第c个上下文位置上预测的第j个单词; w(O, c)是在第c个上下文位置上出现的实际单词; w(I)是唯一的输入词; u(c, j)是在第c个上下文位置上预测单词时,U向量的第j个值。

损失函数

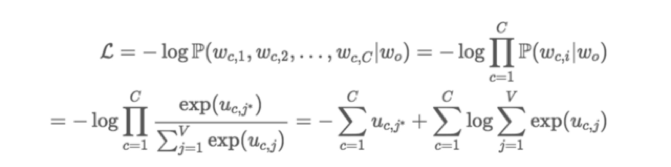

![7 7]()

损失函数

由于我们想在第c个上下文位置预测w(c, j) 时实现概率最大化,可以使用损失函数L。

优势

- Skip-gram是一种无监督学习技术,因此它可以用于任何原始文本。

- 相比于其他单词转向量表达法,Skip-gram需要的记忆更少。

- 它只需要两个维度为[N, |v|]而不是[|v|, |v|]的权重矩阵。 而且通常情况下,N约为300,|v| 则约为数百万。

劣势

- 找到N和c的最佳值很困难。

- Softmax函数计算耗费的时间很长。

- 训练这个算法耗时较长。