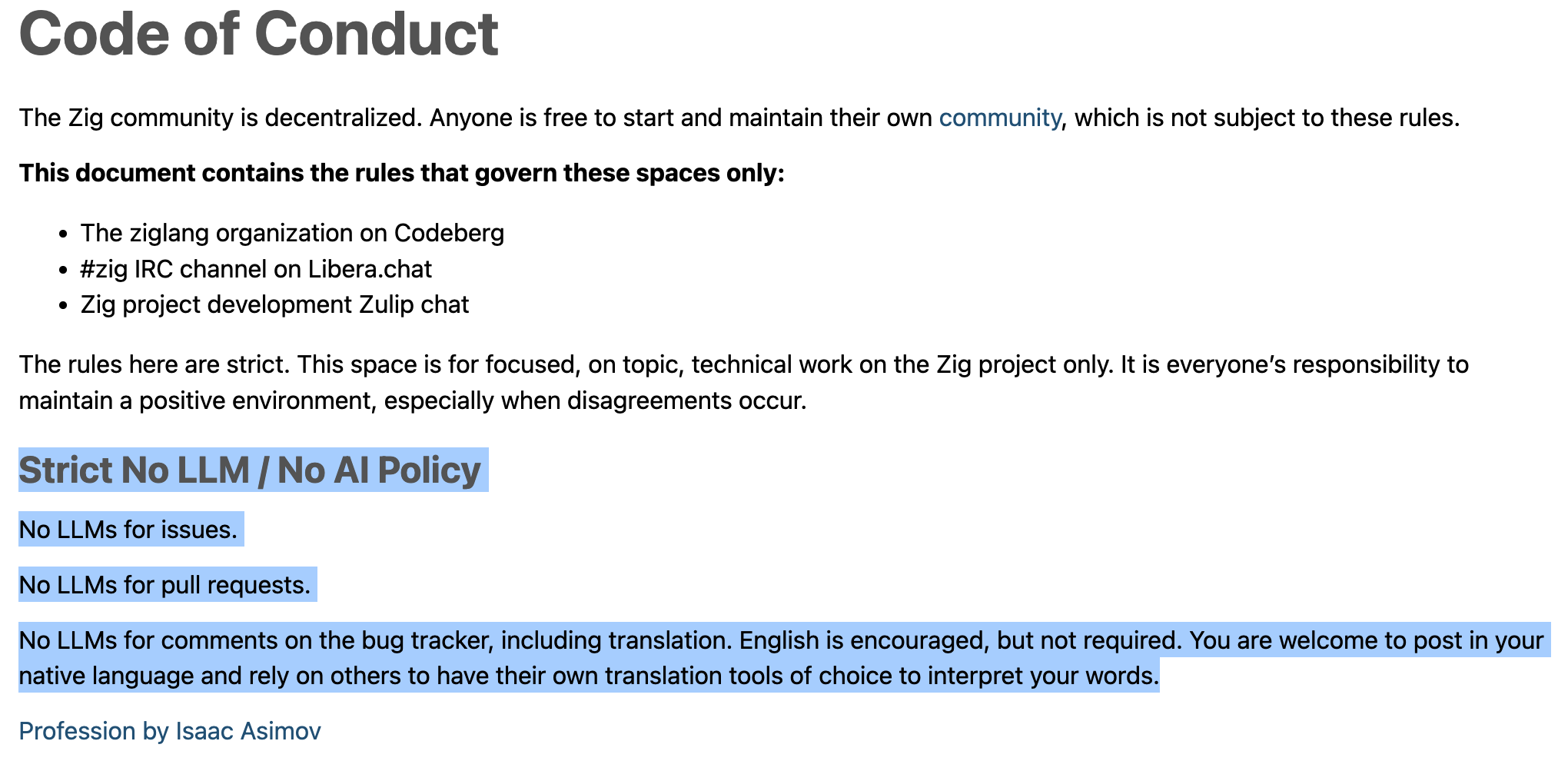

4 月 30 日,知名开发者 Simon Willison 在其博客发文,详细解读了 Zig 编程语言项目近期出台的严格反 AI 贡献政策。这项政策明确禁止在所有 issue、Pull Request 及评论中使用 LLM 辅助生成内容,引发了开源社区对 "AI 与开源治理" 关系的广泛讨论。

Zig 项目核心维护者的立场非常鲜明:开源项目的终极目标不是获取代码,而是培养长期可信的贡献者。用他们自己的话说,"you play the person, not the cards"(你押注的是人,而非手中的牌)。审查 Pull Request 的首要目的从来不是合并代码本身,而是帮助新贡献者成长,让他们理解项目规范、建立信任关系。一旦引入 LLM 辅助,这个培养过程就被架空了 —— 维护者无法判断提交者是否真正理解自己的代码。

试问如果一个 PR 主要由 LLM 编写,那么项目维护者为什么要花时间审查和讨论这个 PR,而不是启动自己的 LLM 来解决同样的问题呢?

这一观点得到了颇具说服力的现实佐证。Bun(基于 Zig 构建的高性能 JavaScript 运行时)已被 Anthropic 收购,团队内部重度使用 AI 辅助开发。然而即便如此,Bun 团队仍然无法向 Zig 上游提交 AI 辅助生成的优化代码,因为其根本不符合 Zig 项目对 "真实人类贡献者" 的要求。

Zig 项目的逻辑并非排斥技术进步,而是对开源社区长期健康的审慎考量。当 AI 可以瞬间生成看似合格的代码时,项目维护者面临的最大风险不再是代码质量,而是无法识别 "谁在真正学习、谁只是让 AI 代笔"。这种信息不对称会瓦解 mentorship(导师制)这一开源社区最核心的传承机制。

参考来源: