阿里宣布开源桌面 Agent 工具 CoPaw(Co Personal Agent Workstation),一款可本地可云端部署的个人 AI 助理。连接钉钉、飞书、QQ、Discord、iMessage 等聊天软件,支持定时任务与主动心跳,通过 Skills 机制实现能力的无限扩展。几条命令即可本地跑通。

![]()

公告称,此次开源版本升级的核心逻辑是:降低门槛,打开上限。降低门槛,让本地部署更轻量、配置更简单;打开上限,让开发者和用户可以基于开源版本自由扩展,接入自己的模型、编写自己的Skill、对接自己的渠道。

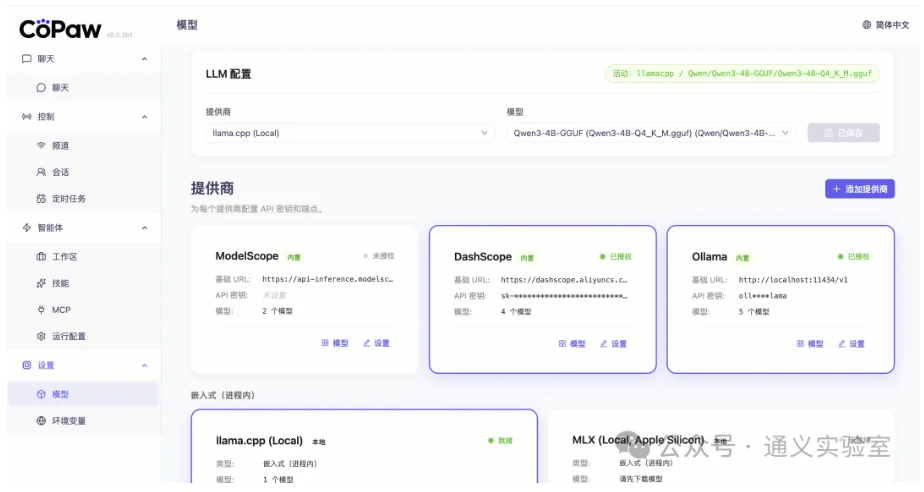

全面升级了模型管理能力:

-

自定义模型供应商:不再限于内置供应商,你可以自由增加和删除自己的模型提供方。无论是私有部署的大模型服务,还是新兴的模型 API,都可以灵活接入。

-

模型增删管理:对内置供应商的模型列表也支持自定义增删,适配你实际使用的模型版本。

-

Ollama 全面支持:新增 Ollama Provider,实现后端模型自动同步、控制台卡片展示与增删管理。如果你正在用 Ollama 跑本地模型,现在可以无缝衔接 CoPaw,真正实现全链路本地化——数据不出你的电脑。

-

llama.cpp 与 MLX 本地后端:除 Ollama 外,内置 llama.cpp(跨平台)与 MLX(Apple Silicon)两种本地推理后端。安装对应依赖(pip install "copaw[llamacpp]" 或 pip install "copaw[mlx]")后,可通过控制台与 CLI 管理本地模型列表,与云端供应商并列选用。

这意味着,无论你是用云端 API、自建推理服务、Ollama、llama.cpp 还是 MLX(Apple 芯片本地),CoPaw 都能适配。

CoPaw 的长期记忆会学习你的偏好、决策、待办,随着使用、越来越懂你。这次对记忆模块做了两项重要改进:

对于只想在本地轻量使用的用户,不再有「装不上向量库」的困扰。

本次升级幅度最大的部分是对 Agent 的核心架构进行了模块化重构,让「可扩展」更加容易:

-

模块化拆分:Prompt、Hooks、Tools、Memory 等核心组件解耦,开发者可以独立替换或扩展任意模块,按需组装自己的 Agent。

-

自定义 Skills 与控制台同步:在工作目录下编写的自定义 Skill,会自动与控制台 UI 同步,启用/禁用/编辑一目了然。

-

Skills Hub 接入:支持从社区 Skills Hub(如 ClawHub)导入 Skills,一行命令获取社区共享的能力,站在社区的肩膀上。

-

ChatModel 扩展接口:提供标准化的模型扩展接口,方便接入新的模型后端。

-

运行时 MCP 热插拔:支持在 CoPaw 运行过程中动态新增 MCP(Model Context Protocol)工具,无需重启即可扩展能力边界。

-

核心参数暴露:Context Length、ReAct 轮数等关键参数均支持自定义配置,高级用户可以精细调控 Agent 行为。

简单来说:CoPaw 不再只有单一的形态,而是一个可以被你重新定义的专属平台。

以及对频道架构做了系统性的重构:

-

协议与类型统一:重新设计了 ChannelAddress、消息内容类型等核心协议,强类型约束让频道开发更规范、更不容易出错。

-

消费与队列机制:引入 Manager 队列 + Consumer Loop 的异步消费模式,消息处理更可靠,不会丢消息。

-

各渠道标准化:所有渠道统一使用 native → content_parts 的消息转换流程,开发新渠道时只需关注差异部分。

-

插件化与 CLI 工具:新增频道注册表(Registry)机制和自定义频道目录,提供 list / install / remove / config 等 CLI 命令,开发者可以像安装插件一样管理频道。

如果你有自己常用的 IM 工具想接入 CoPaw,现在就可以参照文档开发自己的 Channel 插件。