找到可以在MaxCompute上运行的包

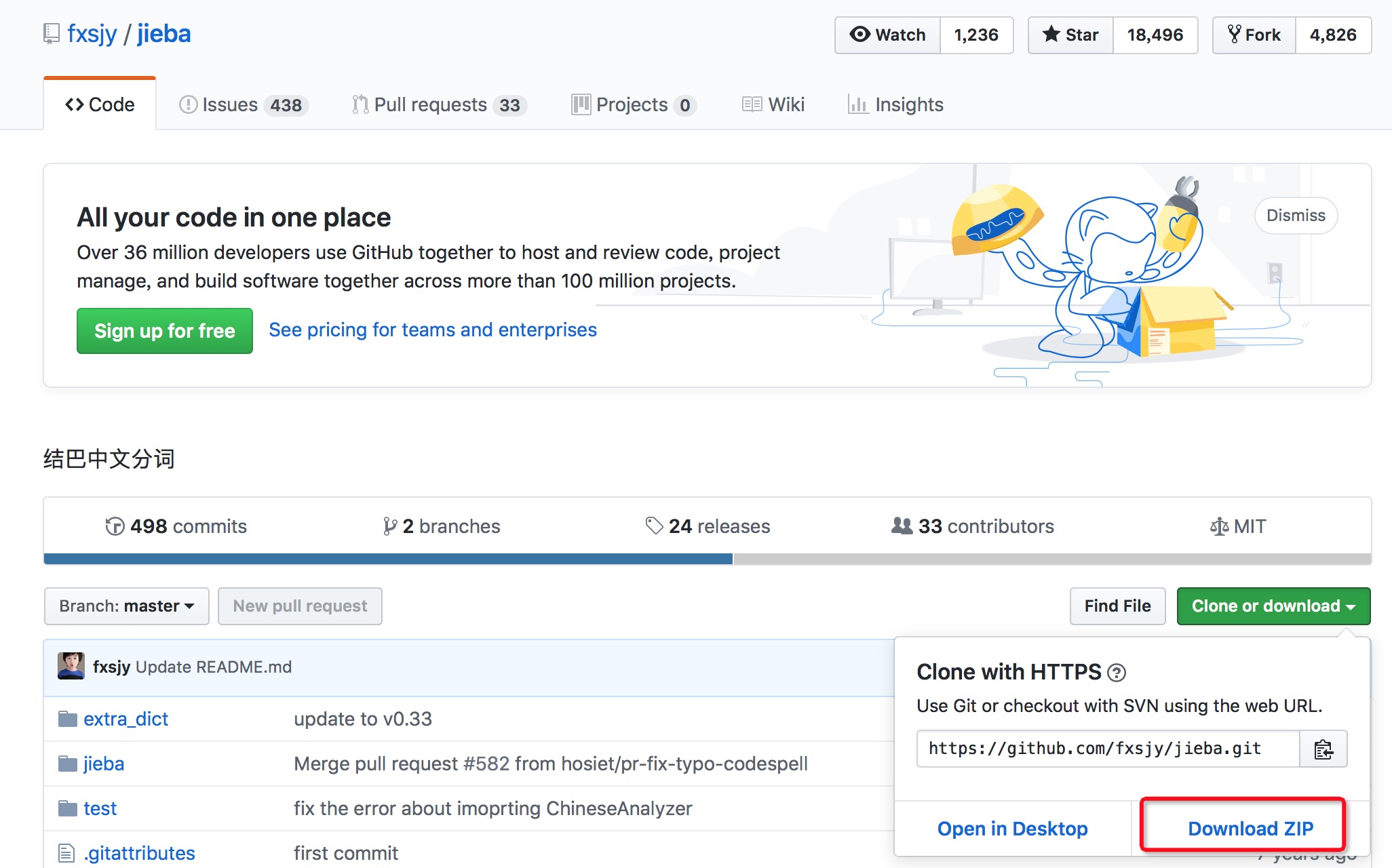

您可以选择在pypi或GitHub下载jieba,本文以github下载为例,如图所示,下载zip压缩包。

pypi.org下载

GitHub下载

![_zip_ _zip_]()

上传第三方包

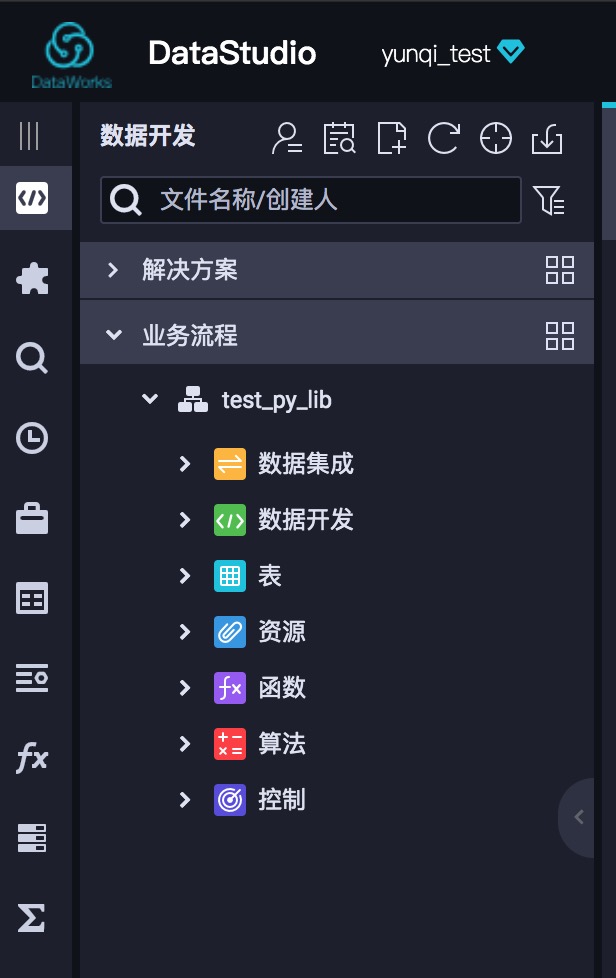

在 DataWorks 创建业务流程

![_ _]()

上传已下载至本地的jieba-master.zip

![_ _]()

上传完毕,务必记得提交资源至maxcompute开发环境。

![_ _]()

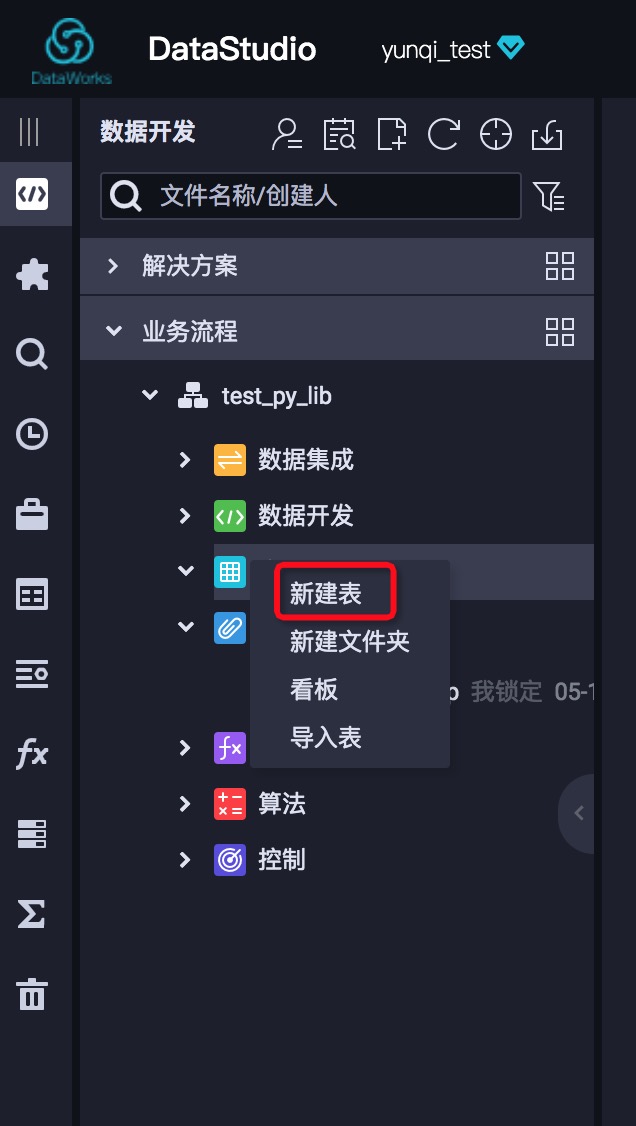

创建测试数据表及数据

建表不做演示,DDL语句附后。

![_ _]()

CREATE TABLE `jieba_test` (

`id` STRING,

`content` STRING

);

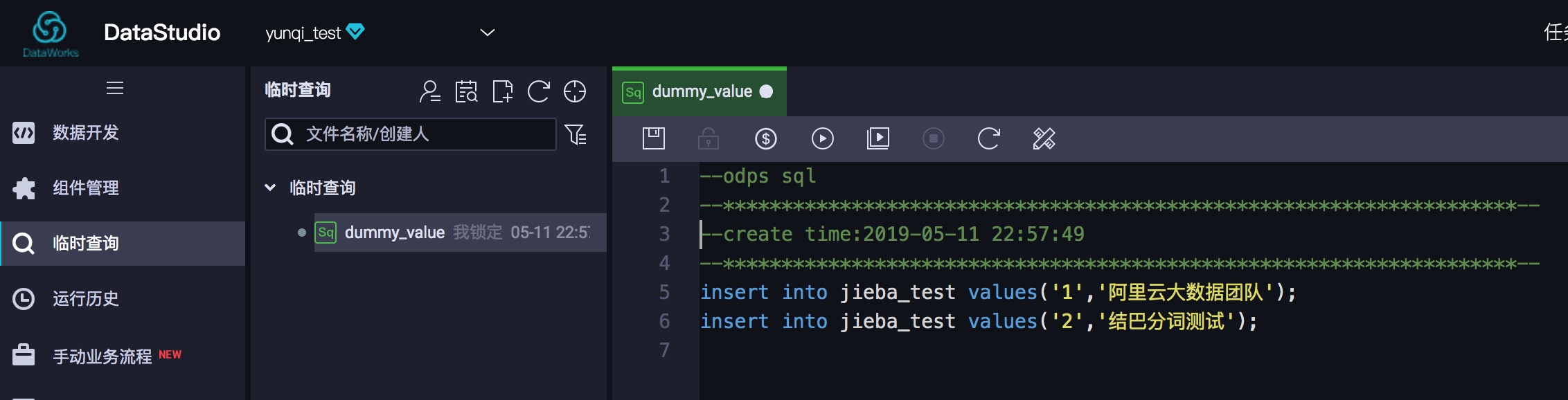

创建临时查询,插入测试数据

![_ _]()

insert into jieba_test values('1','阿里云大数据团队');

insert into jieba_test values('2','结巴分词测试');

编写代码验证

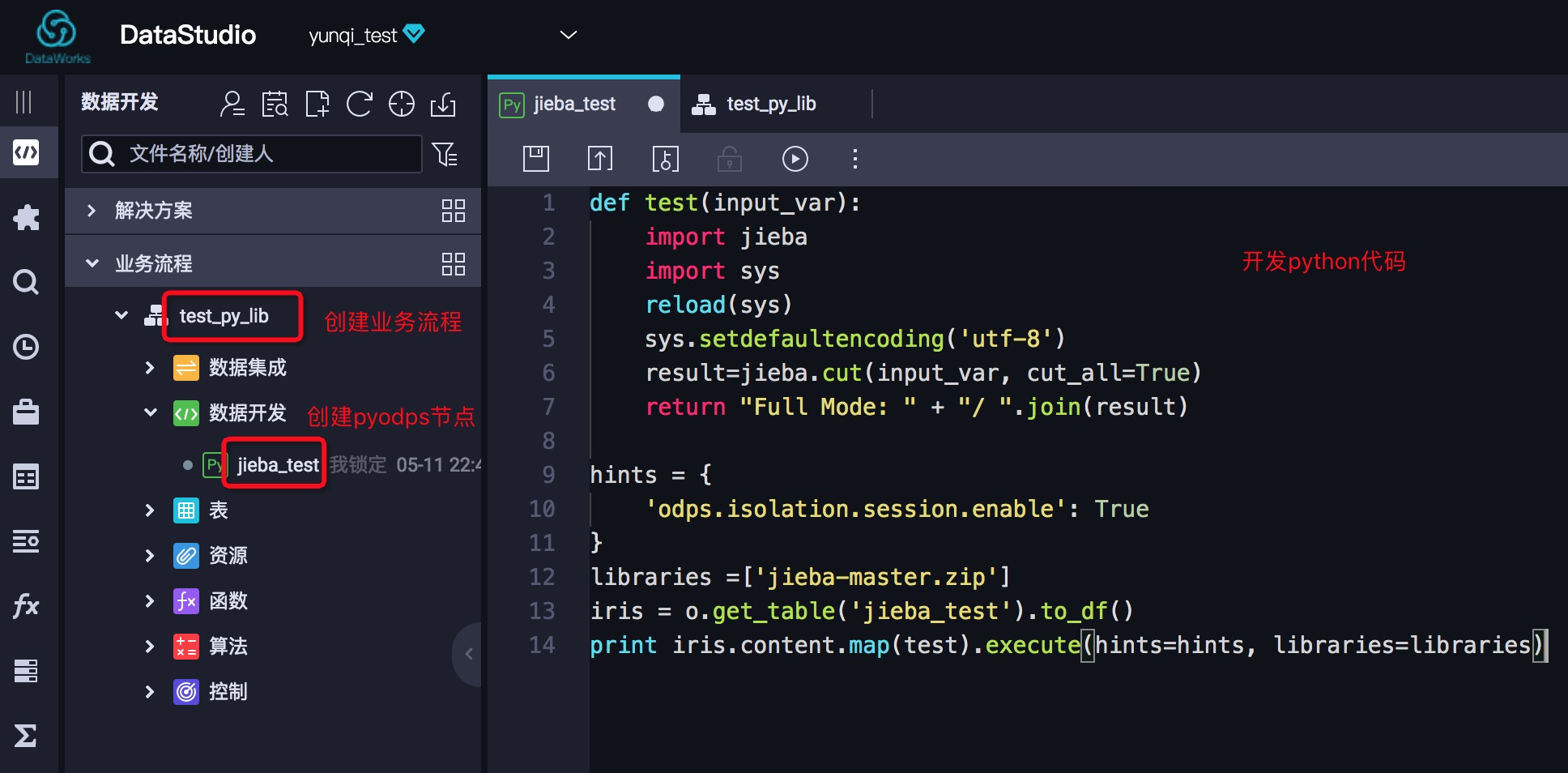

在 DataWorks 创建业务流程-->创建PyODPS节点

![_ _]()

def test(input_var):

import jieba

import sys

reload(sys)

sys.setdefaultencoding('utf-8')

result=jieba.cut(input_var, cut_all=True)

return "Full Mode: " + "/ ".join(result)

hints = {

'odps.isolation.session.enable': True

}

libraries =['jieba-master.zip']

iris = o.get_table('jieba_test').to_df()

print iris.content.map(test).execute(hints=hints, libraries=libraries)

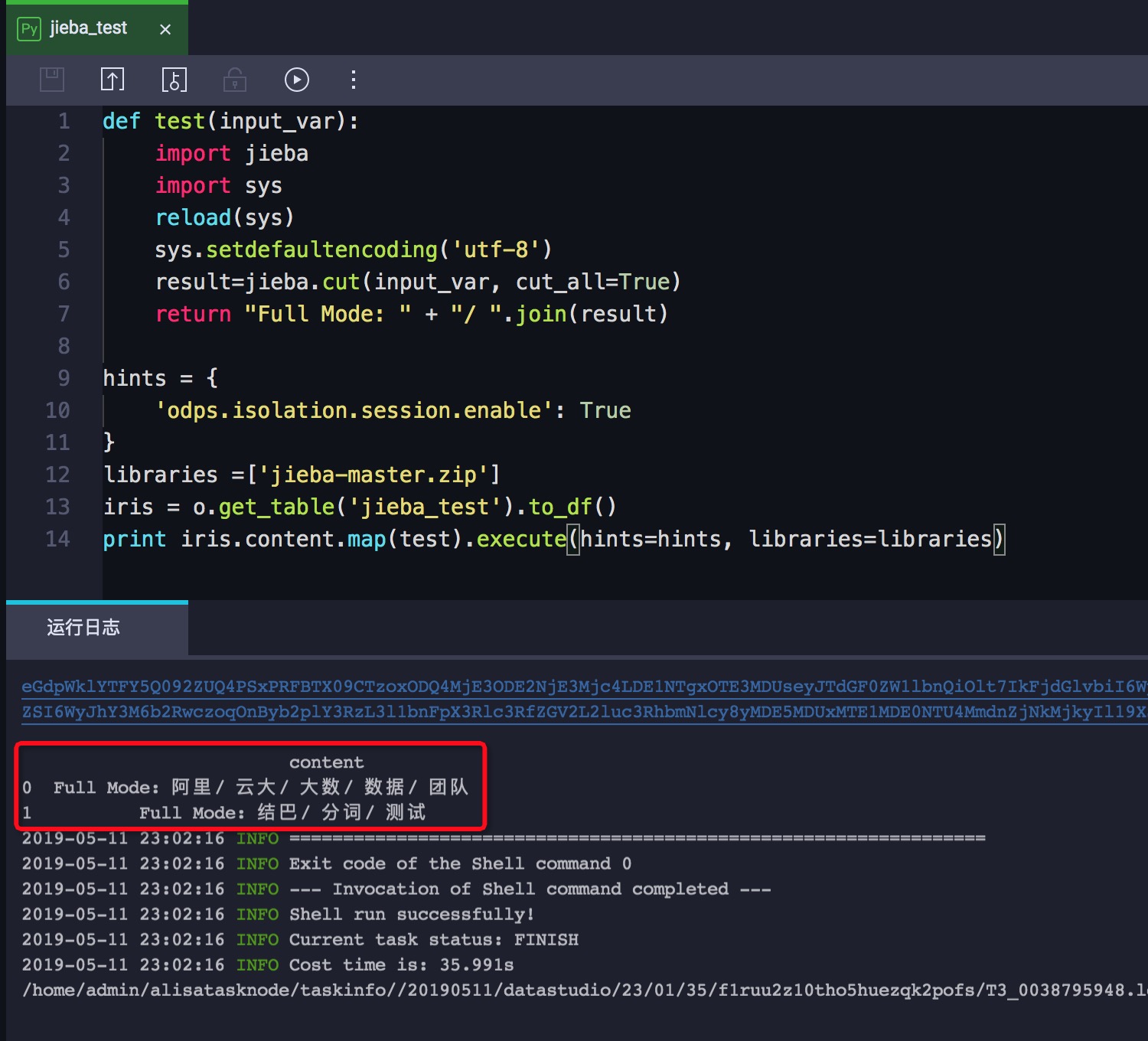

在DataStudio直接运行验证分词结果

![_ _]()