机器名称 启动服务

linux11 namenode secondrynamenode datanode

linux12 datanode

linux13 datanode

第一步:更改主机名,临时修改+永久修改

临时修改:hostname linux11

永久修改: vi /etc/sysconfig/network

NETWORKING=yes

HOSTNAME=linux11

临时修改:hostname linux12

永久修改: vi /etc/sysconfig/network

NETWORKING=yes

HOSTNAME=linux11

临时修改:hostname linux13

永久修改: vi /etc/sysconfig/network

NETWORKING=yes

HOSTNAME=linux13

第二步:配置ip地址

1.三台机器关闭NetworkManager服务 service NetworkManager stop

2.三台机器禁止开机启动NetworkManager服务 chkconfig NetworkManager off

3. vi /etc/sysconfig/network-scripts/ifcfg-eth0

三台机器依次配置成这样

linux11:

ONBOOT=yes

BOOTPROTO=static

IPADDR=192.168.91.11

DNS1=8.8.8.8

GATEWAY=192.168.91.1

NETMASK=255.255.255.0

linux12:

ONBOOT=yes

BOOTPROTO=static

IPADDR=192.168.91.12

DNS1=8.8.8.8

GATEWAY=192.168.91.1

NETMASK=255.255.255.0

linux13:

ONBOOT=yes

BOOTPROTO=static

IPADDR=192.168.91.13

DNS1=8.8.8.8

GATEWAY=192.168.91.1

NETMASK=255.255.255.0

最终结果:

192.168.91.11 linux11

192.168.91.12 linux12

192.168.91.13 linux13

3.三台机器关闭防火墙 service iptables stop

4.三台机器设置禁止开机启动防火墙 chkconfig iptables off

5.三台机器关闭防火墙 service iptables status

显示iptables: Firewall is not running.说明防火墙关闭成功

6.三台机器重启网卡service network restart

第三步配置主机映射

使用命令:vi /etc/hosts

三台机器都改成这样

192.168.91.11 linux11

192.168.91.12 linux12

192.168.91.13 linux13

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

测试:

在linux11上 ping linux12 ping linux13

第四步配置免密码登录

linux11:

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 600 ~/.ssh/authorized_keys

linux12:

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 600 ~/.ssh/authorized_keys

linux13:

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 600 ~/.ssh/authorized_keys

在linux11上

ssh-copy-id linux12

ssh-copy-id linux13

测试:测试结果为linux11可以免密码登录到所有机器。linux12 linux13可以免密码登录本机

例如:在linux11上输入 ssh linux11

第五步安装jdk及hadoop(由于使用root用户操作,为了防止对liunx操作不熟悉的人,误删其他文件。所以没有选择把软件安装在/usr下,而是选择安装在了自己创建的文件目录下)

linux11:

1.在根目录下创建bigdata目录 mkdir /bigdata

2.将hadoop安装包 tar -zxvf /bigdata/hadoop-2.7.1.tar.gz -C /bigdata/

删除hadoop安装包 rm -rf /bigdata/hadoop-2.7.1.tar.gz

3.jdk安装包解压 tar -zxvf /bigdata/jdk-8u151-linux-x64.gz -C /bigdata/

删除jdk安装包 rm -rf /bigdata/jdk-8u151-linux-x64.gz

修改jdk目录的名字为jdk1.8 mv /bigdata/jdk1.8.0_151/ /bigdata/jdk1.8

4.配置环境变量 vi /etc/profile

在文件末尾加入如下配置

export JAVA_HOME=/bigdata/jdk1.8

export HADOOP_HOME=/bigdata/hadoop-2.7.1

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:

第六步:hadoop的配置

1.hadoop-env.sh的配置

使用命令 vi /bigdata/hadoop-2.7.1/etc/hadoop/hadoop-env.sh

第25行export JAVA_HOME=改成下面的样子

export JAVA_HOME=/bigdata/jdk1.8

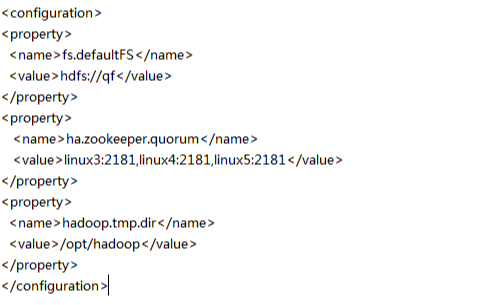

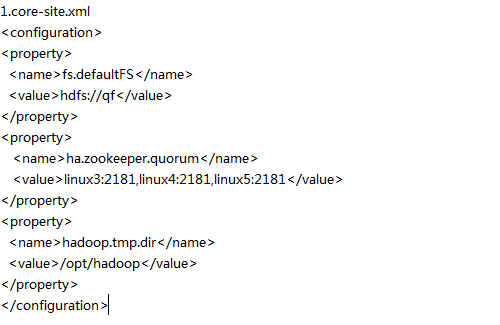

2.core-site.xml 的配置

使用命令 vi /bigdata/hadoop-2.7.1/etc/hadoop/core-site.xml

配置成这样:

3![01 01]()

.hdfs-site.xml的配置

使用命令 vi /bigdata/hadoop-2.7.1/etc/hadoop/hdfs-site.xml

配置成这样:

![02 02]()

![03 03]()

4.slaves文件配置

使用命令 vi /bigdata/hadoop-2.7.1/etc/hadoop/slaves

配置成这样

linux11

linux12

linux13

第七步:远程拷贝

1.将bigdata文件分发给linux12 linux13

scp -r /bigdata linux12:/

scp -r /bigdata linux13:/

2.将/etc/profile文件分发给linux12 linux13

scp /etc/profile linux12:/etc

scp /etc/profile linux13:/etc

3.三台机器刷新环境变量 source /etc/profile

第八步:格式化namenode

在namenode节点linux11上输入命令 hdfs namenode -format

格式化完成后在linux11上启动集群 start-dfs.sh

第九步:验证集群是否启动成功

1.在浏览器上输入192.168.91.11:50070如果页面能打开显示有3个活跃节点说明成功

2.linux11上输入jps 能看到namenode secondrynamenode datanode三个服务

3.linux12上输入jps 能看到datanode

4.linux12上输入jps 能看到datanode

5.上传个文件至集群hdfs dfs -put /bigdata/jdk1.8 /

6.查看web页面是否存在这个文件

![04 04]()