从本文开始,将与大家进入到Elasticsearch的精妙世界中来,基于当前最新的6.4.x版本。

本文将重点探讨ElasticSearch Client的相关知识,重点关注TransportClient与Rest Client。Elasticsearch client 是我们进入ElasticSearch的大门。

1、概述

所有Elasticsearch操作都是使用Client对象执行的。Client 定义的所有API都是异步执行的。(要么使用事件监听器回调或者使用Future模式)

Elasticsearch计划在Elasticsearch 7.0中弃用TransportClient,在8.0中完全删除它。故在实际使用过程中建议您使用Java高级REST client。Rest client执行HTTP请求来执行操作,无需再序列化的Java请求。

按照官方的意思,以后ElasticSearch应该不会再为某一种具体语言单独提供客户端API,而是使用通用rest请求(http)来ElasticSearch服务器进行交互。

接下来我们会从java api开始进入ElasticSearch API的学习。

ElasticSearch Client目前按照编程语言提供如下实现:

![a a]()

官方文档链接:https://www.elastic.co/guide/en/elasticsearch/client/index.html

接下来将重点分析JAVA Client与Java REST Client。

2、TransportClient详解

2.1 TransportClient概述

TransportClient 是ElasticSearch(java)客户端封装对象,使用transport远程连接到Elasticsearch集群,该transport node并不会加入集群,而是简单的向ElasticSearch集群上的节点发送请求。

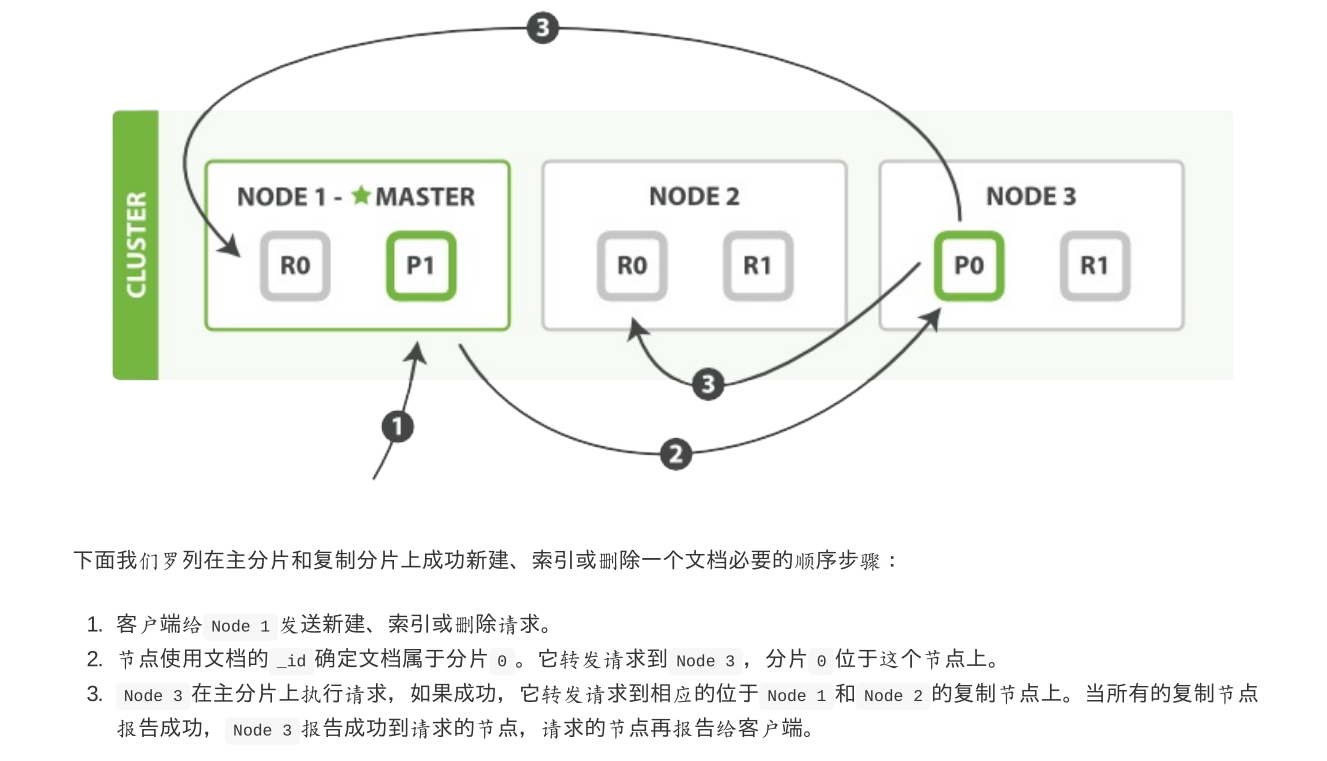

transport node默认使用轮询机制进行集群内的节点进行负载均衡,尽管大多数操作(请求)可能是“两跳操作”。(图片来源于Elasticsearch权威指南)

![a a]()

正如上述图所述,以一个新建操作为例,请求首先发送到NODE1,然后会根据ID进行路由计算(hashcode(id)%主分片个数),例如使用p0(第一个主分片),此时NODE1会将请求转发到Node3,然后客户端发送第二个请求,会发送到NODE2上(上文中的轮询机制)。

默认构建TransportClient的方法如下:

// on startup

TransportClient client = new PreBuiltTransportClient(Settings.EMPTY) // @1

.addTransportAddress(new TransportAddress(InetAddress.getByName("192.168.1.10"), 9300)) // @2

.addTransportAddress(new TransportAddress(InetAddress.getByName("192.168.1.11"), 9300));

// on shutdown

client.close();

代码@1:使用空配置。

代码@2:连接ElasticSearch 节点,可以通过addTransportAddress方法连接多个Node节点,这样请求会轮流发送到这些节点上,实现集群节点在接受请求时的负载均衡。

TransportClient级别的主要参数如下:

- cluster.name

指定集群名称。

- client.transport.sniff

是否开启集群嗅探功能,下文会详细介绍。

- client.transport.ignore_cluster_name

是否忽略连接节点的集群名称校验,设置为true表示忽略,避免连接的节点并不在同一个集群中。

- client.transport.ping_timeout

ping命令的响应超时时间,默认为5s。

- client.transport.nodes_sampler_interval 对连接节点发送ping命令的频率,默认为5s,即常说的心跳检测间隔时间。

接下来重点描述一下client.transport.sniff参数,集群群嗅探机制。

在创建TransportClient时可以通过addTransportAddress来静态的增加ElasticSearch集群中的节点,如果开启集群群嗅探机制,即开启节点动态发现机制,允许动态添加和删除节点。

当启用嗅探功能时,首先客户端会连接addTransportAddress中的节点上。在此之后,客户端将调用这些节点上的内部集群状态API来发现可用的数据节点。客户端的内部节点列表将仅被发现的数据数据节点替换。默认情况下,这个列表每5秒刷新一次。也就意味着如果该节点不是数据节点,则列表可能不包括它连接的原始节点。

例如,如果您最初连接到一个主节点,在嗅探之后,如果发现了有其对应的数据节点,则不会再向该主节点发出请求,而是向任何数据节点发出请求。传输客户端排除非数据节点的原因是为了避免只向主节点发送搜索流量。

使用配置构建Settings构建TransportClient对象代码如下:

Settings settings = Settings.builder()

.put("cluster.name", "myClusterName")

.put("client.transport.sniff", "true").build();

TransportClient client = new PreBuiltTransportClient(settings)

.addTransportAddress(new TransportAddress(InetAddress.getByName("192.168.1.10"), 9300)) ;

//Add transport addresses and do something with the client...

2.2 TransportClient API

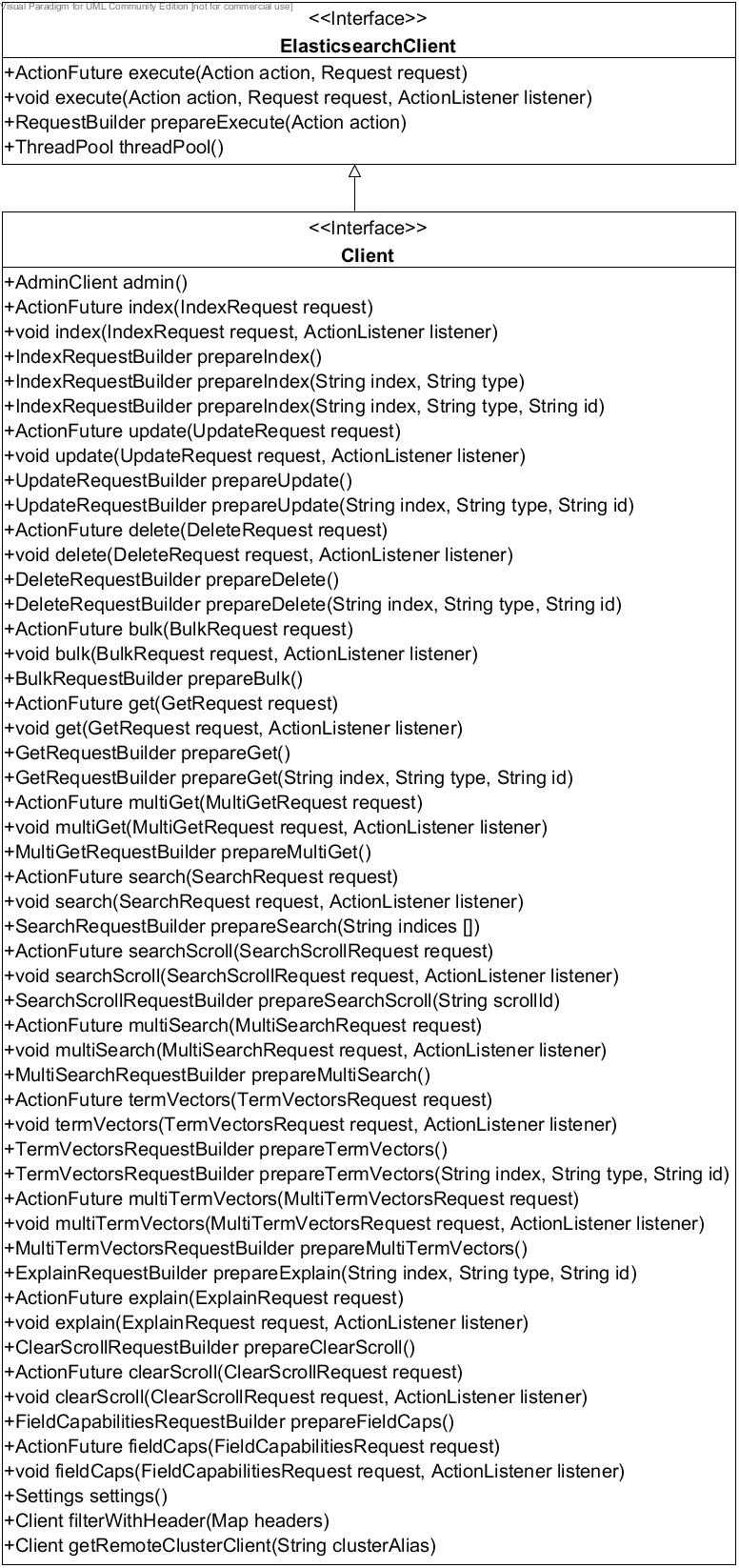

TransportClient 的核心类继承图如下:

![ElasticSearch_Client_ ElasticSearch_Client_]()

上述API的设计要点:

整个客户端API提供两个最底层的方法,execute,其关键特征如下:

- ActionFuture execute(Action action, Request request);

返回ActionFuture,根据名称即可知道,该方法是典型的异步调用,Future模式。

- void execute(Action action, Request request, ActionListener listener);

无返回值,但需要传入ActionListener listener,同样根据名称即可知道,该参数的作用是事件监听器(回调方法),也就是收到服务端响应后,调用回调函数,进行结果处理。

注意:ElasticSearch Client API 其本质是使用异步请求模式。

- prepare 开头的方法,例如IndexRequestBuilder prepareIndex()

这类API的设计是使用Build模式,先通过build构建请求参数,最终会通过调用get()方法完成接口调用。

TransportClient Api就先解释到这里了,后续会详细对上述API进行分类详解。

2.3 Maven依懒

<dependency>

<groupId>org.elasticsearch.client</groupId>

<artifactId>transport</artifactId>

<version>6.4.1</version>

</dependency>

<dependency>

<groupId>org.apache.logging.log4j</groupId>

<artifactId>log4j-core</artifactId>

<version>2.11.1</version>

</dependency>

3、Java Rest Client详解

Java REST客户端有两种风格:

- Java Low Level REST Client:elasticsearch client 低级别客户端。它允许通过http请求与Elasticsearch集群进行通信。API本身不负责数据的编码解码,由用户去编码解码。它与所有的ElasticSearch版本兼容。

- Java High Level REST Client:Elasticsearch client官方高级客户端。基于低级客户端,它定义的API,已经对请求与响应数据包进行编码解码。

3.1 Java High Level REST Client

3.1.1 初始化

RestHighLevelClient client = new RestHighLevelClient(

RestClient.builder(

new HttpHost("localhost", 9200, "http"),

new HttpHost("localhost", 9201, "http")));

// close

client.close();

new HttpHost("localhost", 9200, "http")其机制与TransportClient的addTransportAddress的作用一致。

3.1.2 核心API依懒

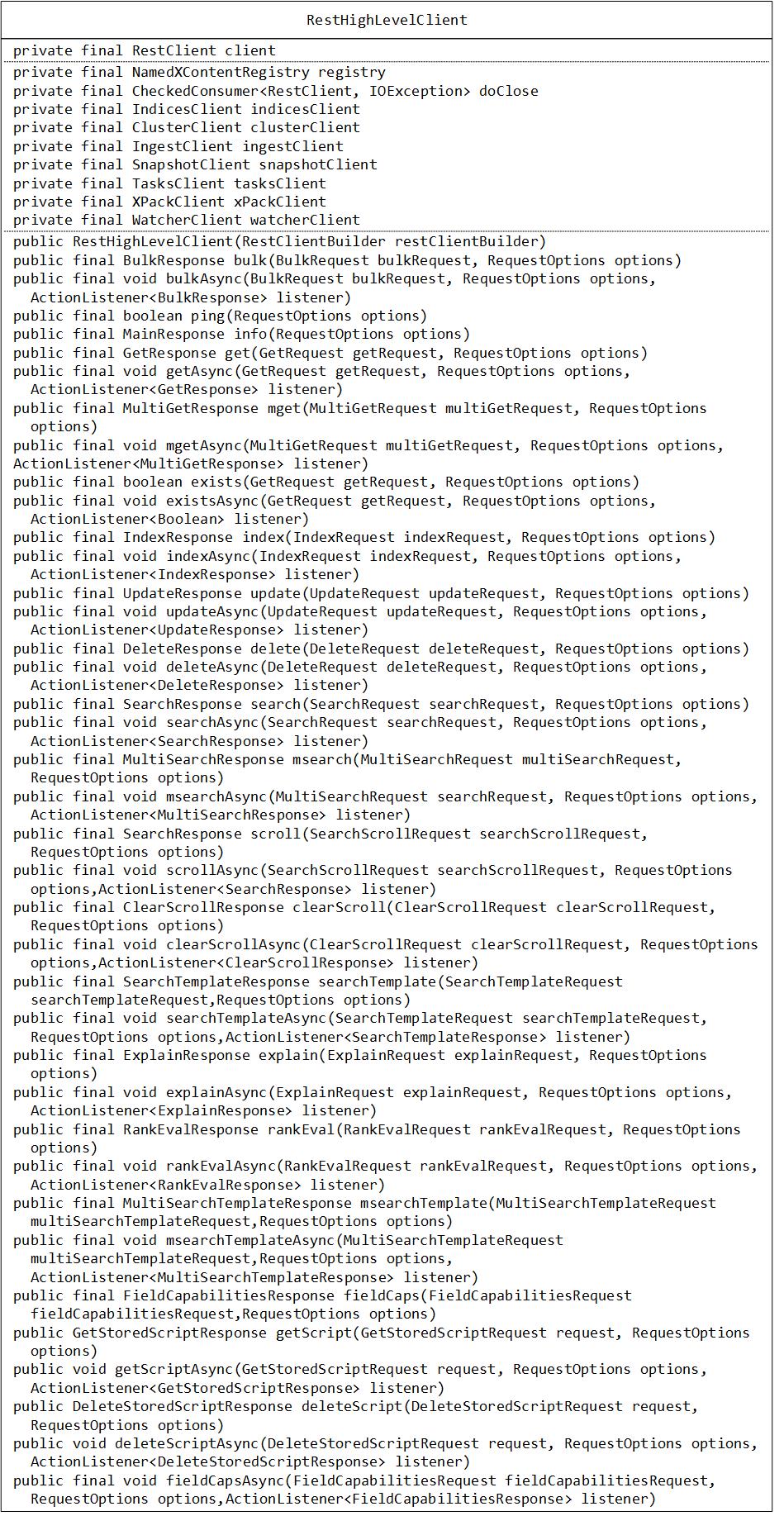

RestHighLevelClient 的类图 如下:

![ElasticSearch_Client_ ElasticSearch_Client_]()

其API设计具有如下特征:

- 每个API提供同步与异步调用,方法名以async结尾的方法为异步调用,需要提供对应的ActionListener实现。

- 每个API都可以提供RequestOptions对象来定制请求选型。

本节将不会对上述API一一介绍,上述API会在后续文章中详细解析。

3.1.3 Maven依懒

<dependency>

<groupId>org.elasticsearch.client</groupId>

<artifactId>elasticsearch-rest-client</artifactId>

<version>6.4.0</version>

</dependency>

<dependency>

<groupId>org.elasticsearch.client</groupId>

<artifactId>elasticsearch-rest-high-level-client</artifactId>

<version>6.4.0</version>

<type>pom</type>

</dependency>

本文就先介绍到这里了,详细分析介绍了Elasticsearch两大客户端 TransportClient与RestHighLevelClient ,后续文章会详细介绍各个API,例如文档的索引、更新、查询、删除、批量查询,Search API等。