前言

Github地址https://github.com/rootsongjc/distributed-load-testing-using-kubernetes

该教程描述如何在Kubernetes中进行分布式负载均衡测试,包括一个web应用、docker镜像和Kubernetes controllers/services。更多资料请查看Distributed Load Testing Using Kubernetes 。

注意:该测试是在我自己本地搭建的kubernetes集群上测试的,不需 要使用Google Cloud Platform。

准备

不需要GCE及其他组件,你只需要有一个kubernetes集群即可。

如果你还没有kubernetes集群,可以参考kubernetes-handbook部署一个。

部署Web应用

sample-webapp 目录下包含一个简单的web测试应用。我们将其构建为docker镜像,在kubernetes中运行。你可以自己构建,也可以直接用这个我构建好的镜像index.tenxcloud.com/jimmy/k8s-sample-webapp:latest。

在kubernetes上部署sample-webapp。

$ cd kubernetes-config

$ kubectl create -f sample-webapp-controller.yaml

$ kubectl create -f kubectl create -f sample-webapp-service.yaml

部署Locust的Controller和Service

locust-master和locust-work使用同样的docker镜像,修改cotnroller中spec.template.spec.containers.env字段中的value为你sample-webapp service的名字。

- name: TARGET_HOST

value: http://sample-webapp:8000

创建Controller Docker镜像(可选)

locust-master和locust-work controller使用的都是locust-tasks docker镜像。你可以直接下载gcr.io/cloud-solutions-http://olz1di9xf.bkt.clouddn.com/locust-tasks,也可以自己编译。自己编译大概要花几分钟时间,镜像大小为820M。

$ docker build -t index.tenxcloud.com/jimmy/locust-tasks:latest .

$ docker push index.tenxcloud.com/jimmy/locust-tasks:latest

注意:我使用的是时速云的镜像仓库。

每个controller的yaml的spec.template.spec.containers.image 字段指定的是我的镜像:

image: index.tenxcloud.com/jimmy/locust-tasks:latest

部署Locust-Master

$ kubectl create -f locust-master-controller.yaml

$ kubectl create -f locust-master-service.yaml

部署Locust-Worker

Now deploy locust-worker-controller:

$ kubectl create -f locust-worker-controller.yaml

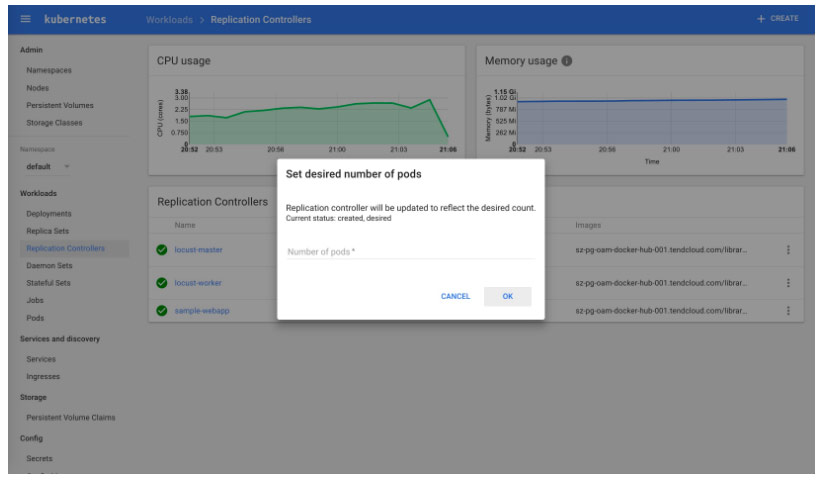

你可以很轻易的给work扩容,通过命令行方式:

$ kubectl scale --replicas=20 replicationcontrollers locust-worker

当然你也可以通过WebUI:Dashboard – Workloads – Replication Controllers –ServiceName – Scale来扩容。

![20170425173628]()

配置Traefik

参考kubernetes的traefik ingress安装,在ingress.yaml中加入如下配置:

- host: traefik.locust.io

http:

paths: - path: /

backend:

serviceName: locust-master

servicePort: 8089

然后执行kubectl replace -f ingress.yaml即可更新traefik。

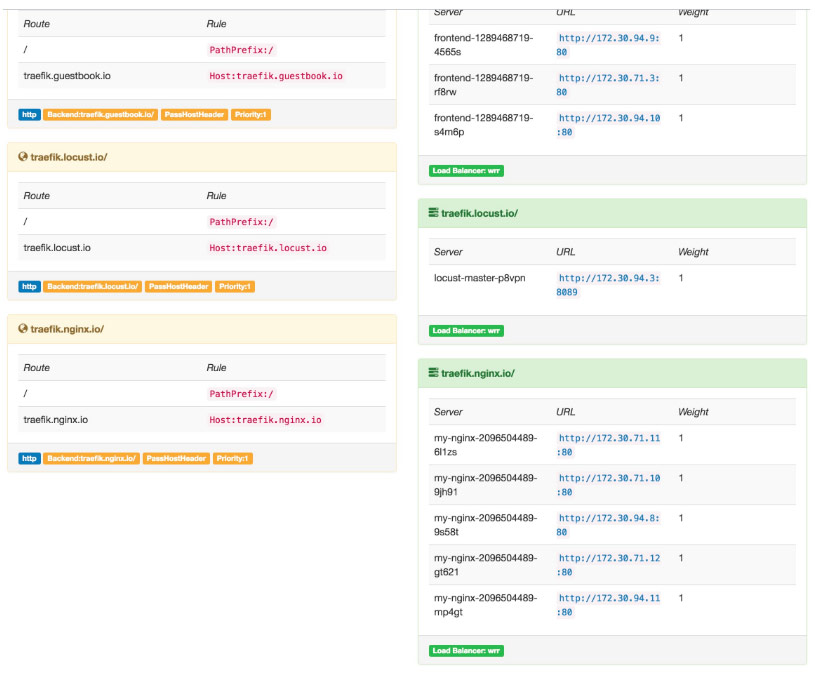

通过Traefik的dashboard就可以看到刚增加的traefik.locust.io节点。

![20170425173638]()

执行测试

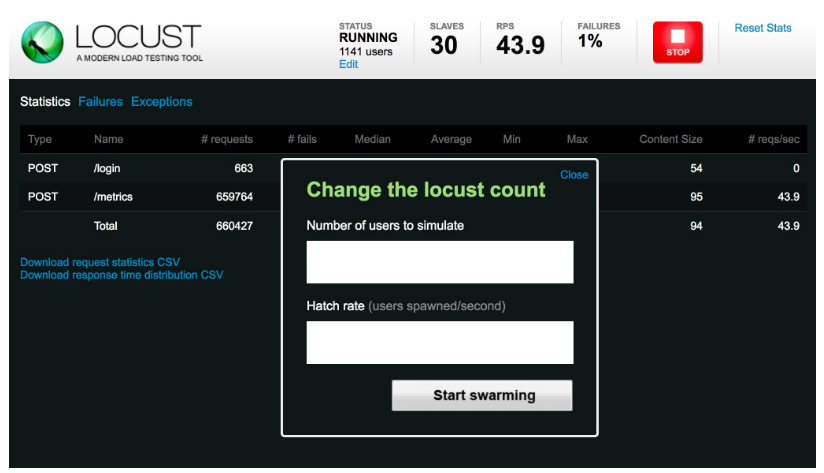

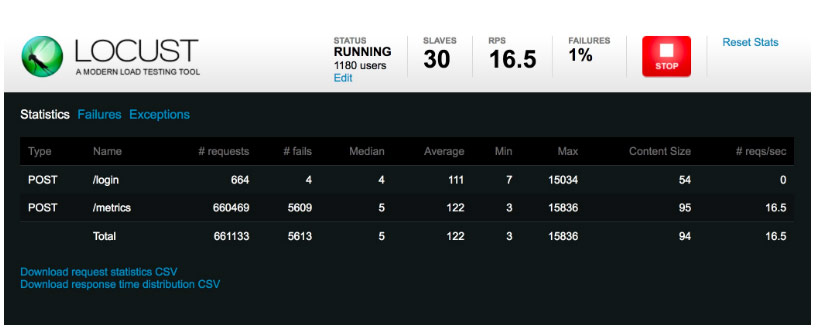

打开http://traefik.locust.io页面,点击Edit输入伪造的用户数和用户每秒发送的请求个数,点击Start Swarming就可以开始测试了。

![20170425173648]()

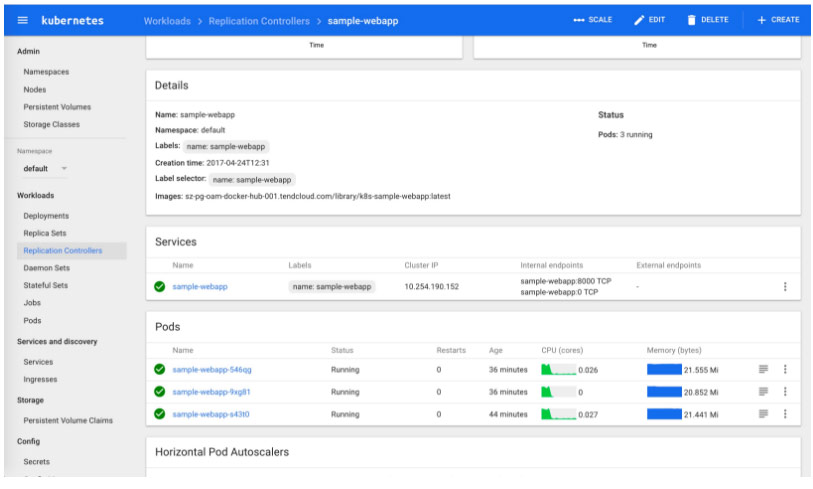

在测试过程中调整sample-webapp的pod个数(默认设置了1个pod),观察pod的负载变化情况。

![20170425173657]()

从一段时间的观察中可以看到负载被平均分配给了3个pod。

在locust的页面中可以实时观察也可以下载测试结果。

![20170425173705]()

参考

Distributed Load Testing Using Kubernetes

运用Kubernetes进行分布式负载测试

本文转自中文社区-运用Kubernetes进行分布式负载测试