腾讯Robotics X实验室联合混元团队发布并开源 HY-Embodied-0.5-X,一款面向具身任务落地的多模态大模型,基于 HY-Embodied-0.5-MoT-2B 架构打造,围绕机器人在真实环境中“看得懂、想得清、做得到”的关键链路进行专项优化。

HY-Embodied-0.5 系列包含两款主力模型:MoT-2B(总参数4B,仅激活2B),采用创新的混合Transformer(MoT)架构,主打端侧部署和实时响应,以及MoE-32B(总参数407B,激活32B)。

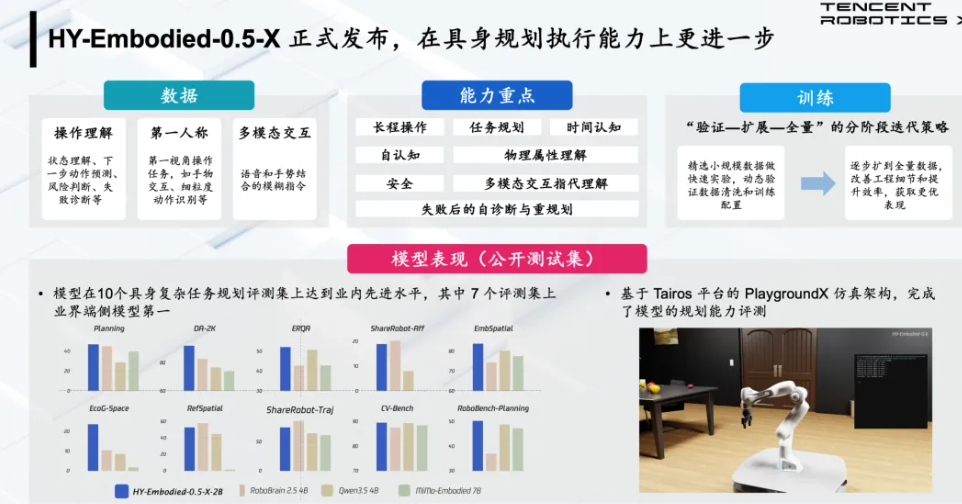

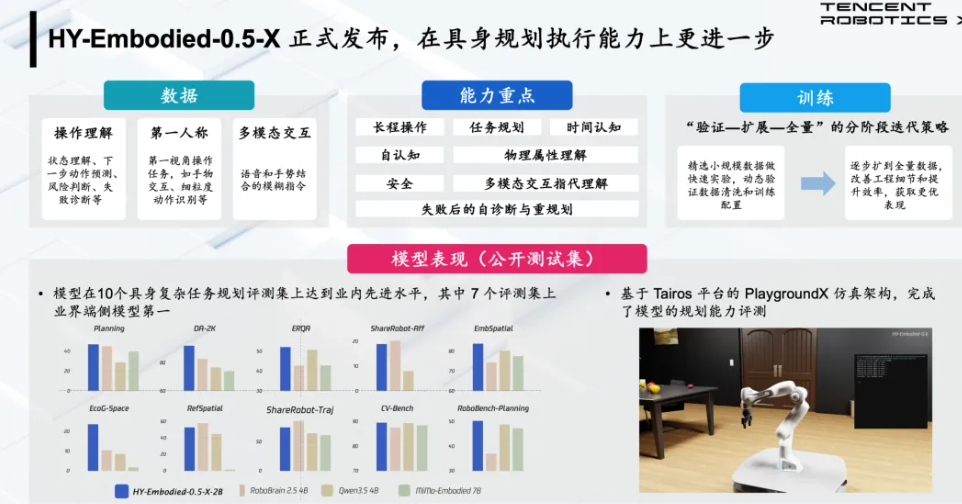

相比通用多模态模型,HY-Embodied-0.5-X 更聚焦机器人在真实交互中的核心问题,重点增强了精细操作理解、空间推理、动作预测、风险判断、多模态指代理解和长程规划等能力,推动模型从“看懂”进一步走向“干活”。

HY-Embodied-0.5-X 结合自采机器人第一视角操作数据、机械臂操作数据以及开源具身数据,构建了覆盖操作理解、第一人称任务推理、多模态交互指代理解等核心场景的高质量训练数据,并配套思维链标注与自动化数据质量闭环。

在训练上,模型采用“验证—扩展—全量”的分阶段迭代策略,优先验证数据质量和训练配置,再逐步扩展到大规模训练,提升训练效率与效果稳定性。

场景方面,HY-Embodied-0.5-X 适用于家庭服务、桌面操作、任务规划与仿真评测等具身智能场景。模型既可以用于机器人在真实环境中的空间推理、精细操作推理、任务理解和失败反思,也可用于仿真环境中的规划评测、多模态交互研究,以及本地部署场景下的具身能力验证与开发。

在数据层面,HY-Embodied-0.5-X 融合了自采机器人第一视角操作数据、机械臂操作数据以及开源具身数据,构建了覆盖操作理解、第一人称任务推理、多模态交互指代理解等关键场景的高质量训练数据。

其中:

- 针对机械臂与人手操作轨迹,团队围绕状态理解、下一步动作预测、操作风险判断、失败诊断和候选动作优劣比较等任务进行了专项数据构建;

- 针对第一视角具身任务,覆盖了细粒度动作识别、子任务进度判断、手部空间定位、深度估计、相对空间关系推理、相机位姿推断等多类能力;

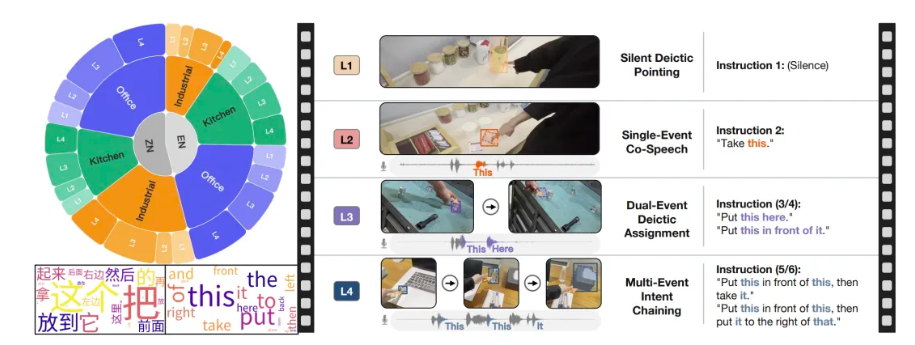

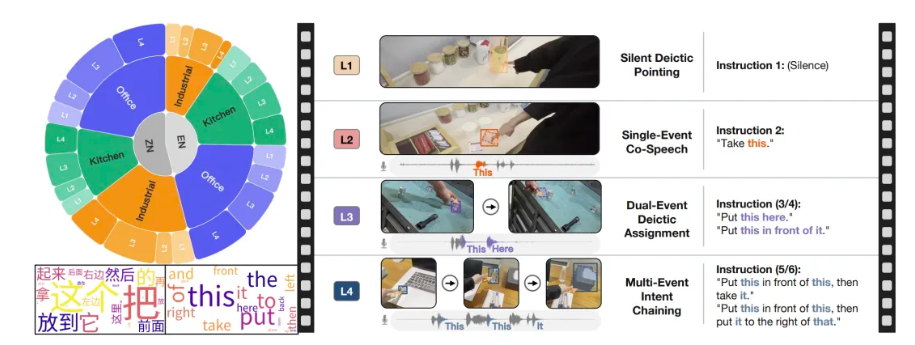

- 围绕真实协作场景中的“把这个放到那里”这类模糊指令,构建了结合语音与手势的多模态交互指代理解数据,进一步增强模型对真实人机协作场景的适应能力。

在数据建设之外,HY-Embodied-0.5-X 还引入了系统化的数据质量闭环。所有核心数据均附带思维链标注,用于训练模型在给出答案前进行逐步推理;同时,团队建立了从“生成—校验—修正”到“评测反跑验证”的完整流程,对结构化字段完整性、视觉有效性、多样性分布和模型增益效果进行端到端度量。面向开放世界泛化能力,团队还进一步将具身、互联网及 3D 数据纳入统一体系,构建了标准化的数据重构流水线,将异构源数据转化为统一的高质量具身推理数据。

在训练层面,HY-Embodied-0.5-X 采用“验证—扩展—全量”的分阶段迭代策略:先通过精选小规模高质量数据快速验证训练配置和数据清洗效果,再逐步扩大训练规模,最终在确认最优数据组合和训练策略后启动全量训练。这样的方式既提升了训练效率,也尽可能确保每一分算力都投入到最有价值的数据上。

围绕真实具身任务,HY-Embodied-0.5-X 主要展现出三方面特点:

- 第一,更强的空间理解能力。 模型能够更准确地理解物体位置、场景布局、相对空间关系和操作状态,为动作决策和任务执行提供更可靠的感知基础。

- 第二,更强的长程规划能力。 模型能够处理多步骤、强依赖的复杂任务,在连续交互中完成更稳定的任务拆解、动作规划与执行决策。

- 第三,更强的具身交互能力。 模型不仅具备视觉理解与对话能力,还能够进行任务解析、指代消解、动作决策、风险判断和失败反思,更贴近真实机器人交互闭环。

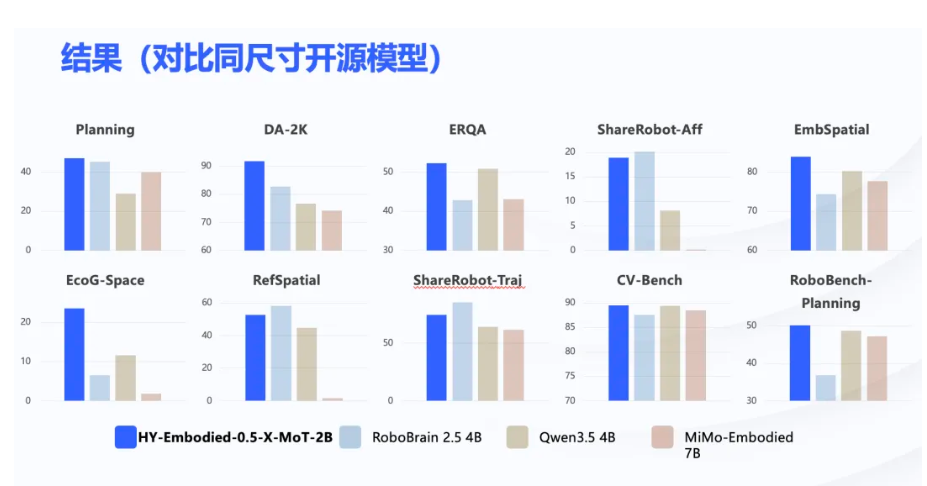

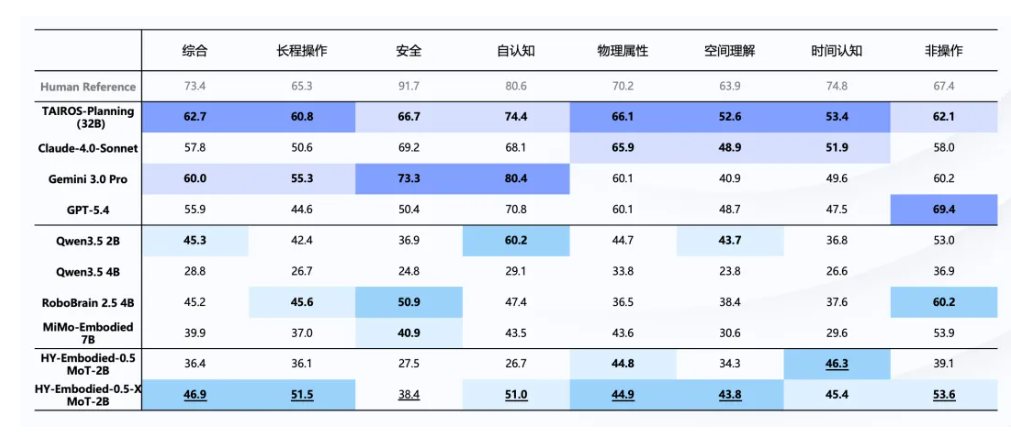

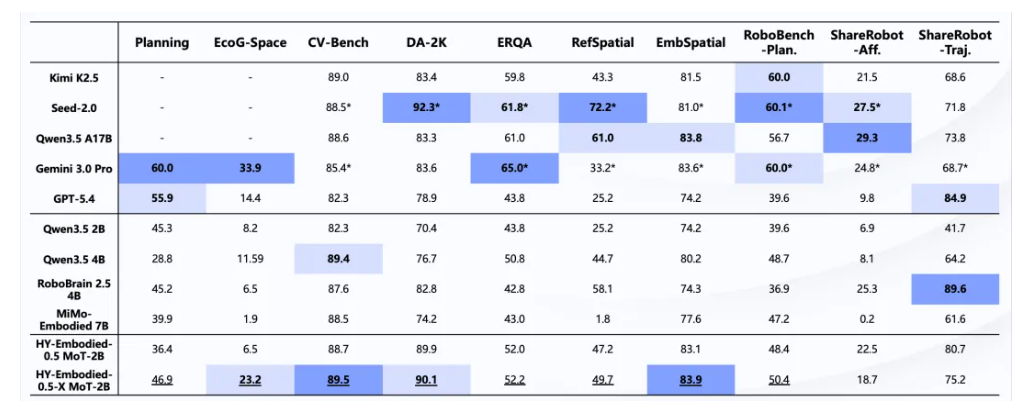

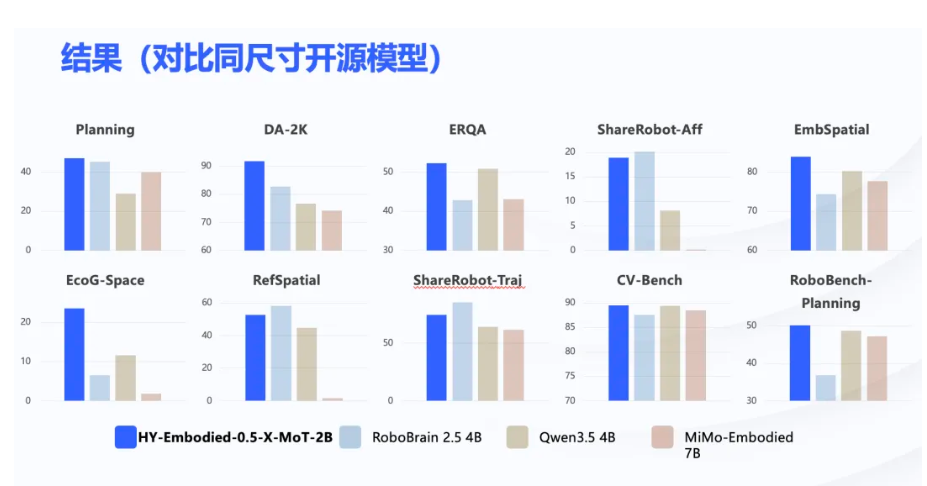

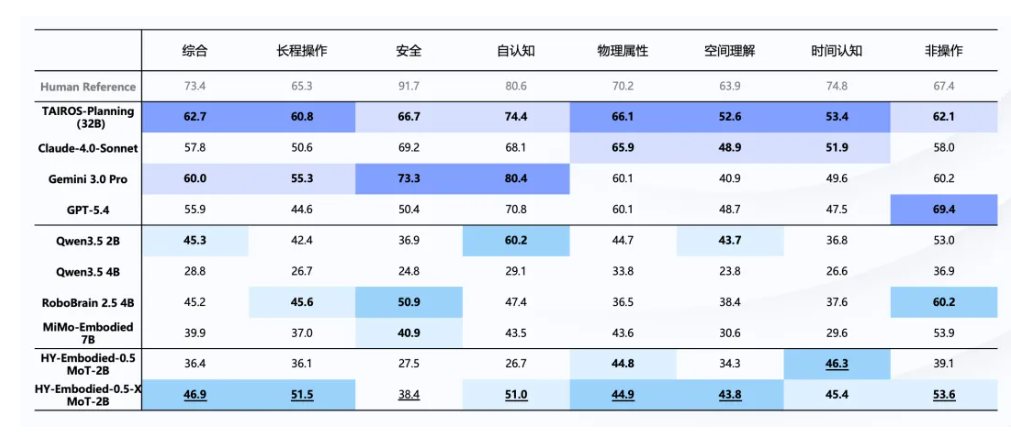

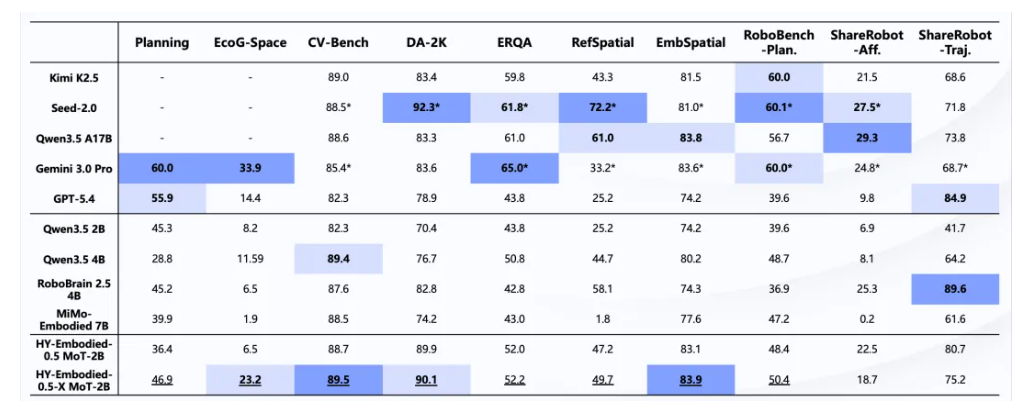

一些测评结果如下: