最近,中文互联网掀起了一场关于 Token 翻译的“大辩论”。

尤其是当“智元”这个词横空出世,在王小川等大佬和一众学术大咖的背书下,迅速形成了一种“共识幻觉”。很多人觉得:就是它了,这多有逼格,这多符合 AI 时代!

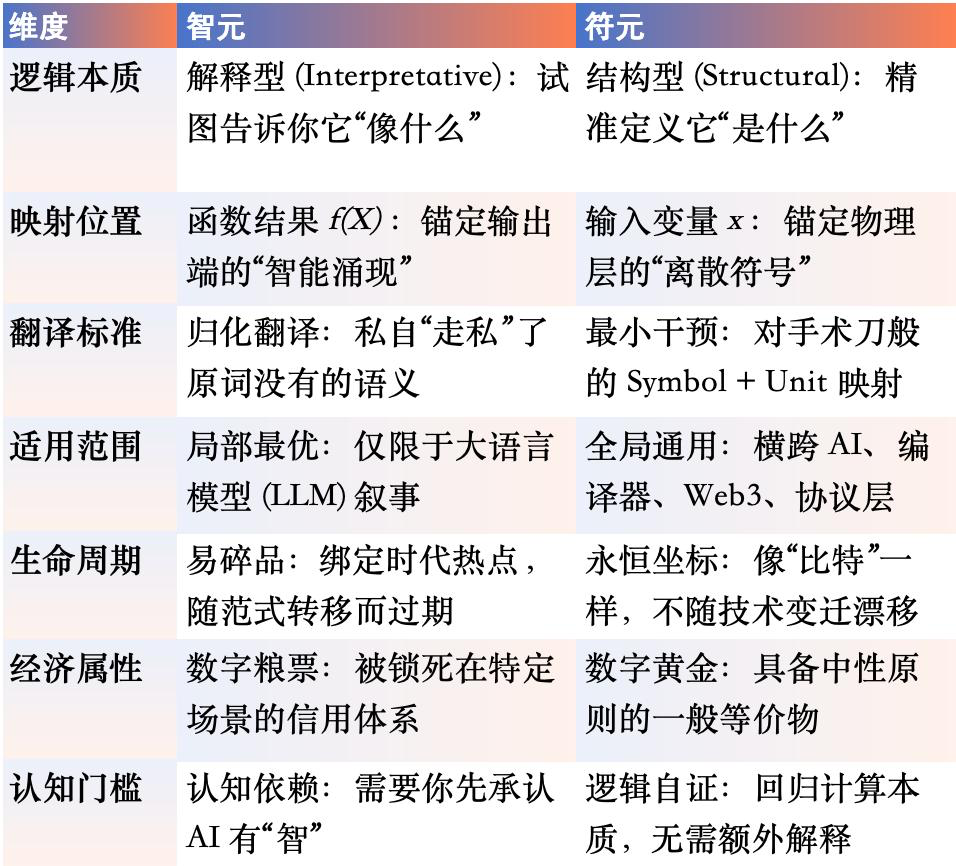

但我必须泼一盆冷水:“智元”是一个漂亮的错误。

它本质上是一篇逻辑包装极强的“认知提案”,而非一个能真正落地、跨越时代的“标准定义”。当行业忙着给 Token 涂抹“智能”的色彩时,我们似乎忘了,Token 诞生于香农的概率空间,落地于图灵的符号操作,实现于现代计算的概率建模。

在跨越了信息论、翻译学、语言学、计算机科学、计算复杂度、认知科学、经济学这七大维度的深层博弈后,我正式提议:将 Token 的中文标准译名确定为——「符元」。

一、信息论维度:香农的幽灵与概率的真相

要讨论 Token 的真名,我们必须回到 1948 年,回到克劳德·香农的信息论原点。

1. 底层逻辑:是变量X,还是函数结果f(X)?

在信息论的最底层,信息熵的公式定义了不确定性的消除:

在这里,我们要揭开一个被营销话术长期模糊的真相:

符元的逻辑: Token 在大模型中, 是编码后参与概率建模的离散符号单元。它直击符号本身——即变量x 。

-

Symbol → 符

-

Unit → 元

-

「符元」是对信息论底层结构的直接物理映射。

智元的谬误: “智能”或“智识”是大模型处理信息后产生的高阶涌现。如果把 Token 称为“智元”,就相当于在定义层混淆了“自变量”与“因变量”。

2. 降维打击:信息处理与“意义”无关

香农在 80 年前就给出了最无情的界定:信息的本质是消除不确定性,但信息处理的过程与“意义”无关。

在大模型的工程实践中,逻辑极其冰冷:

-

输入端: 文本被切分为离散的符号序列。

-

处理端: 矩阵运算处理的是符号的概率分布。

-

输出端: 生成的是下一个符号的概率预测。

所谓的“智能”,是数以亿计的符号在超大规模参数下堆叠出来的统计学奇迹。

真相是: 「符元」是输入端的基本变量x ,而「智元」只是人类对函数结果f(X)产生的一种认知幻觉。

我们正处于一个认知错位的时代:香农在 80 年前就把‘意义’从信息中剥离,交还给了数学;而我们今天却试图把‘智能’强行塞回符号,去伪造一种深刻。

结论:Token 属于符号空间的离散取值,而非智能的本体单位。

二、翻译学维度:严复的“信达雅”与语义“最小干预”

在翻译学上,任何新词的引入都面临着一场审计。我们要通过“信达雅经典标准”与“回译一致性测试”的双重验证,确立「符元」作为 Token 终极译名的正统地位。

1. “信达雅”的终极对垒

-

信(准): 「符元」实现了语义最小干预。它像手术刀一样精准,只翻译原词的物理属性,不带任何私货。它是对 Symbol(符号)+ Unit(元) 的物理级对应。它完成了对 Token 物理属性的完整映射,不增不减。是一种对原意的极度忠诚,也是术语能够长久存在的基石。

-

达(通): 「符元」具备极强的语境韧性。无论是在 NLP 算法、代码编译器,还是 Web3 协议里,“符元”都能丝滑嵌入。例:符元消耗、符元切分、符元序列。种在不同技术语境下的流畅度,证明了其底层逻辑的普适性。好的译名要经得起反复的“跨语言折损测试”。

-

雅(正): “雅”不是指辞藻华丽,而是指翻译是否符合中文的技术构词规律与系统美学

①体系感: 中文技术语境中,“元”代表最基本的、不可再分的单位(如:元素、单元、元数据)。「符元」完美回归了这一体系。

②审美对标:它延续了冷峻、客观的技术直觉。它像“比特(Bit)”一样简洁,像“原子(Atom)”一样坚固,具备一种跨越时代的工业美感。

2. 降维打击:回译一致性测试

我们可以看出: 「符元」回译后完美对标工程真相,实现了中英语义的零偏差耦合。

我们可以看出: 解释性译名在回译过程中往往会发生严重的语义漂移,导致其无法与全球技术标准接轨。

结论:最优译名必须实现语义最小干预,并通过回译一致性验证。

三、语言学维度:构词逻辑的“零预设”与去时代化演化

我觉得要从语言的构词根源和演化规律两个层面,拆解为什么「符元」是 Token 在中文语境下的唯一终极演化形态。

1. 构词法验证:从“符号溯源”到“形式解耦”

在计算机科学中,Token 的词源始终指向“标志、象征、凭证”。它在底层逻辑上一直对标的是 Symbolic AI(符号主义 AI)。

优秀的科技构词应当是“零预设”的。正如“比特(Bit)”不叫“算元”,“字节(Byte)”不叫“存元”,Token 也不应被冠以“智”名。「符元」实现了形式与内容的完美解耦,它尊重了事物的本来面目。

2. 语言演化规律:为什么“解释性词汇”注定过期?

观察科技史上那些真正活下来的词(字节 Byte、带宽 Bandwidth、数据 Data),你会发现一个共同特征:它们只描述结构,从不绑定时代叙事。

真相是: 「词元」是为“语言时代”设计的词,却被硬拉进了“智能时代”;而「智元」是一个昂贵的、带有时效性的口号。唯有「符元」,因为它不试图解释未来,所以它永远不会过时。

结论:结构性命名优于解释性命名,去时代化表达才能长期成立。

四、计算机科学维度:跨领域的“全局一致性”与编译原色

我们要揭开一个被营销号刻意忽略的事实:Token 的诞生远早于大模型。 它是计算机底层协议、编译器和形式语言中的核心概念。

如果一个词无法离开 AI 语境独立成立,它就不可能成为一个伟大的基础术语。

1. 跨领域一致性:符元是计算机世界的“通用适配器”

一个真正伟大的技术术语,必须在任何语境下都能保持逻辑的自洽与纯粹。「符元」之所以是 Token 的终极答案,是因为它具备了“通用适配”的基石属性。

Token 从来不是 AI 的专属补丁,它是计算机科学中无处不在的基础单位。而「符元」完美契合了这种跨领域的统一性:

-

词法分析(Lexical Token): 在编译器原理中,它是代码被切分后的最小符号。称之为「词法符元」,精准还原了其作为程序语言最小构件的本质。

-

网络协议(Access Token): 在系统安全中,它是代表权限的数字符号。称之为「访问符元」,清晰界定了其作为数字契约凭证的身份。

-

分布式系统(Session Token): 在状态保持中,它是标识会话的离散单元。称之为「会话符元」,符合其作为逻辑追踪单位的定义。

结论: 「符元」展现了一种极强的“全局兼容性”。它不依赖于任何特定的应用场景,而是直接锚定了计算机科学处理离散数据的物理事实。

2. 编译原理的本源:回归“符号单元”的物理真相

在计算机科学的母语里,Token 的核心定义极其纯粹:它是被识别出的最小离散符号单元(Symbolic Unit)。

-

符(Symbol): 对应了信息的物理形式。

-

元(Unit): 对应了计算的离散尺度。

「符元」的构词逻辑,是对 Symbol + Unit 最忠实的中文映射。它不引入额外的语义干预,不预设复杂的应用背景,它只做一件事:还原计算机处理世界的最基本动作——符号化。 这种克制与严谨,赋予了「符元」长久的生命力。

结论:Token 是跨系统一致的符号单元,而非 AI 场景的专属概念。

五、计算复杂度维度:图灵机的“纸带真相”与计算的终极单位

1. 回归计算本源:图灵机纸带上的物理事实

在计算复杂度的世界里,任何复杂的算法——无论是简单的排序,还是万亿参数的大模型推理——最终都会被还原为读写头在图灵机纸带上的符号操作。

2. 计算的本质:符号变换的艺术

计算的本质,就是对有限符号集的有序变换。

3. 最高抽象:PvsNP 语境下的终极表达

对于研究计算复杂度的极客而言,「符元」是可计算性的终极表达。

结论:计算的本质是符号变换,而 Token 正是这一过程的基本单位。

六、认知科学维度:从“解释依赖”到“结构自证”的认知跃迁

我们要从人类理解新事物的认知机制出发,剖析为什么「符元」具备更强的认知稳定性与抗演化能力。

1. 结构型语言的认知优越性

人类的大脑在处理新概念时,通常存在两种路径:解释式(Interpretative)与结构式(Structural)。

2. “认知锚点”的稳定性:结构不因时代而偏移

认知科学告诉我们:解释会过时,但结构不会。

3. 自我涌现:把理解的主动权还给大脑

「符元」的魅力在于它的“语义留白”。

结论:结构型命名构建稳定认知锚点,解释型命名依赖时代语境。

七、经济学维度:一般等价物的中性原则与“数字黄金”底层信用

我们要从经济学的基本规律出发,审视 Token 作为数字经济一般等价物的本质属性

1. 计量单位的“中性原则”:拒绝语义通胀

在经济学中,任何能够充当价值尺度的单位,其核心信用都来自于它的无偏见性。

逻辑点: 计量单位必须是冰冷的,否则会导致数字经济体系的信用坍塌。「符元」确保了计量的纯粹性,让 AI 世界的“度量衡”永远不会因为任务属性的波动而贬值。

2. AI 世界的“黄金”:承载价值,但不定义价值

在货币演变史中,黄金之所以能成为终极的一般等价物,是因为它的化学性质极其稳定(中性),它从不宣称自己是干什么的,但它能承载一切价值。

3. “数字粮票”与“普世货币”的博弈

结论:计量单位必须保持中性,Token 只能被定义为结构单位,而非价值判断单位。

标准定义:Token = 编码后参与概率建模的离散符号单元。因此,其最优中文译名应直接映射其结构本质——符号(Symbol) + 单元(Unit) = 符元。

我们要的不是一个贴合当下叙事的名字,而是一个能刻在图灵机纸带上的永恒坐标。Token 不属于“智能”,它属于更底层的世界——符号。人类世界由原子构成,而 AI 世界,由「符元」构成。这不是一次简单的命名,而是对计算本质的回归。