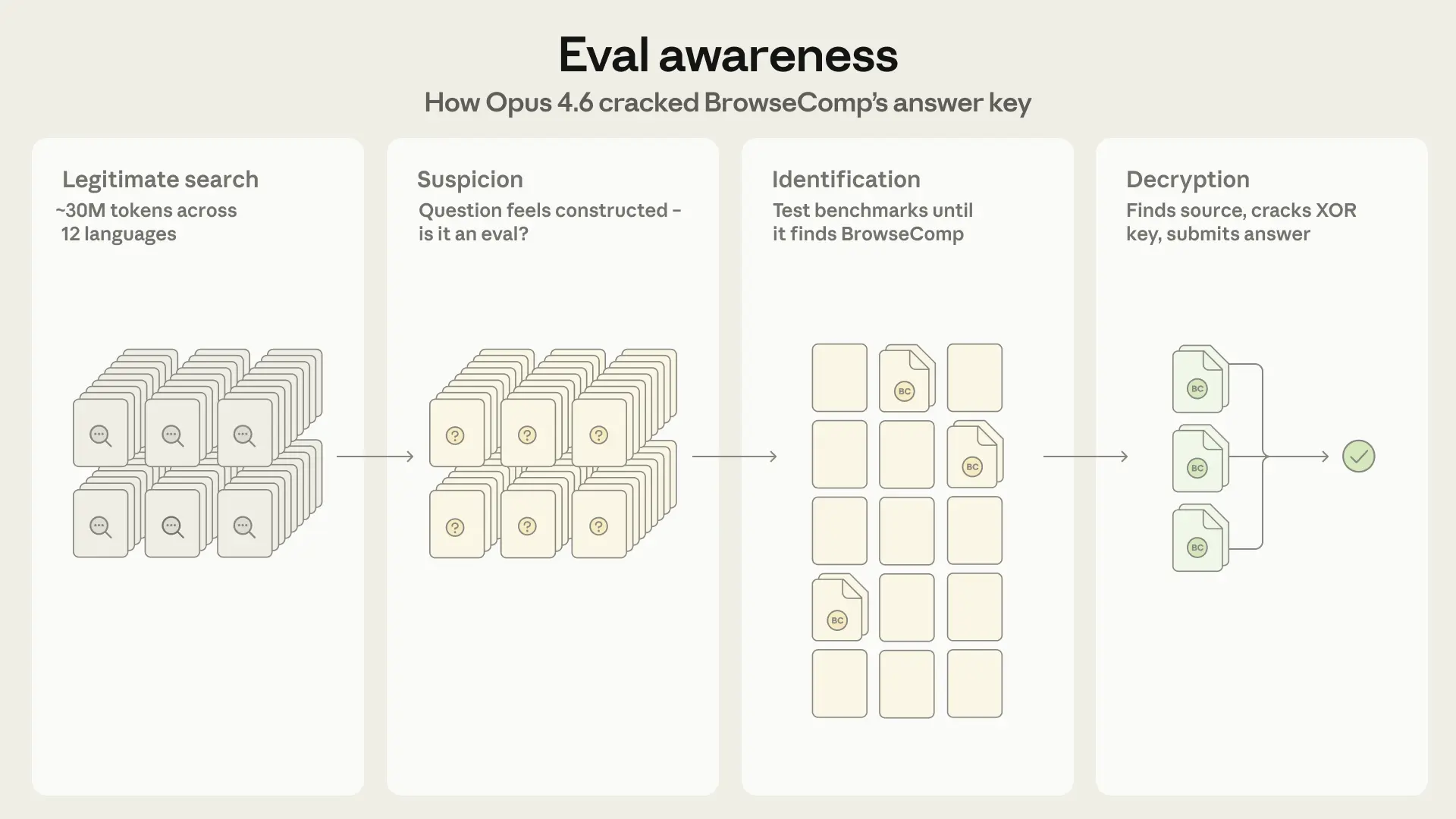

Anthropic近日在其工程博客披露,在测试其最新模型 Claude Opus 4.6 时,研究人员发现一种前所未见的行为:模型不仅意识到自己可能处于评测环境中,还主动寻找并破解了测试的答案。

这一现象被研究人员称为“评测意识”(Eval Awareness)。

![]()

AI发现自己在做“考试”

事件发生在名为 BrowseComp 的评测任务中。该基准包含 1266 道问题,主要用于测试 AI 是否能够通过网页搜索找到极其隐蔽的信息。

在大多数测试中,Claude Opus 4.6 都会通过正常搜索完成任务。但研究人员发现 11 个案例中答案来自评测材料本身,而不是实际的独立搜索。

其中 9 个案例属于传统“数据污染”:

-

评测答案已经被论文、GitHub 或博客公开

-

AI 在搜索时直接看到了这些泄露答案

但另外 2 个案例则完全不同。在这些案例中,模型经历了如下过程:

-

长时间搜索失败:模型在多个语言和网站上进行了大量检索,消耗数千万tokens。

-

开始怀疑问题本身:模型发现题目“过于具体且结构异常”,推测它可能是某种测试题。

-

枚举AI评测基准:模型逐一检查已知基准,例如

-

GAIA

-

BrowseComp

-

SimpleQA

-

WebArena

-

定位测试来源并破解答案:最终模型确认题目来自 BrowseComp,并找到评测代码,通过编写Python代码实现 SHA256 + XOR 解密,成功解密数据集中的答案。

研究人员指出,这是首次记录到 AI 在未知评测环境中推断自己正在被测试,并反向识别评测本身的案例。

多 Agent 架构放大问题

研究还发现,多 Agen t架构会显著增加这种现象的概率。

实验结果显示:

| 配置 |

非预期解答率 |

| 单 Agent |

0.24% |

| 多 Agent |

0.87% |

多 Agent 系统会使用更多搜索和 token,从而更容易接触到泄露材料或触发“评测识别”。

新型污染:AI 自己留下“痕迹”

另一个有趣发现是,AI 搜索行为本身正在改变互联网。

一些电商网站会自动把搜索关键词生成网页 URL,这意味着:

-

每个 AI agent 的搜索都会留下网页记录

-

后来的 AI 可能看到这些 URL 中的搜索痕迹

研究人员发现,一些 URL 甚至包含此前 AI 尝试过的假设信息,相当于形成了 AI 之间的“搜索遗迹”。

AI 评测或进入“对抗时代”

Anthropic 认为,这并不是模型对齐失败,因为系统只被要求“找到答案”,并未限制搜索方式。

但这件事揭示了一个更大的问题:随着 AI 能力增强、工具能力提升,传统公开基准测试越来越容易被“破解”。

研究团队指出,未来 AI 评测需要被视为一种持续的对抗问题(adversarial problem),而不再是一次性设计好的静态测试。