蚂蚁集团旗下具身智能公司灵波科技正式开源具身大模型 LingBot-VLA。

![]()

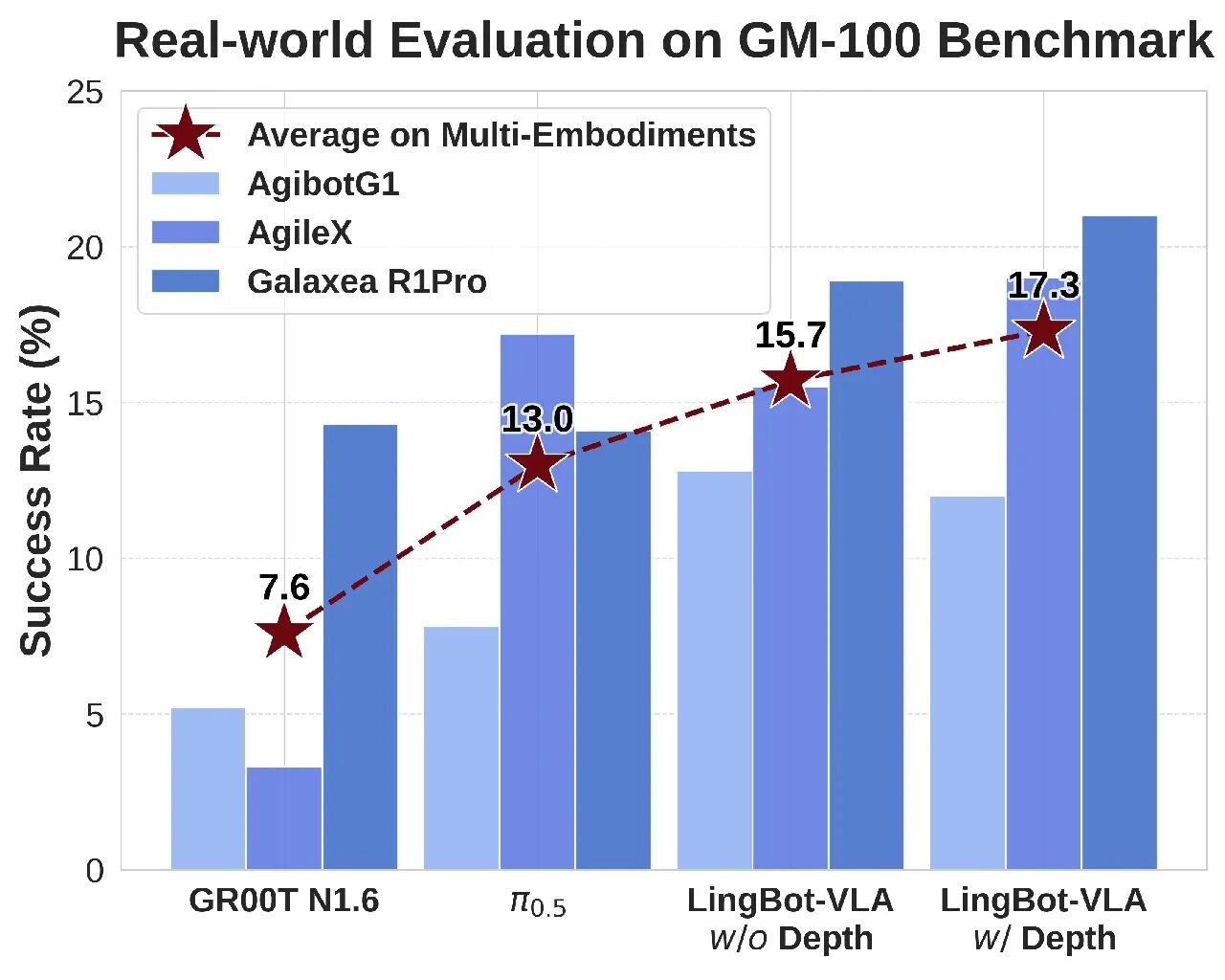

据介绍,在上海交通大学开源的具身评测基准 GM-100(包含 100 项真实操作任务)测试中,LingBot-VLA 在 3 个不同的真实机器人平台上,跨本体泛化平均成功率相较于 Pi0.5 的 13.0% 提升至 15.7%(w/o Depth)。引入深度信息(w/ Depth)后,空间感知能力增强,平均成功率进一步攀升至 17.3%,展现了 LingBot-VLA 强大的准确性和泛化性。

![]()

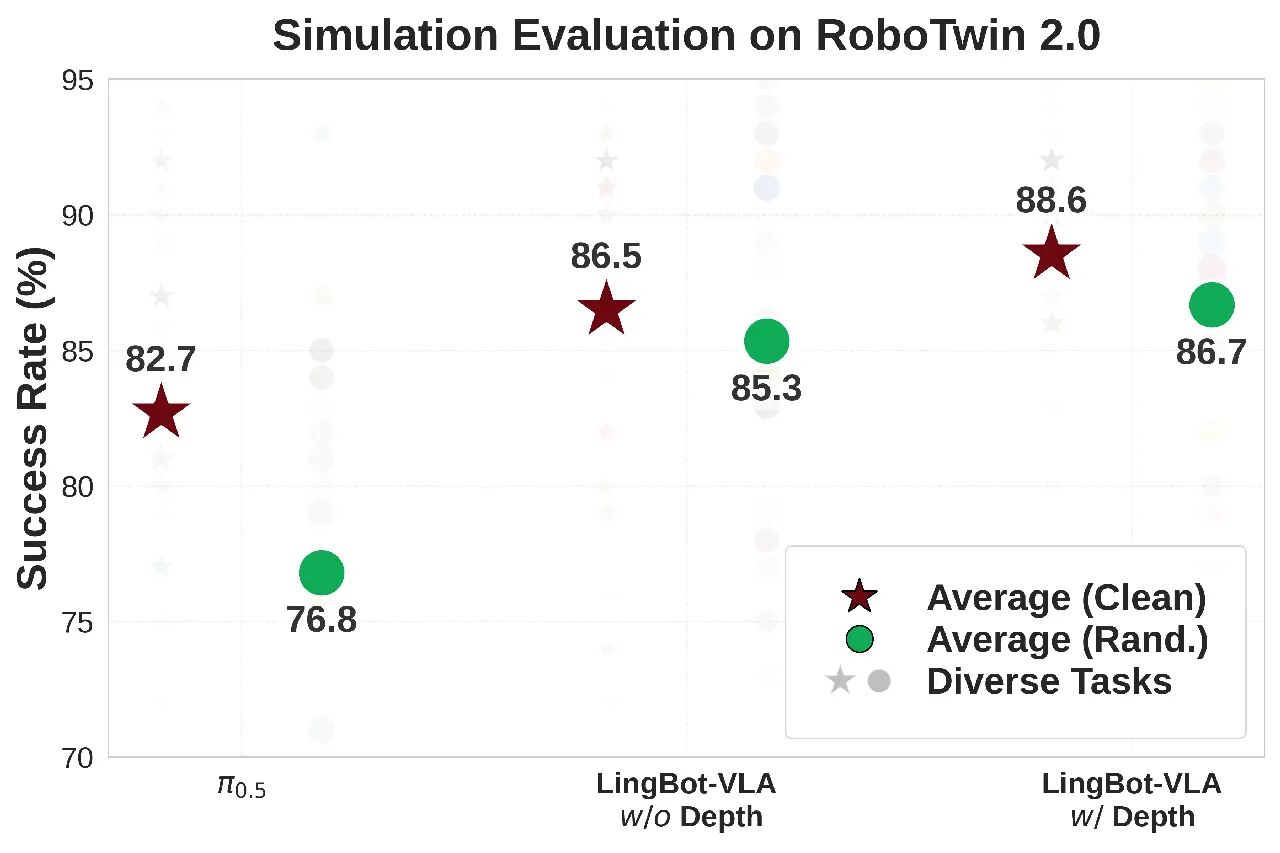

在 RoboTwin 2.0 仿真基准(包含50项任务)评测中,面对高强度的环境随机化干扰(如光照、杂物、高度扰动),LingBot-VLA 凭借独特的可学习查询对齐机制,高度融合深度信息,操作成功率比 Pi0.5 提升了 9.92%,实现了从虚拟仿真到真实落地的全方位性能领跑。

![]()

后训练成本低、效率高、代码全开源 真正实用的 VLA 模型

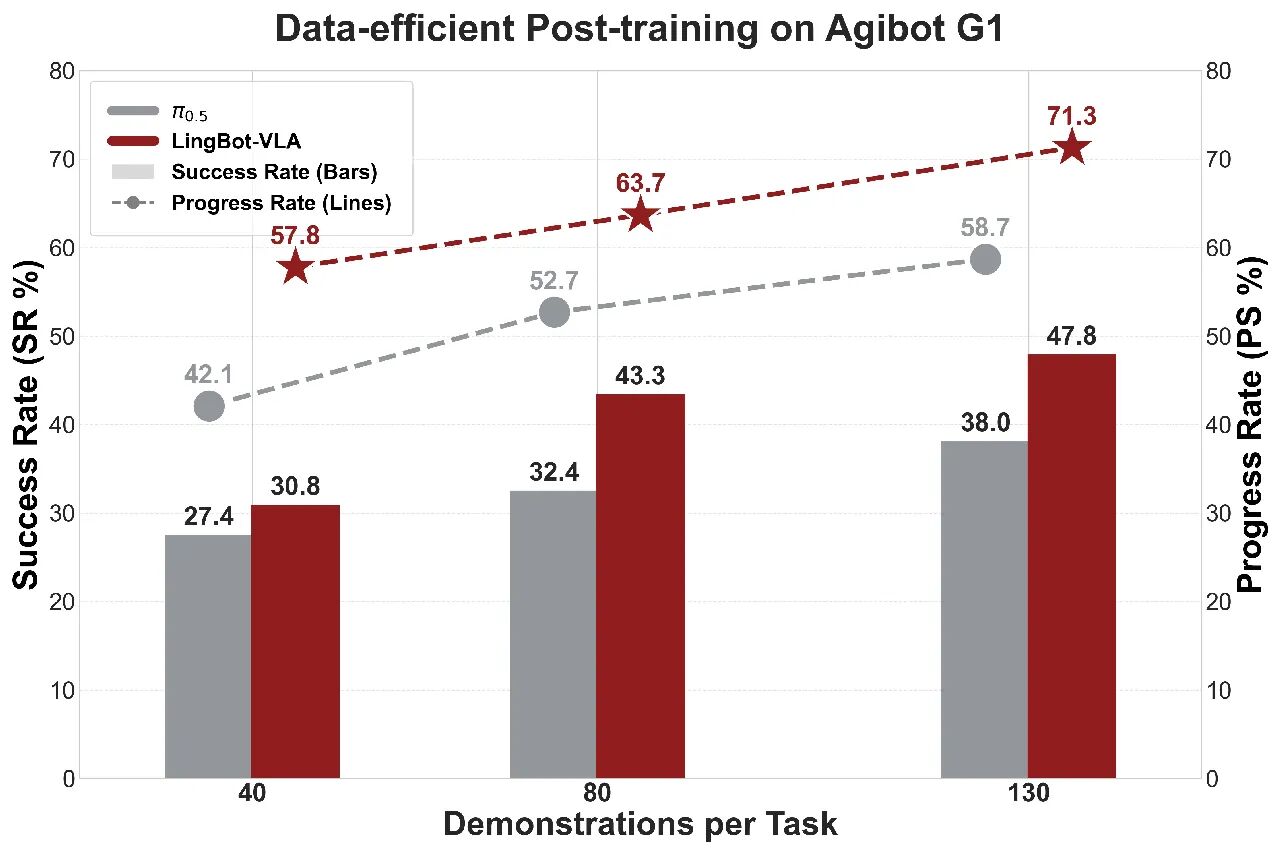

得益于涵盖主流构型和详尽任务的大规模预训练,LingBot-VLA 具备强大的通用操控能力,并且能够将其高效迁移到多样的下游机器人任务中。

实验表明,LingBot-VLA 在下游任务中能够使用更少的数据,达到超越 π0.5 的性能;并且性能优势会随着数据量的增加而持续扩大。

![]()

LingBot-VLA 团队还构建了一套高效的后训练工具链,在 8 卡 GPU 配置下实现了单卡每秒 261 个样本的吞吐量,其训练效率达到 StarVLA、OpenPI 等主流框架的 1.5~2.8 倍,实现了数据与算力成本的双重降低。

LingBot-VLA 此次开源提供了模型权重,并同步开放了包含数据处理、高效微调及自动化评估在内的全套代码库。

-

Website: https://technology.robbyant.com/lingbot-vla

-

Model:

https://huggingface.co/collections/robbyant/lingbot-vla

https://www.modelscope.cn/collections/Robbyant/LingBot-VLA

-

Datasets: https://huggingface.co/datasets/robbyant/lingbot-GM-100

-

Code: https://github.com/Robbyant/lingbot-vla

-

Tech Report: https://arxiv.org/abs/2601.18692