腾讯开源 WeChat-YATT:微信强化学习大模型训练库

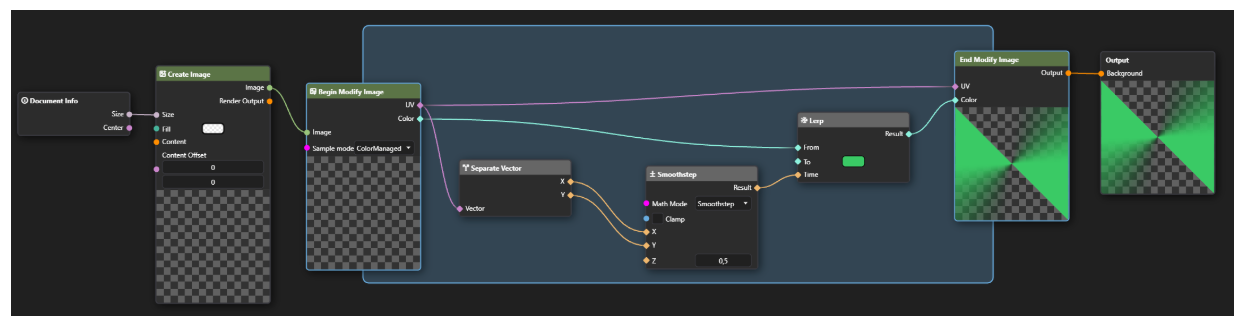

腾讯基于 Megatron-Core和SGLang/vLLM研发了大模型训练库WeChat-YATT(YATT,Yet Another Transformer Trainer),内部项目名为gCore,专注于强化学习和多模态模型的训练,旨在提供易扩展、简洁、高效、可靠的大模型训练能力。 通过定制化的并行计算策略,其训练库能够处理大尺寸模型、长序列输入和大数据集场景,解决了微信中多个实际场景的痛点问题,显著提升了业务训练大模型的效率。此工具为研究人员和开发者提供了灵活且可扩展的解决方案,以推动多模态和强化学习领域的创新发展。 并提出 WeChat-YATT训练库,解决了大模型分布式训练过程中面临的两大核心痛点: 多模态场景下的可扩展性瓶颈:随着多模态数据(如图像、视频)规模的不断增长,传统架构中由SingleController进行数据管理,容易成为通讯和内存的瓶颈,导致系统吞吐量受限,甚至引发训练流程异常中断。WeChat-YATT 通过引入Parallel Controller的并行管理机制,有效分散压力,大幅提升系统的可扩展性和稳定性,更好地应对多模态、大数据量的复杂场景。 动态采...