本文分享自华为云社区《【手把手带你玩转HetuEngine】(一)HetuEngine快速上手》,作者:HetuEngine九级代言。

HetuEngine是什么

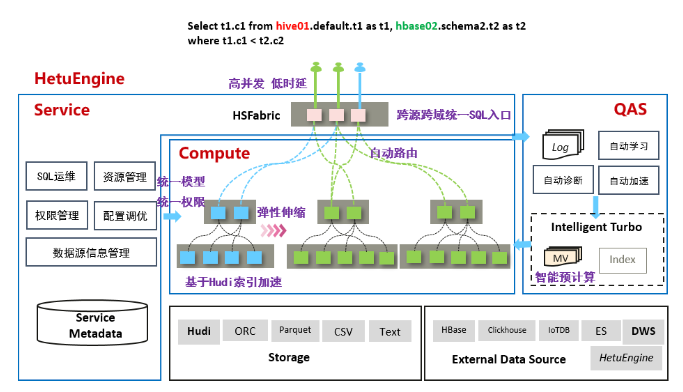

HetuEngine是华为推出的高性能交互式SQL分析及数据虚拟化引擎。与大数据生态无缝融合,实现海量数据秒级交互式查询;支持跨源跨域统一访问,使能数据湖内、湖间、湖仓一站式SQL融合分析。

HetuEngine适合做什么

![]()

- 适用于Hadoop集群(FusionInsight MRS)的Hive、Hudi数据源的交互式快速查询场景;

- 适用于跨源(多种数据源,如Hive,Hudi,HBase,GaussDB(DWS),Elasticsearch,ClickHouse等)查询;

- 适用于跨域(多个地域或数据中心)的快速联合查询;

- 不擅长大批量、复杂逻辑的跑批处理、创建事务、数据入库操作等。

HetuEngine特点

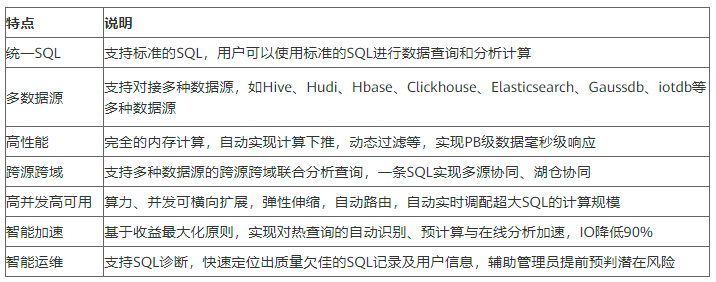

HetuEngine基本架构

HetuEngine面向企业级能力方面,构建了极致稳定、高性能的企业级交互式分析引擎。

- 云服务层:提供了企业级的运维管理监控能力,认证与业务接入统一访问入口,友好的可视化界面操作,一键式参数调优和配置,协助用户轻松简单的管理集群平台;

- 引擎层:纯计算引擎部署,与数据解耦;自容错,节点故障级别重启,内存溢出保护等;计算实例基于任务负载自动弹性伸缩,可水平横向扩展;

- 数据层:支持多种常见的数据源间的联合查询,同时计算和数据解耦,天然的存算分离架构。

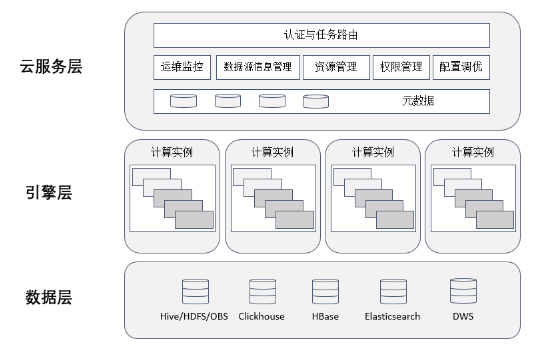

HetuEngine服务角色

HeuEngine引擎架构

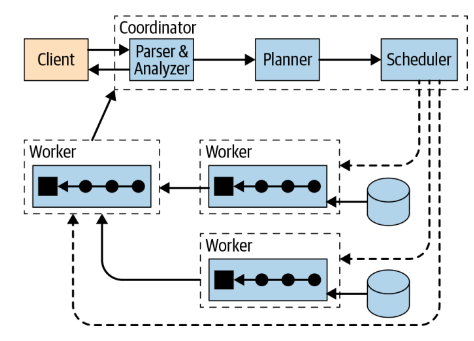

HetuEngine引擎执行流程简单介绍:

![]()

Coordinator

负责管理Worker节点,以及接受客户端查询请求,并进行SQL的语法解析(Parser)、执行计划生成与优化(Plannner)和查询任务的调度(Scheduler)

Worker

负责具体的查询计算和数据读写

Discovery Server

负责发现集群的各个节点,用于节点间心跳监控

快速上手指南

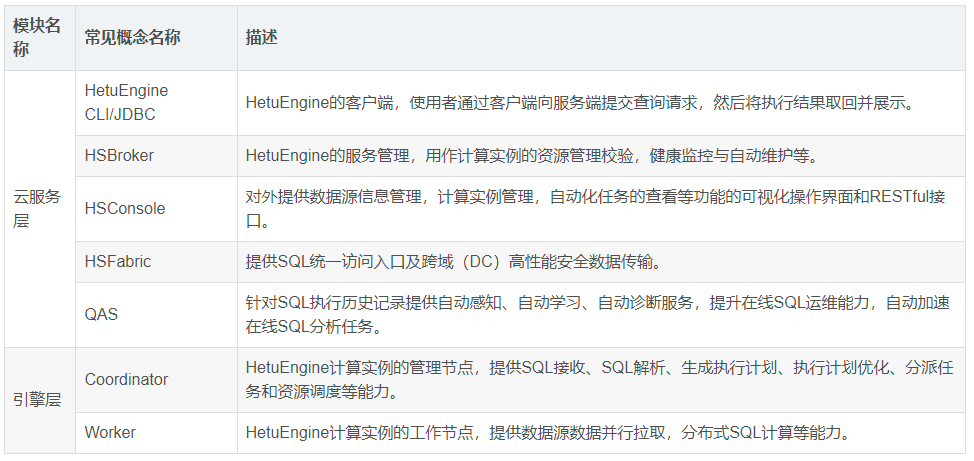

工欲善其事必先利其器,在使用HetuEngine之前,首先需要了解基本的架构,并与业务场景相结合,然后进行集群相关的规划和配置,最后进行业务对接和验证上线。本系列将从以下几方面内容手把手带你玩转HetuEngine。

![]()

- 了解HetuEngine的基本架构:了解HetuEngine是什么

- 了解HetuEngine常见的应用场景,与业务场景相结合:判断HetuEngine是否适应于业务场景

- 集群部署和资源规划:前期的资源规划必不可少

- 数据源添加和管理:对接业务需要的数据源

- 权限管控和配置:保障不同业务用户之间的权限管控

- 业务对接:业务对接和验证

- 性能调优:不同的调优手段

- 运行过程中常见问题排查:常见问题的处理方式

点击关注,第一时间了解华为云新鲜技术~