Simple Admin - Go 语言分布式后台管理系统 v1.0.7 发布

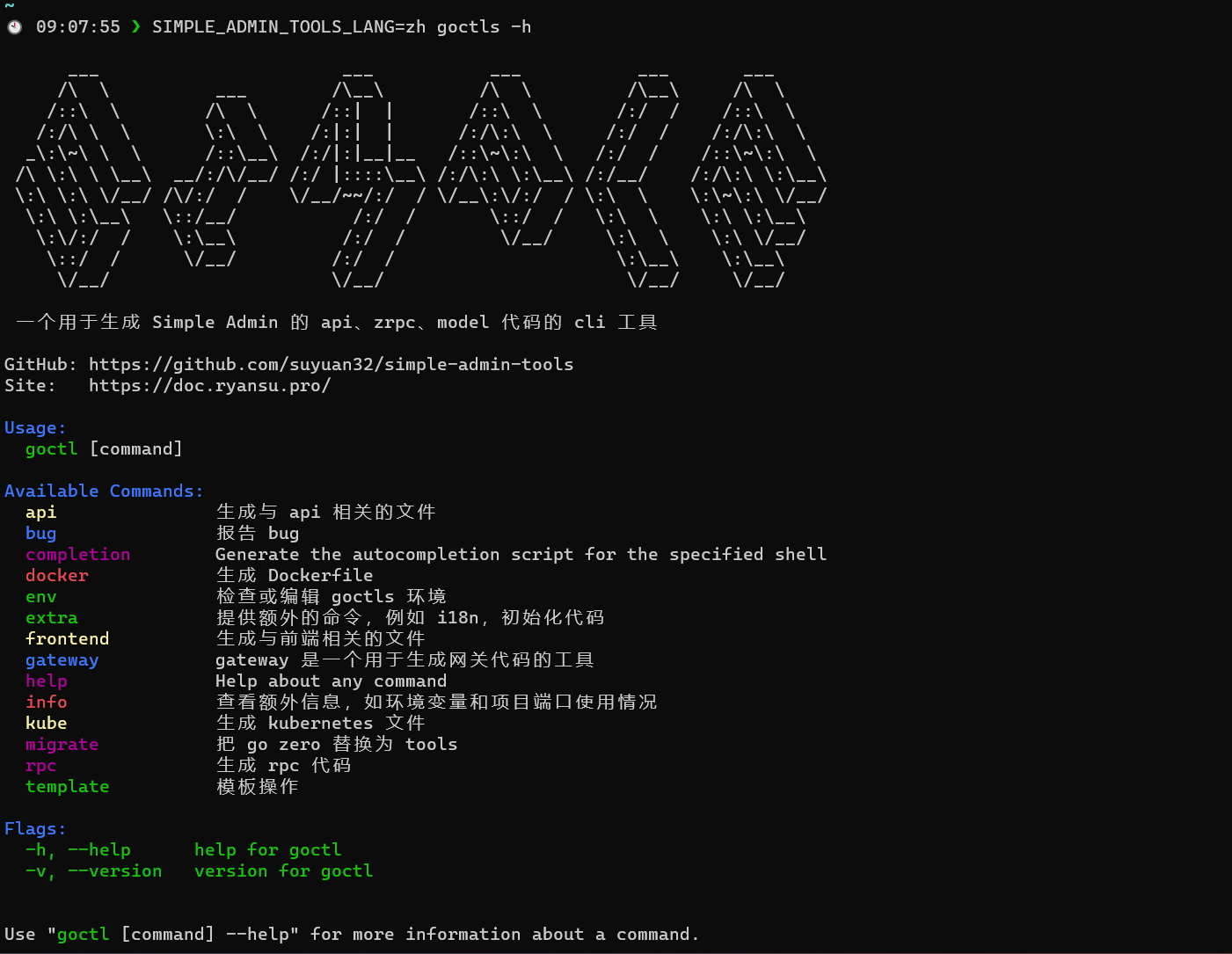

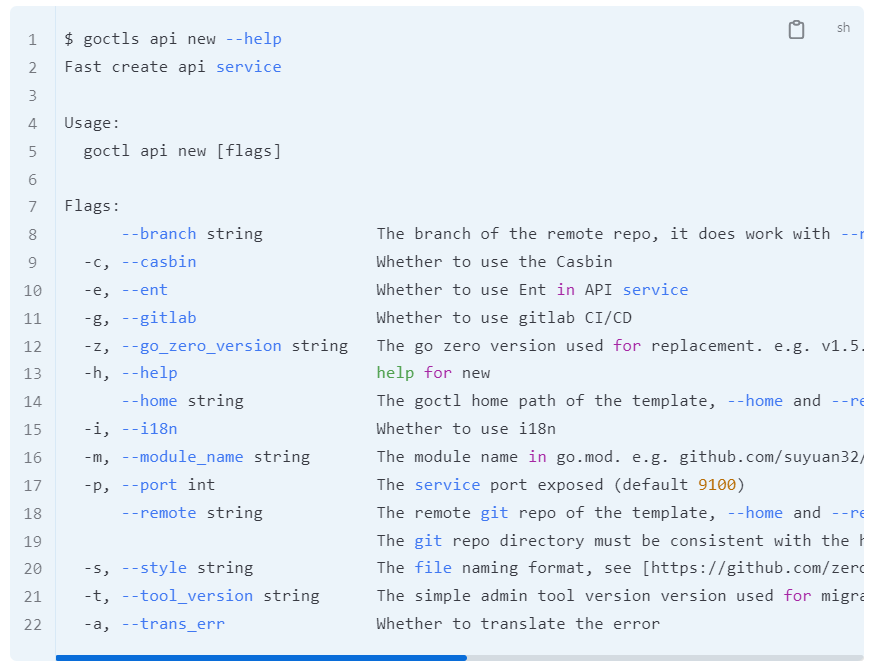

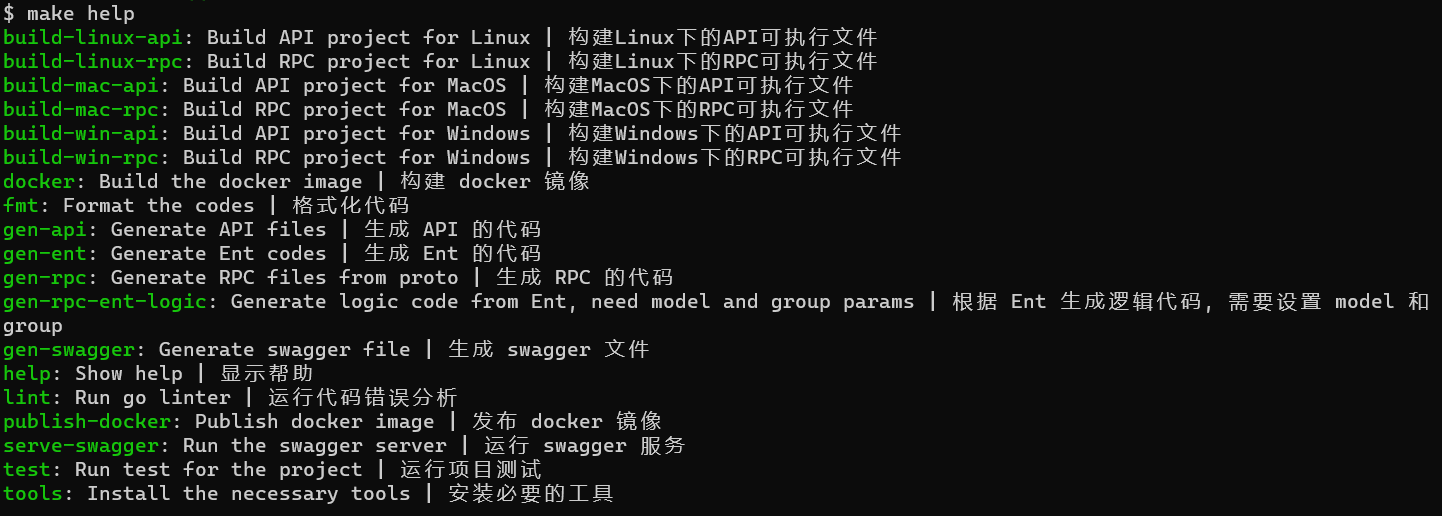

Simple Admin Tools V1.5.8 更新 修复: Ent 特殊词库优化 新增: i18n 环境变量 优化: parse 错误处理 优化: 合并最新代码并更新依赖 Simple Admin Common v1.0.7 更新 新增: i18n 外部文件读取 Simple Admin Backend UI v1.0.7 更新 修复: 删除多余的提示信息 Simple Admin Core v1.0.7 更新 优化: 更新 all in one 镜像和环境变量 新增: i18n 已支持读取外部文件,由于 core 的 i18n 接入其他服务时经常需要修改,现提供读取外部文件功能,方便修改 修复: 字典详情模糊搜索bug 项目文档页面现已支持搜索,欢迎体验 项目文档: 点击查看 Gitee: https://gitee.com/hopefire/simple-admin-core Github:https://github.com/suyuan32/simple-admin-core