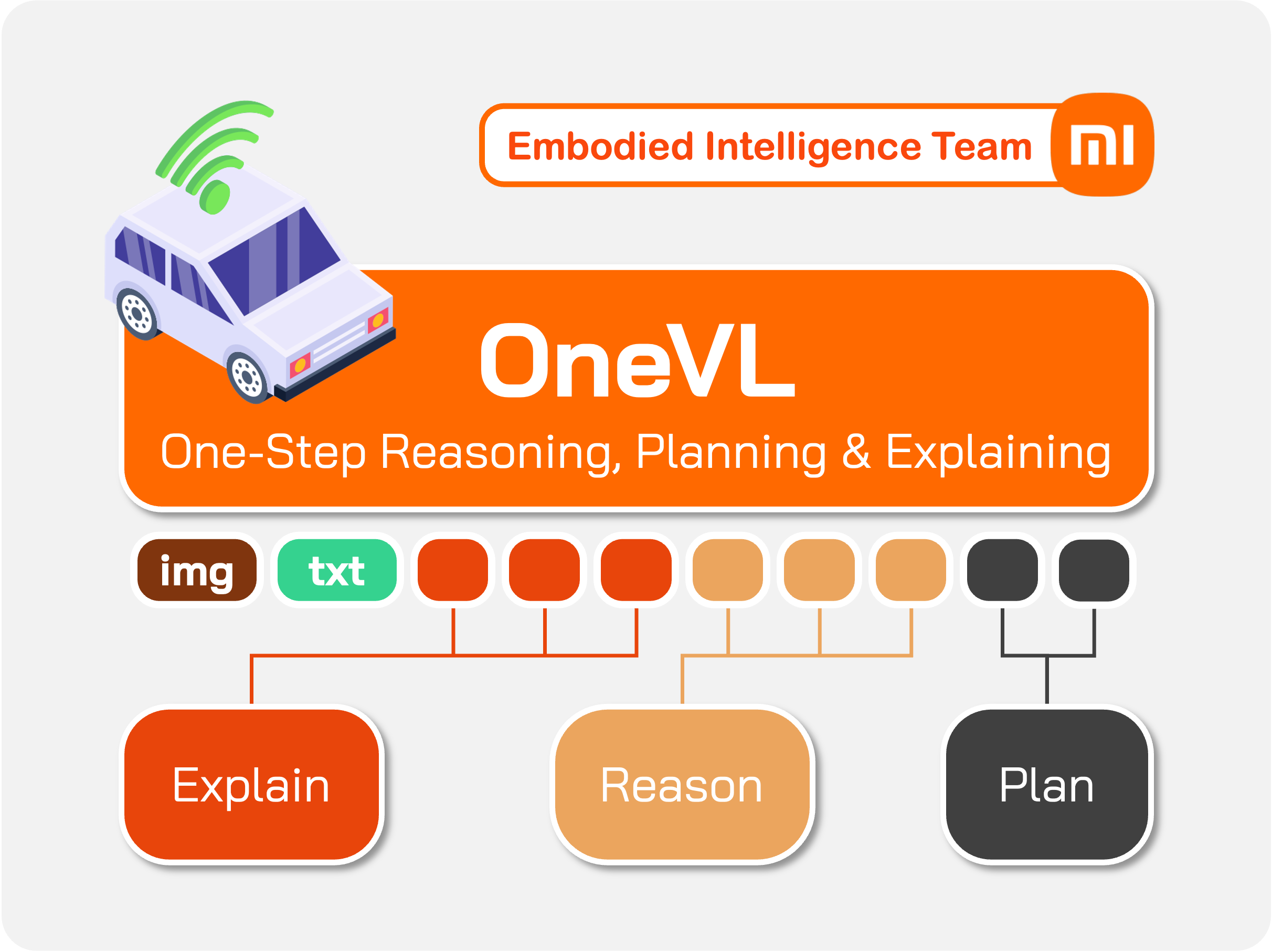

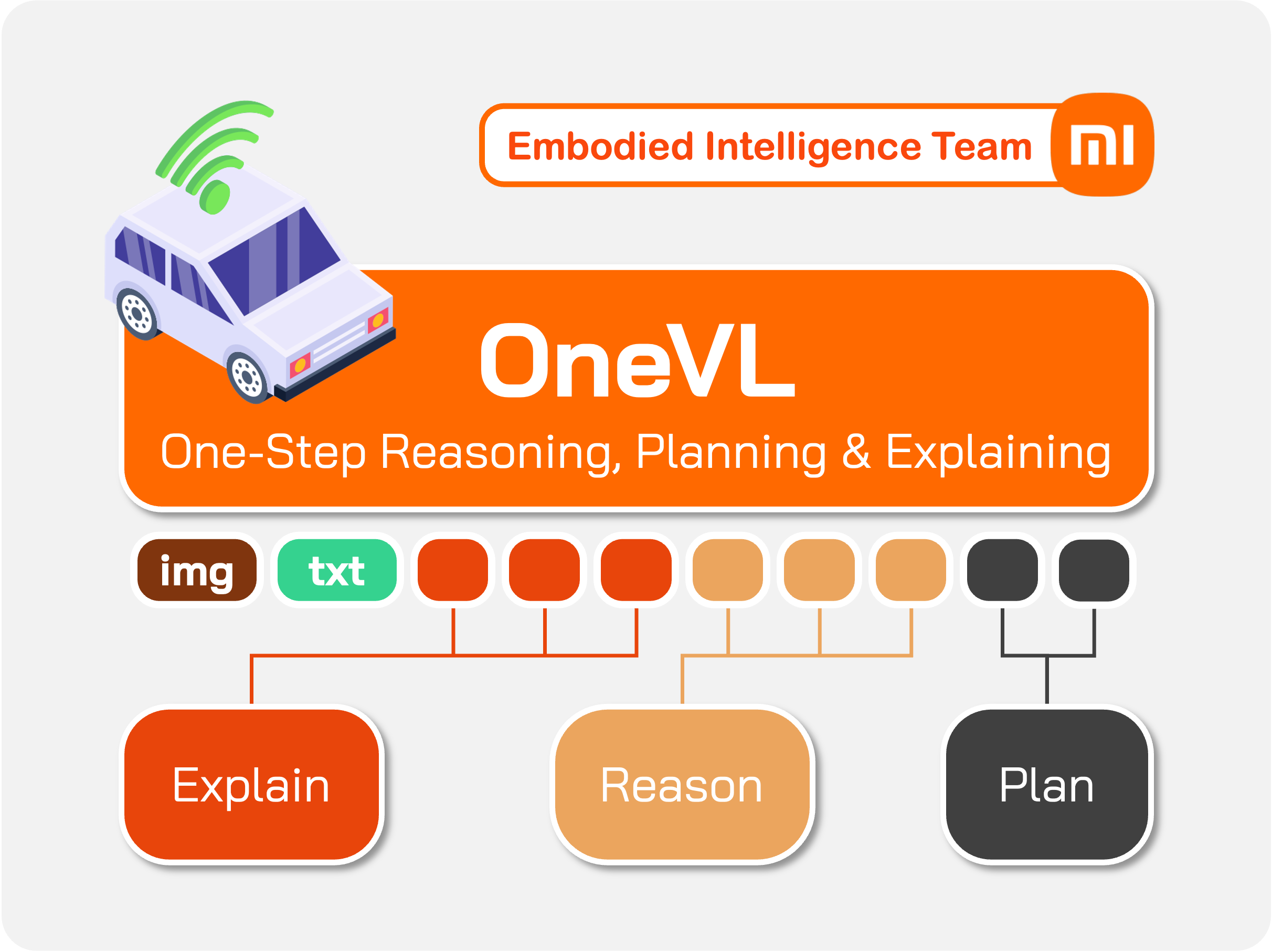

小米研究院近日发布了名为 OneVL 的新型视觉-语言模型架构,旨在解决多任务学习中的核心挑战:如何让单一模型同时处理图像识别、目标检测、视觉问答和图像分割等多种任务。

现有的视觉-语言模型通常采用"专家混合"架构,即为每种任务训练专门的组件。这种方式虽然在某单一任务上效果出色,但随之而来的是高昂的推理成本和部署复杂度。更重要的是,不同任务间的视觉特征表示存在大量重叠,单独训练专家会导致严重的知识冗余。

OneVL 的核心创新在于提出了"层级化任务编码"机制。该方法首先将所有视觉任务映射到统一的 token 序列表示,然后在 transformer 架构中引入任务相关的路由注意力。实验数据显示,相比传统专家混合方法,OneVL 在保持相近精度的同时,将模型参数量减少了约 40%,推理速度提升超过 2 倍。

在架构设计上,OneVL 采用双路径编码策略:一路负责捕获图像的细粒度局部特征,另一路则提取全局语义信息。两路特征通过可学习的交叉注意力模块进行融合,使模型能够同时理解"是什么"(物体类别)和"在哪里"(空间位置)两个维度的信息。

研究人员选择在 8 个主流视觉基准上评估 OneVL,包括 COCO 目标检测、ADE20K 语义分割和 VQA v2.0 视觉问答等任务。结果表明,OneVL 在多任务场景下相比单任务专家组合平均提升 3.2 个百分点,同时大幅降低了跨任务干扰现象。

OneVL 以仅 4B 参数在四个基准(NAVSIM、ROADWork、Impromptu、Alpamayo-R1)上均达到最优,超越此前的 8B 方法:

| 基准 |

OneVL 结果 |

延迟 |

| NAVSIM |

88.84 PDM |

4.46s |

| ROADWork |

12.49 ADE (px) |

4.71s |

| Impromptu |

1.34 ADE (m) |

4.02s |

| Alpamayo-R1 |

2.62 ADE (m) |

3.23s |

值得关注的是,OneVL 的预训练数据规模达到 4500 万图像-文本对,涵盖自然场景、文档图像、表格数据等多种类型。这种多样化的预训练策略使模型具备较强的零样本迁移能力,研究者观察到模型在没有见过的任务上也表现出一定的推理能力。

论文作者指出,他们下一步将探索 OneVL 在视频理解领域的应用潜力。当前的图像级表示将扩展到时空维度的建模,以支持视频帧间的长程依赖关系学习。

相关论文及代码已公开于项目页面。