由 OpenAI 前首席技术官 Mira Murati 等人创立的 Thinking Machines Lab 近日发布了一项重要研究预览——交互模型(Interaction Models)。该模型旨在突破传统"一轮一问"的 AI 交互范式,让人与 AI 的协作方式更接近人与人之间自然的实时对话。

当前主流的大语言模型采用的是轮次制(turn-based)交互架构:用户说完,模型等待,然后生成回复。这种模式下,"在用户完成输入之前,模型对用户正在做什么、怎么做一无所知;在模型生成完成之前,它的感知也处于冻结状态。" Thinking Machines Lab 认为,这形成了一条狭窄的通道,限制了人类知识和意图向模型传递的带宽。

交互模型的核心理念是将交互能力内嵌到模型本身,而非依赖外部脚手架。它使用 200 毫秒的微轮次(micro-turns)持续交错处理输入和生成输出,使输入和输出 token 都被视为流式数据。这一设计带来了多项原生能力:无缝对话管理(追踪发言者是在思考、让渡还是邀请回应)、基于语境的口头和视觉插话、实时翻译中的同步语音、直接的时间感知,以及在说话和倾听的同时并行调用工具、搜索和生成 UI。

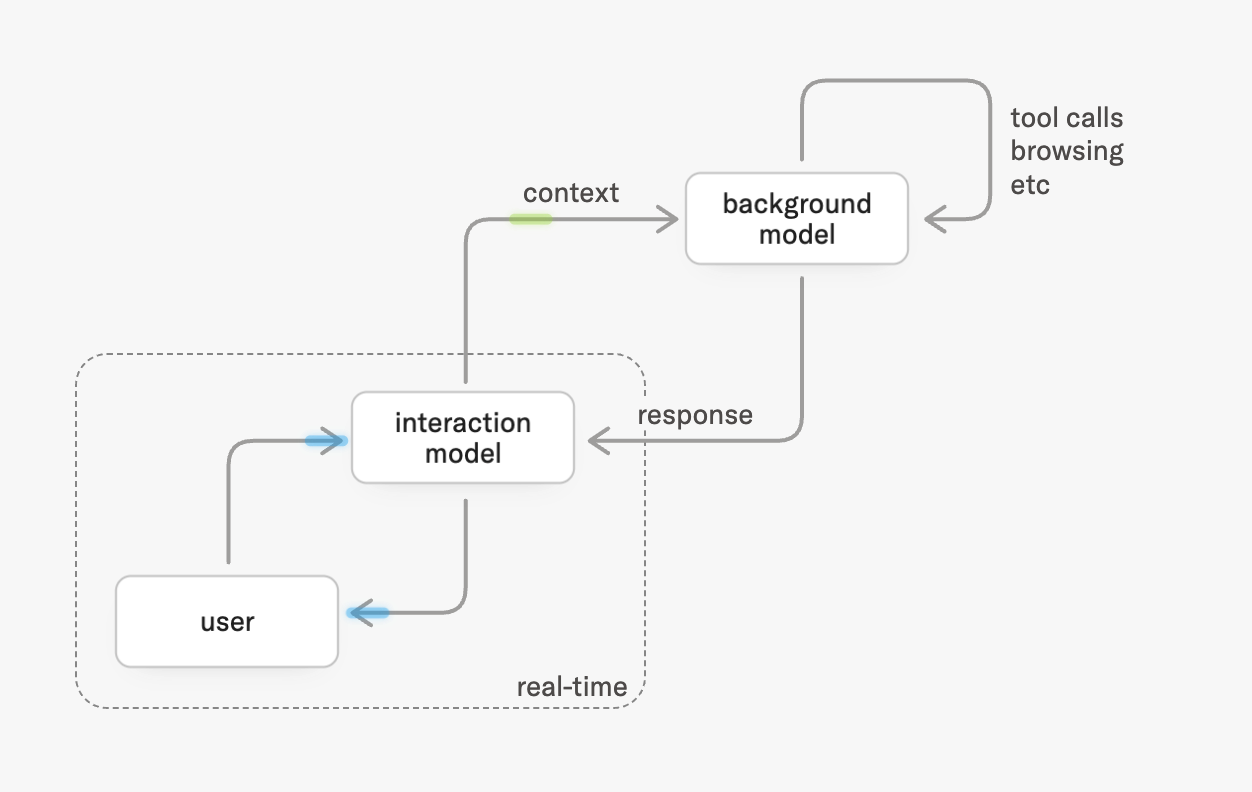

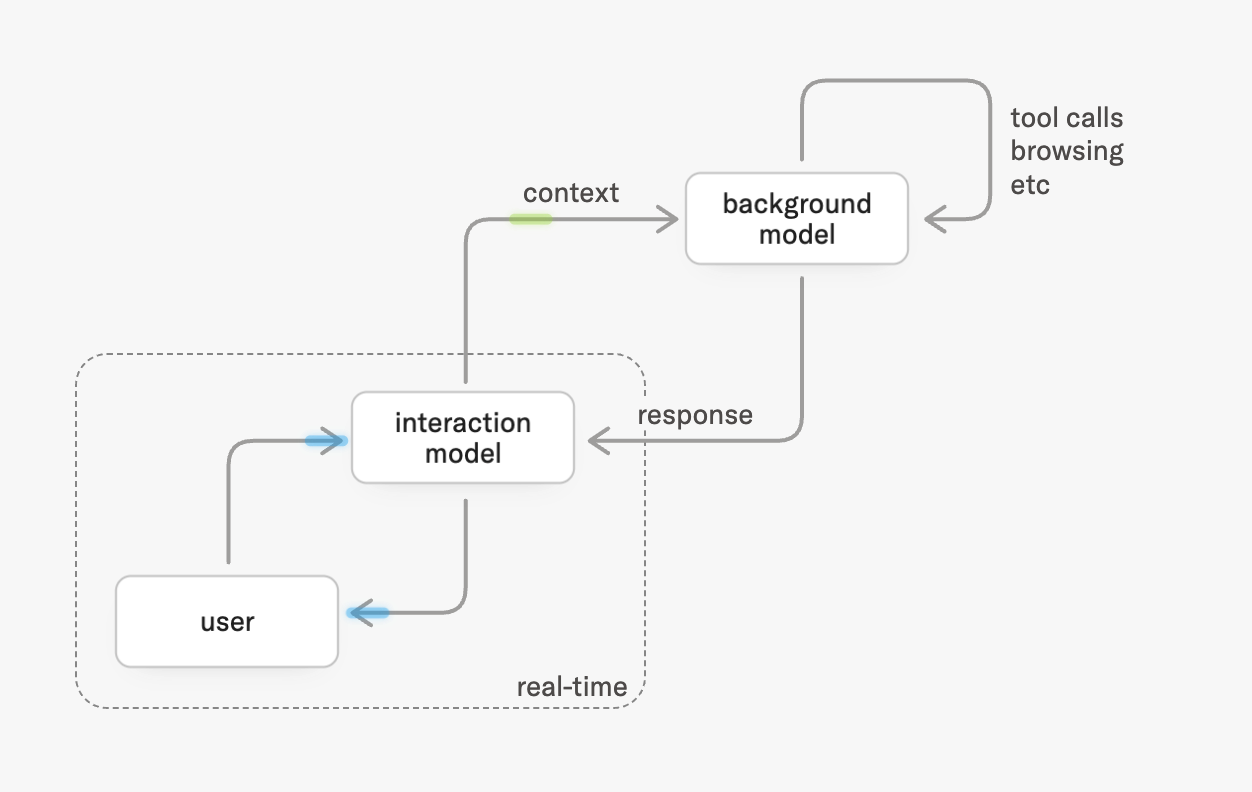

架构上,系统由两个组件协同工作:一个实时交互模型持续与用户保持交流,一个异步后台模型处理需要更深层次推理的任务。当遇到无法即时完成的复杂问题时,交互模型会将任务委托给后台模型,并在结果返回时无缝整合。

在基准测试方面,TML-Interaction-Small 模型在 FD-bench v1.5 交互性评测中平均质量得分达到 77.8,远超竞争对手的 46.8-54.3;轮次切换延迟仅为 0.40 秒,而其他模型在 0.57-2.14 秒之间。在 Audio MultiChallenge 智能基准测试中,该模型以 43.4% 的准确率超过了非思考型模型。

值得一提的是,在一些全新设计的评测任务中,交互模型展现了前所未有的能力:TimeSpeak 任务准确率 64.7%(对比 GPT-realtime-2 的 4.3%)、CueSpeak 81.7%(对比 2.9%)、视觉计数 RepCount-A 35.4%(对比 1.3%)。研究团队表示,"现有模型在这些任务上几乎无法有意义地执行"。

目前该模型采用 2760 亿参数 MoE 架构(激活参数 120 亿),仍处于研究预览阶段,长期会话的上下文管理、实时对齐与安全性等方面仍在持续完善中。

参考来源:https://thinkingmachines.ai/blog/interaction-models/