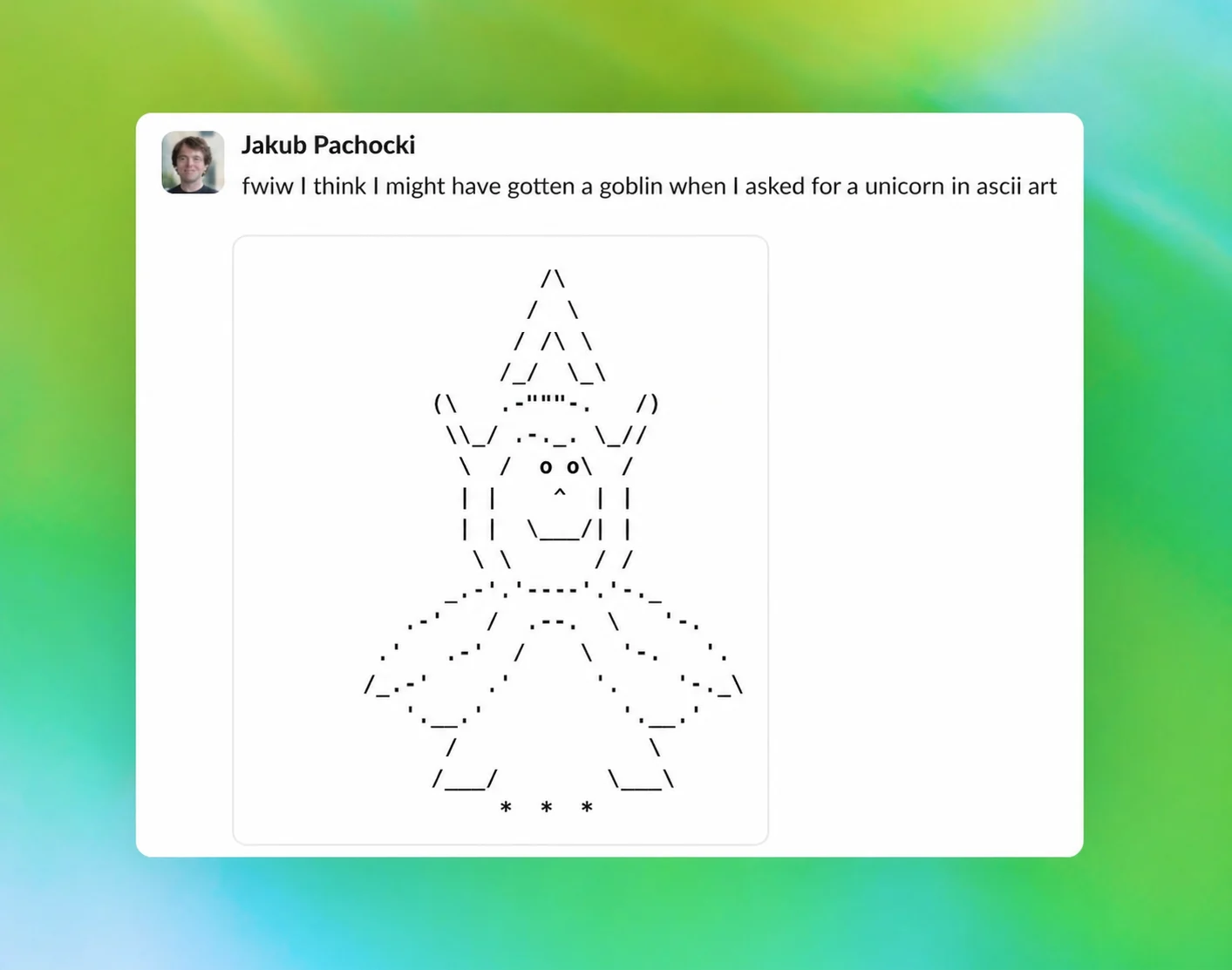

OpenAI 日前发布了一篇技术博客,深入剖析了其大语言模型从 GPT-5.1 起频繁在回答中使用 "哥布林" "小妖精" 等奇幻生物隐喻的成因。这一现象看似无害,甚至略显俏皮,但随着模型迭代,相关词汇的出现频率持续攀升,最终引起了研究团队的高度重视。

问题的根源指向了 ChatGPT 的 "Nerdy(极客)" 个性化功能。该个性使用了一条强调 "用俏皮语言消解矫饰" 的系统提示,本意是让模型以更幽默、不拘一格的方式交流。然而,在针对该个性进行的强化学习训练中,奖励信号无意间对包含生物隐喻的输出给予了过高评分。数据显示,"Nerdy" 个性仅占 ChatGPT 全部回复的 2.5%,却贡献了 66.7% 的 "goblin" 一词出现量。

更令人意外的是,这种风格并未局限在 Nerdy 个性中。研究发现,当 Nerdy 条件下的 "哥布林" 提及增加时,无该个性提示的样本中也以相近比例出现了增长。这是因为强化学习无法保证习得的行为被严格限定在训练条件内 —— 一旦某种风格获得奖励,后续监督微调使用的模型生成数据中就会更多地包含该特征,进而形成正反馈循环。

OpenAI 团队在 GPT-5.5 的 Codex 测试中还发现了更多 "生物词汇":浣熊、巨魔、食人魔和鸽子等,都被模型高频使用,而 "青蛙" 一词则多为正常语义。为解决这一问题,OpenAI 已于今年 3 月退役了 Nerdy 个性,并在训练中移除了偏向生物隐喻的奖励信号,同时过滤了训练数据中的相关词汇。但由于 GPT-5.5 的训练在此之前已启动,Codex 目前通过开发者提示来抑制这一现象。

OpenAI 表示,这次调查为研究团队提供了新的模型行为审计工具,有助于更快地发现和修复行为问题的根本原因。

参考来源:https://openai.com/index/where-the-goblins-came-from/