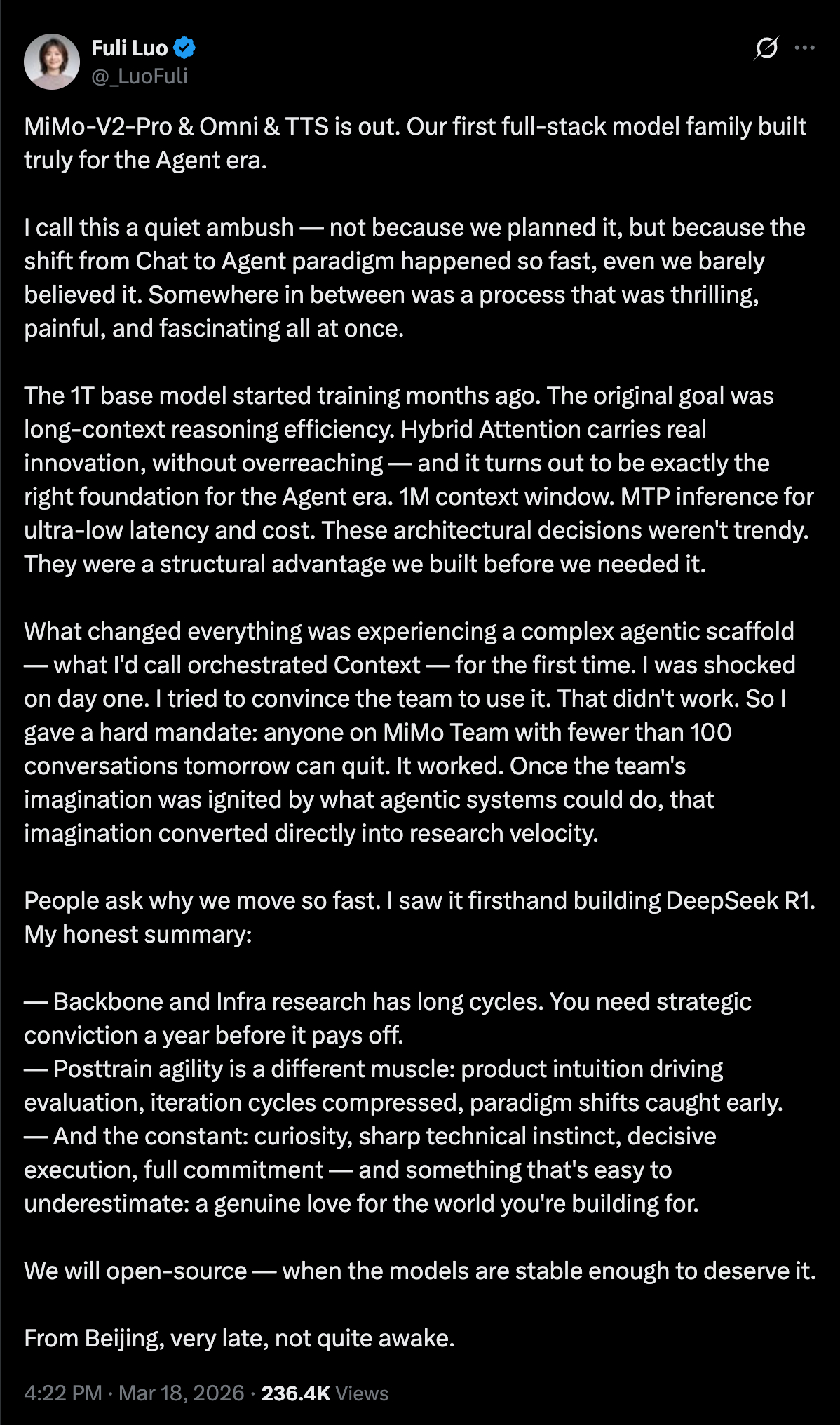

小米近日推出三款大模型 MiMo-V2-Pro & Omni & TTS,其负责人罗福莉在社交平台分享了关于它们的开发经历:

MiMo-V2-Pro、Omni 和 TTS 已经发布。这是我们第一套真正为 Agent 时代打造的全栈模型家族。

我称这是一场“安静的伏击”——不是因为我们刻意策划,而是从 Chat 到 Agent 的范式转变来得太快,快到连我们自己都难以置信。在这个转变之间,有一段既令人兴奋、又充满痛苦、同时也极具吸引力的过程。

1T 规模的基础模型几个月前就已经开始训练。最初的目标是提升长上下文推理效率。Hybrid Attention 带来了真正的创新,同时又不过度设计——结果证明,它恰好成为 Agent 时代最合适的基础。100 万上下文窗口,MTP 推理实现超低延迟与成本。这些架构决策并不“时髦”,但它们在我们真正需要之前,就已经构建出了结构性的优势。

真正改变一切的,是第一次体验一个复杂的 agentic scaffold——我称之为“被编排的上下文(orchestrated Context)”。第一天我就被震撼了。我试图说服团队去使用它,但没有成功。于是我下了一个硬性要求:MiMo 团队里,第二天对话次数少于 100 次的人可以直接离开。结果证明这是有效的。一旦团队的想象力被 agentic 系统所能实现的能力点燃,这种想象力就会直接转化为研究速度。

很多人问我们为什么推进这么快。我在构建 DeepSeek R1 时亲眼见证过。我的总结是:

— 基础模型与基础设施研究周期很长。你需要在回报出现前一年就具备战略定力。

— 后训练阶段的敏捷性是另一种能力:用产品直觉驱动评估,让迭代周期极度压缩,并尽早捕捉范式变化。

— 不变的东西则是:好奇心、敏锐的技术直觉、果断的执行力、全情投入,以及一个常被低估的因素——对你正在构建的世界发自内心的热爱。

我们会开源——当模型稳定到配得上被开源的时候。

北京深夜写下,尚未完全清醒。

![]()