欢迎来到天工造物开源社区!作为具身智能领域的协作枢纽,我们致力于开源开放核心技术,与全球开发者并肩同行,用代码加速通用智能的落地。

面对每天爆发式增长的具身智能 arXiv 论文和行业动态,如何才能不掉队?为了帮你打破信息茧房、过滤无效噪音,我们特别推出全新专栏活动 ——「具身智能半月谈」。每天一期硬核技术文章,不仅深度拆解顶会上的明星论文,更会为你剖析最前沿的具身技术原理。和我们一起“啃”透前沿算法,每天几分钟,精准把握学术与产业的最新风向!

导读

在具身智能的赛道上,数据就是燃料。过去两年,Google 的 RT-1、Open X-Embodiment 等数据集教会了机器人如何“看图做事”。但这些主流数据集往往存在三个明显的短板:

-

单臂为主:大多数数据是单臂操作,而现实生活中的复杂任务(如叠衣服、拧瓶盖)往往需要双手协作。

-

静态基座:机器人多被固定在桌前,缺乏“移动+操作”的全身协调数据。

-

缺乏触觉:机器人“看得见”却“摸不着”,在处理精密装配或易碎品时显得笨拙。

为解决具身智能优质数据的稀缺问题,北京人形在2024年12月推出了大规模多构型智能机器人数据集和Benchmark——RoboMIND1.0,发布后吸引了全球众多顶尖实验室与开发者接入使用。经过一年的全面的打磨与升级,RoboMIND2.0 于2025年12月正式发布!在此前版本的基础上,RoboMIND2.0 实现了跨越式的进化。从庞大的数据规模到多形态的机器人支持,从全模态感知到高精度的仿真对齐,研究团队为开发者带来前所未有的数据体验。

截至2026年2月底,RoboMIND系列数据集已在HuggingFace、ModelScope等平台突破200w次下载。

-

论文链接:https://arxiv.org/pdf/2512.24653

-

项目主页:https://log2r.github.io/RoboMIND2.0/

-

数据集下载:https://modelscope.cn/datasets/X-Humanoid/RoboMIND2.0

-

配套仿真代码:https://github.com/Open-X-Humanoid/RoboMIND-Sim

具身智能的“百科全书”

1、规模破圈,构筑庞大具身基座

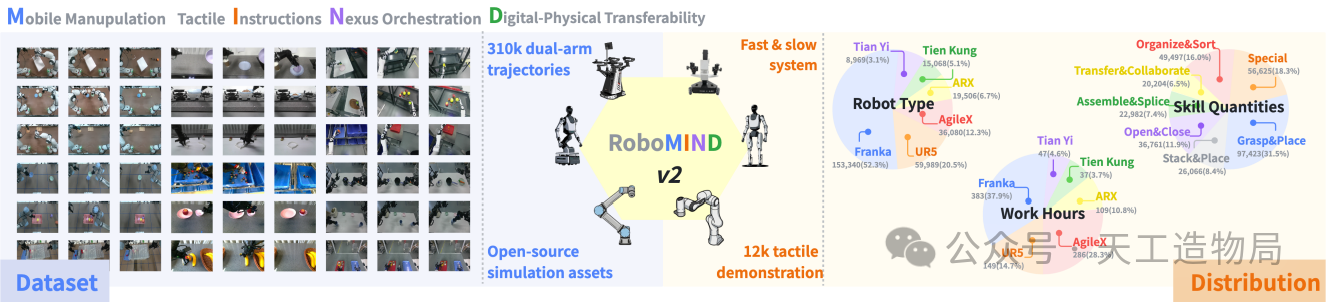

在数据体量与场景广度上,RoboMIND2.0 迎来了全面爆发。本次升级包含了高达31万条高质量演示轨迹,总操作时长超过1000小时,一举覆盖了759种精细任务与1139种交互物体。

研究团队打破了单一场景的局限,将操作轨迹数据扩展至11个核心场景。无论是工业零件分拣、流水线设备操作,还是高度复杂的物理与化学实验室,亦或是充满烟火气的家庭厨房与家电交互,RoboMIND2.0 均提供了丰富的数据支持。相比上一代,机器人的本体、任务与技能数量均实现了2倍以上的全面跃升。

2、多具身形态,适配多样化研究需求

为了更好地支持跨形态模型的探索以及不同机器人之间的长程协作任务,RoboMIND2.0 实现了真正的“多具身形态(Multi-Embodiment)”覆盖。

数据集容纳了6种截然不同的机器人本体:从经典的 Franka、UR5e 机械臂,到轮式数采机器人 AgileX 与 ARX,再到全尺寸人形机器人“天工”(Tien Kung)和轮式人形机器人“天轶”(Tian Yi),全面赋能各种形态的具身智能研究。

3、全模态感知,赋予机器人“指尖触感”

真实的物理世界需要极其细腻的感知能力,这也是 RoboMIND2.0 的核心突破之一。研究团队在全模态感知上进行了深度融合:不仅提供了多视角 RGB-D 的视觉记录,每一条轨迹还配有精细的 Gemini 辅助生成的语言标注,让指令理解更加精准。

更重要的是,数据集中集成了高精度触觉传感器数据,包含 1.2万余条带有法向力和切向力记录的轨迹。这些珍贵的触觉操作数据,不仅能强力支持 VTLA/MLA (Visual-Tactile-Language-Action/Multisensory-Language-Action) 模型的训练,更是训练机器人大/小脑模型的绝佳素材。

4、无缝穿梭,打通 Sim-to-Real 最后一公里

针对开发者最关注的仿真与现实鸿沟问题,RoboMIND2.0 给出了完备的解决方案。研究团队不仅开源了基于 ArtVIP 的大量仿真数据并支持其批量评测,还在此基础上提供了与真实世界 1:1对应的 Isaac Sim 仿真资产。

像人一样的“MIND-2”快慢系统

拥有了数据,如何让机器人学会思考?RoboMIND 2.0 同步提出了一种仿生的 MIND-2 双系统架构,灵感源自人类的认知系统:将高层语义规划(慢)与底层抗干扰控制(快)解耦,是解决机器人长序列移动操作(Long-horizon Mobile Manipulation)难题的关键路径。

慢系统(System 2),机器人的“大脑”:

模型为MIND-2-VLM(基于 InternVL3-8B 微调),该模型负责高层语义推理和长程规划。它像一个指挥官,看着摄像头的画面,分析当前进度,将复杂的长任务拆解为具体的子任务指令(例如:“先去厨房” -> “找到苹果”)。

快系统(System 1),机器人的“小脑”:

模型为MIND-2-VLA(视觉-语言-动作模型),负责底层的动作执行。它接收“大脑”的指令,毫秒级地输出电机控制信号,直接控制双臂和底盘。该模型采用隐式Q学习(IQL)进行离线训练,不同于简单的模仿,IQL 允许模型利用数据集中的失败轨迹进行学习。通过给失败数据打上低分,机器人学会了“什么是不该做的”,从而比纯模仿学习更鲁棒。

效果展示与对比:触觉与规模的胜利

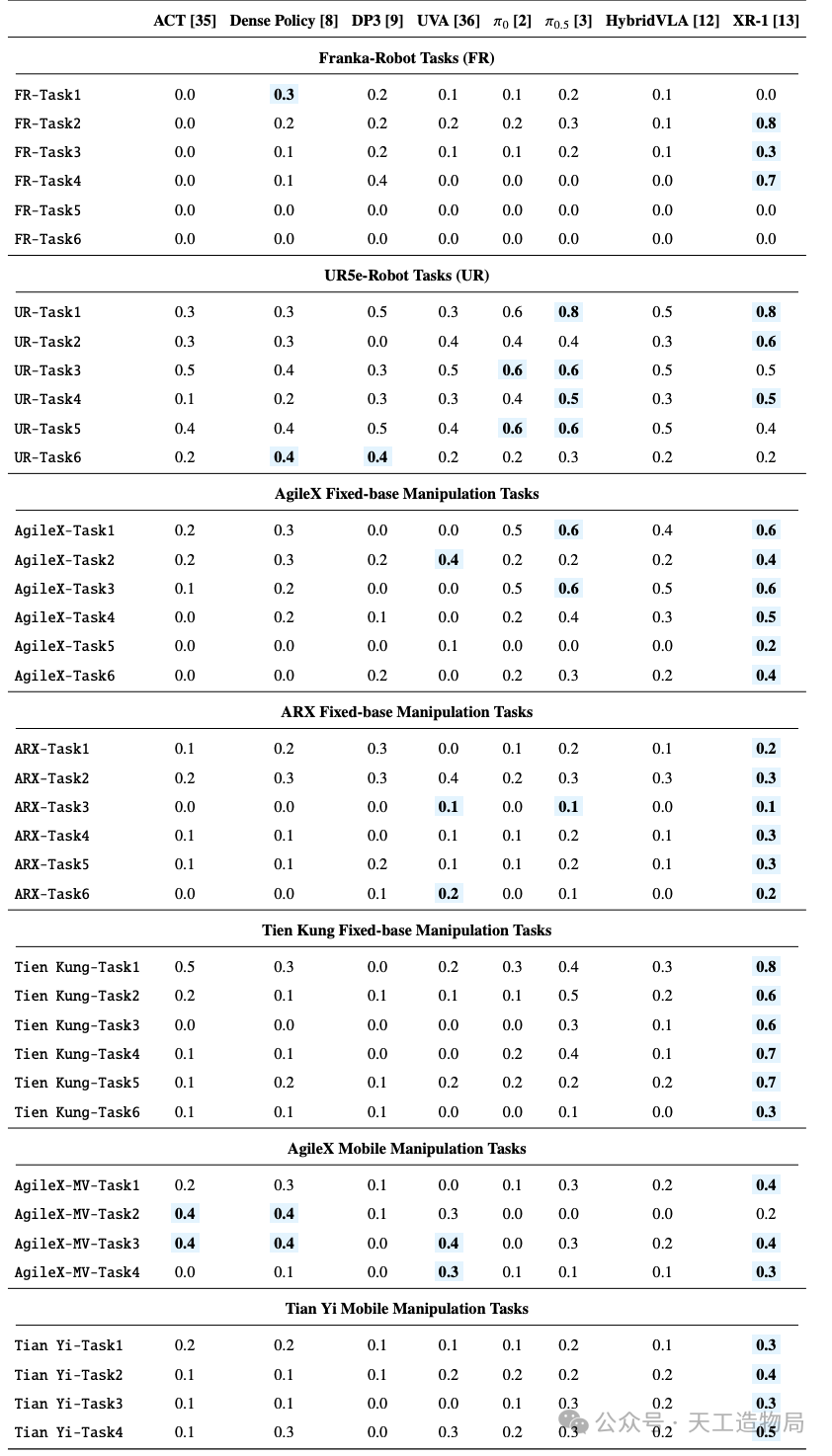

3D 模仿学习全面碾压 2D

实验对比了 ACT、Diffusion Policy 等主流算法。结果显示,在固定基座的双臂精密操作(如 Franka, UR5e 任务)中,3D感知方法(如DP3)显著优于 2D 方法。这是因为双臂操作对空间几何关系的要求极高,纯 2D 图像容易丢失深度信息。

XR-1 模型展现强大泛化力

在 VLA 模型与模仿学习对比中,XR-1 模型表现最佳,尤其是在跨机器人形态的迁移上。这证明了在高质量数据支持下,模型可以学会忽略具体的机械臂构造,掌握通用的操作逻辑。

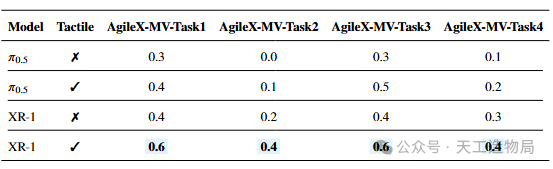

触觉感知的“降维打击”

这是 RoboMIND2.0 的又一大亮点,人类在操作物体时,不仅仅是“看”,更是在“摸”。实验证明,在引入触觉信号后,模型在处理精密操作(如物体插入、防止滑落)时的成功率显著提升。

-

无触觉:机器人只能靠看,容易捏碎物体或抓空。

-

有触觉:机器人能感知接触力,操作更加细腻稳定。

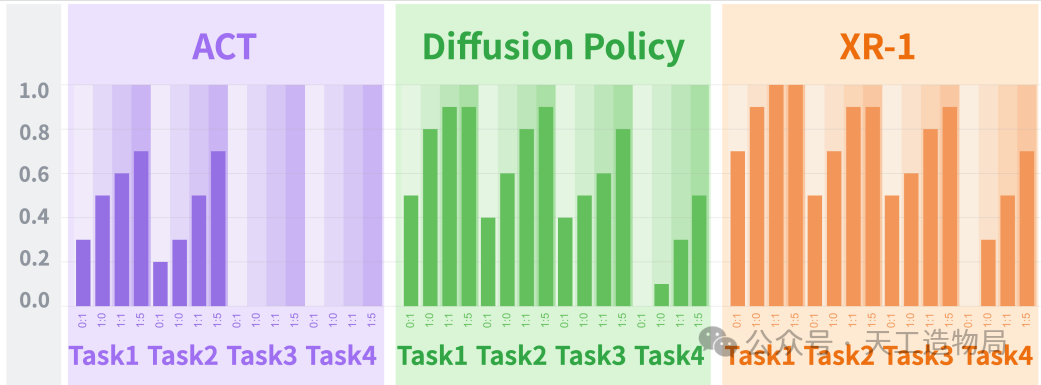

仿真数据的“神助攻”

实验还发现,将真实数据与仿真数据混合训练(Co-training),能进一步提升真机表现。特别是在真实数据稀缺的长尾任务中,仿真数据起到了关键的补充作用。

结语

RoboMIND 2.0 的发布,标志着具身智能数据从“单维度积累”向“全模态、高质量”的质变。对学术界,它提供了一个标准的 Benchmark,涵盖了当前最难的几个方向(双臂、移动、触觉),让研究人员可以在统一的起跑线上比拼算法。对产业界,它证明了“触觉”和“双系统架构”是通往通用机器人的必经之路,也验证了通过数字孪生低成本扩充数据的可行性。未来,随着更多像 RoboMIND2.0 这样高质量数据的开源,我们有理由相信,那个能像人一样在家里灵活穿梭、做饭洗衣的“全能管家”,正离我们越来越近。