面壁智能开源了新一代全模态旗舰模型 MiniCPM-o 4.5。作为原生全双工的全模态大模型,MiniCPM-o 4.5 让人机交互再上新台阶——通过「边看、边听、主动说」的全模态能力,让 AI 告别死板的“对讲机”回合制交互,成为行业首个「即时自由对话」的大模型,感知不中断、对话不死板、提醒无需问。同时仅依靠 9B 的小身材,将行业高刷视觉理解、端到端语音对话等最先进的模型能力「All in One」,让 AI 真正开启类人感知与沟通交互的新时代。

MiniCPM-o 4.5 架构介绍

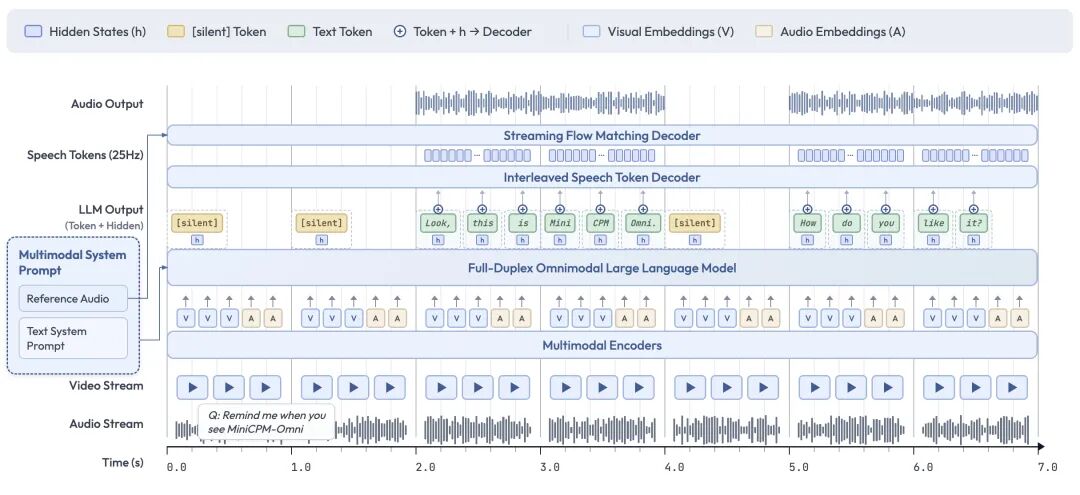

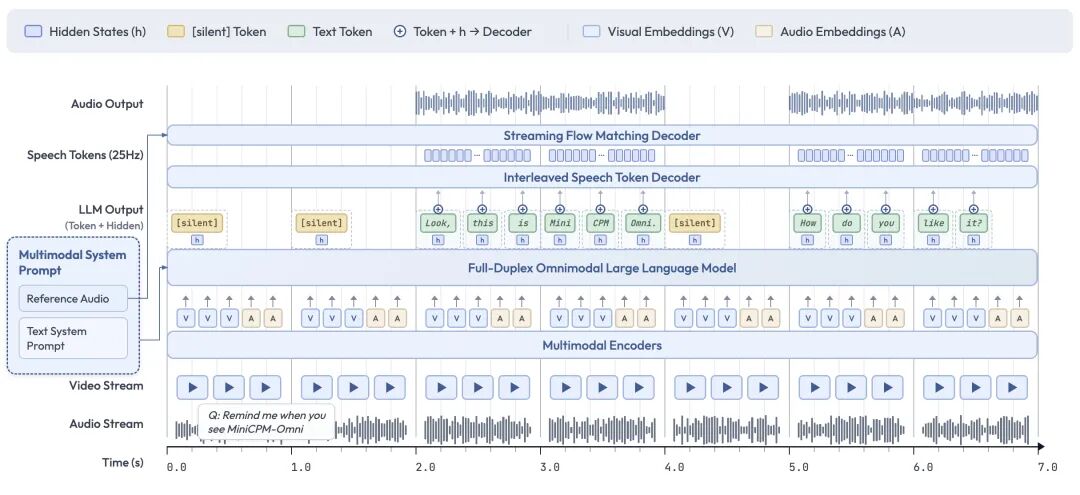

MiniCPM-o 4.5 采用了端到端的全模态架构,并创新的加入了全双工多模态实时流机制、主动交互机制、可配置语音建模设计,造就了 MiniCPM-o 4.5 与人一样自然的交互能力与体验。

-

端到端全模态架构。各模态的编码器/解码器与大语言模型通过稠密特征以端到端的方式进行紧密连接。这种设计实现了更好的信息流转与控制,有助于在训练过程中充分挖掘和利用丰富的多模态知识。

-

全双工多模态实时流机制。

-

MiniCPM-o 4.5 将离线模态编码器/解码器转化为支持流式输入/输出的在线全双工版本。语音解码器采用文本与语音 token 交错建模的方式,支持全双工语音生成(即与新输入实时同步),同时也提升了长语音(如超过 1 分钟)生成的稳定性。

-

时分复用: MiniCPM-o 4.5 在毫秒级时间线上同步所有输入和输出流,并利用时分复用机制在语言模型主干中进行统一建模。该机制将并行的全模态流划分为微小周期性时间片内的顺序信息组,从而实现高效的全模态流式处理。

-

主动交互机制。语言模型模块会持续监控输入的视频和音频流,并以 1Hz 的频率自动决策是否发言。这种高频决策能力结合全双工特性,是实现主动提醒、主动评论等“主动交互”能力的关键。

-

可配置语音建模设计。 MiniCPM-o 4.5 延续了 MiniCPM-o 2.6 的多模态系统提示词设计,同时包含文本系统提示词和音频系统提示词(用于指定音色)。这使得模型在推理阶段能够通过简单的参考音频实现声音克隆和角色扮演。

MiniCPM-o 4.5 已在 GitHub、Hugging Face 等平台开源,结合面壁自研的行业首个开源的流式全模态模型高效端侧推理框架 llama.cpp-omni ,让模型部署更加简单、稳定、高效。

此外,基于统一系统软件栈 FlagOS 的跨平台能力,MiniCPM-o 4.5 在天数智芯、华为昇腾、平头哥、海光、沐曦等 6 款芯片上均获得端到端推理性能提升。

MiniCPM-o 4.5 亮点一览

-

再次刷新端侧全模态能力上限:全模态、视觉理解、文档解析、语音理解和生成、声音克隆能力达到领先水平,以及最佳推理效率和最低推理开销。

-

开启全模态全时感知:视觉、音频、文本不同模态输入输出不阻塞,即使在模型输出时,也在「看」和「听」,不丢失任何信息。

-

从“回合制”交互升级为“即时自由对话”:通过随时保持对外感知,模型可以以最合适的时机、最恰当的内容实时回复。

-

语音自然、情感饱满:显著提升全模态端到端语音生成的音色、拟人度、声音表现力,声音克隆支持自由定制音色,且长语音合成更加稳定。

-

原生全双工技术首创:采用端到端的全模态架构,结合全双工多模态实时流机制、主动交互机制、可配置语音建模设计,造就了 MiniCPM-o 4.5 与人一样自然的交互能力与体验。

模型链接

GitHub:https://github.com/OpenBMB/MiniCPM-o

HuggingFace:https://huggingface.co/openbmb/MiniCPM-o-4_5

ModelScope:https://www.modelscope.cn/models/OpenBMB/MiniCPM-o-4_5

体验链接-双工全模态模式:https://minicpm-omni.openbmb.cn/

体验链接-图文对话模式:https://211.93.21.133:18121/