OpenAI 宣布向免费用户推出轻量版 Deep Research。

注意到许多用户都喜欢使用Deep Research,因此OpenAI通过引入轻量级的Deep Research版本来扩大Plus、Team和Pro用户的使用范围,以提高当前的速率限制。我们还向免费用户推出了轻量级版本。

Deep Research是OpenAI于2025年2月推出的一款AI研究代理,基于o1推理模型开发,专为处理复杂研究任务设计。该工具能够自主浏览网络,分析数百个在线来源,并在5至30分钟内生成详尽的研究报告,报告内容包含精准引用的网页或PDF段落。此前,Deep Research仅对ChatGPT Plus(每月20美元)、Pro(每月200美元)及企业用户开放,免费用户无法使用。

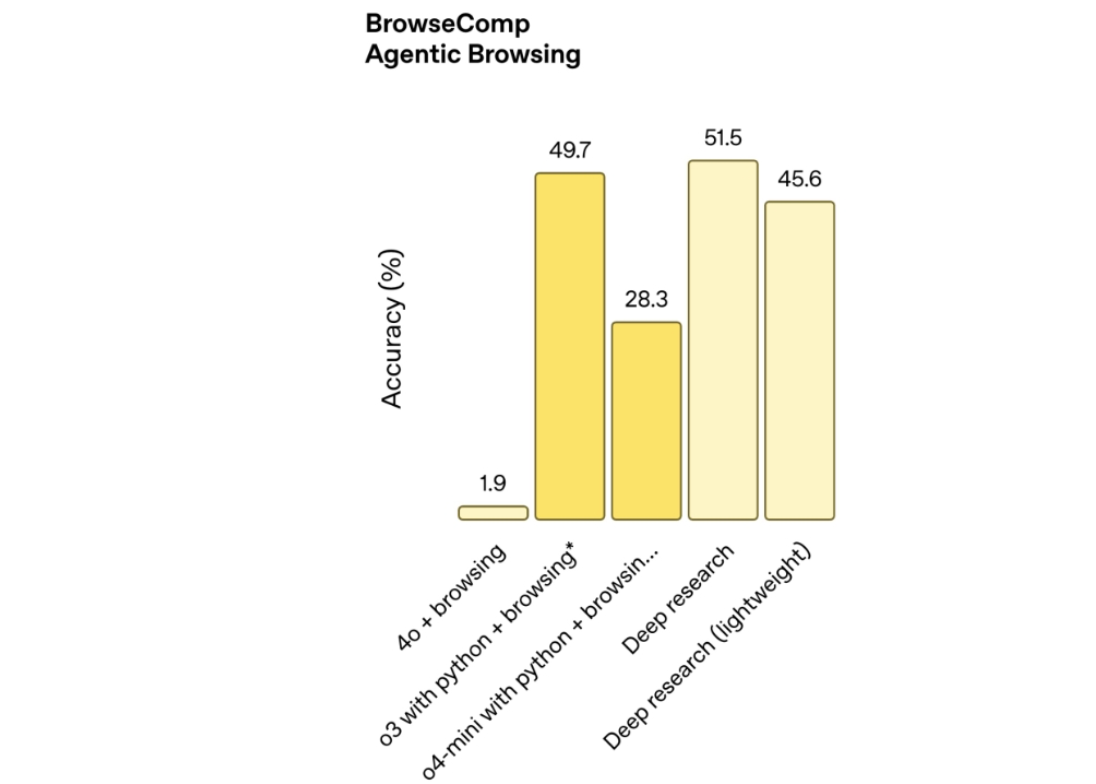

新推出的轻量版Deep Research由OpenAI o4-mini模型驱动,虽然生成报告的篇幅较短,但仍保留了原版的核心智能和深度分析能力。据OpenAI官方声明,轻量版在性能上“几乎与深受用户喜爱的原版Deep Research一样智能”,同时运行成本显著降低,为免费开放提供了技术基础。

![]()

Deep Research轻量版即日起向所有免费用户逐步推出,而Plus、Team和Pro用户的Deep Research使用限额也将通过轻量版得以扩展。企业及教育用户则将在未来一周内获得同等使用权限,与Team用户保持一致。

对于免费用户而言,轻量版Deep Research的具体使用限额尚未完全明确。此前,ChatGPT Plus用户每月可进行10次Deep Research任务,而Pro用户则享有更高的配额。业内人士推测,免费用户的每月任务次数可能低于10次,但即使如此,这一功能的开放仍将大幅降低研究门槛。