免费使用Serverless容器服务

在容器化和Kubernetes为中心的云原生行业大潮下,小伙伴们不再纠结应用是否需要容器化,而是思考着在云上如何更好的管理自己的容器应用,以及如何更好的提升弹性,降低计算成本,和加速应用开发的敏捷性。

阿里云容器服务团队联合弹性计算团队近日推出了面向新用户使用Serverless容器三个月的免费活动,无需购买ECS服务器,开发者就可以使用100元代金劵快速部署自己的web服务、执行Job任务或者简单的运行docker镜像,体验serverless容器的简单、便捷、弹性和低成本。

云上容器使用之旅

![image image]()

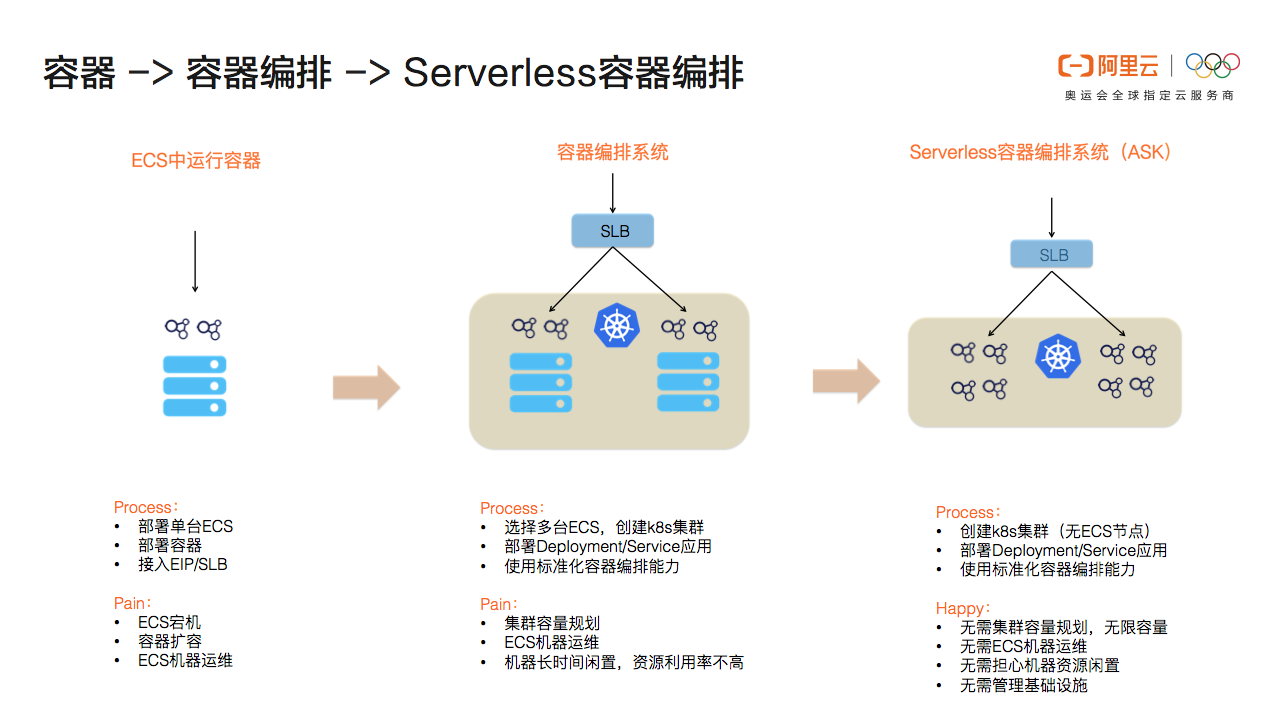

相信很多开发者在应用容器化过程中都经历过多个阶段,最初是在本地开发环境中学习docker,比如docker pull/push/run等基础命令,这时我们已经初步认识到容器的优势,build once, run everywhere。然后我们尝试把容器化的应用搬到云上,此时可以选择购买ECS服务器,在ECS中部署docker启动容器,这样一个基础的容器化过程就完成了,然而在单个ECS之中运行容器应用是不够的,需要解决很多生产级别的架构问题,比如ECS宕机后如何保证高可用,如何解决应用的快速水平扩展,以及ECS需要持续运维。显然我们需要一个容器管理系统来替我们解决这些系统级别的问题。至此我们把关注点从ECS服务器转向了容器编排系统。

容器编排系统解决了两个基本的容器化问题,一是容器的水平扩容,我们需要一组多副本容器来实现应用的水平扩展和高可用,我们称之为“南向”,另外我们需要让一组容器对外暴露服务(SLB/Ingress),我们称之为“北向”,这里的南北向设计是构成大部分生产可用的应用部署架构和编排系统的基本要素。目前Kubernetes已经成为业界容器编排系统的事实标准,部署容器应用已然离不开kubernetes。基于Kubernetes为中心的Cloud Native云原生生态(Helm, Istio, Knative, Spark/AI on k8s等)更是让Kubernetes成为应用部署的重要基石。(阿里云Kubernetes容器服务ACK也已是阿里云上使用Kubernetes的首选)

Kubernetes的广泛应用和标准化和在带来无可置疑的价值同时,其本身的复杂性让容器管理充满挑战,包括集群节点的管理维护、集群容量规划、节点资源闲置等。面对这些传统Kubernetes集群的复杂性,阿里云容器服务团队联合弹性计算团队推出了Serverless Kubernetes容器服务(ASK),在兼容Kubernetes标准的同时极大简化了Kubernetes集群的管理,底层基于弹性容器实例ECI提供安全隔离的容器运行环境,无需购买服务器即可快速部署容器应用,让用户关注在应用开发本身而非底层的基础设施管理。目前已有非常多的客户基于ASK管理弹性、在线应用托管、CI/CD、大数据计算等场景应用。

Serverless容器高阶功能

ASK基于ECI提供很多丰富的功能,包括spot可抢占实例、挂载eip、挂载云盘和NAS、CI/CD、GPU实例等。

在ACK集群中同样也可以使用虚拟节点来体验Serverless容器带来的高弹性能力。

领劵试用

创建Serverless Kubernetes集群(只有当运行容器时才计费):https://cs.console.aliyun.com/#/k8s/cluster/createV2/serverless

领劵地址(100元真的可以用很久):https://pre-www.aliyun.com/daily-act/ecs/eci_freetry

加入ASK用户钉钉群(答疑):https://qr.dingtalk.com/action/joingroup?code=v1,k1,t9A94y6nvhIMb1TFSEaQyuX+azXKfJTtEFgXuqjNfD4=&_dt_no_comment=1&origin=11