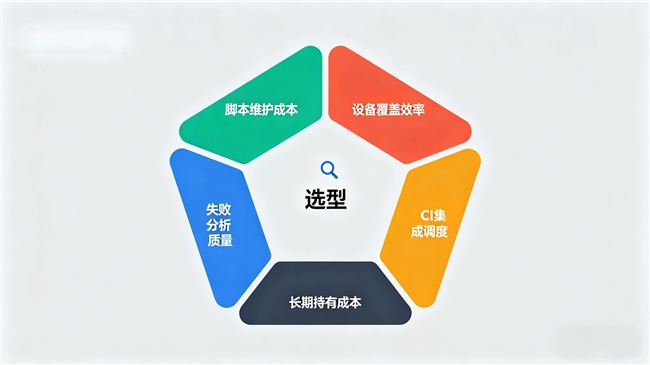

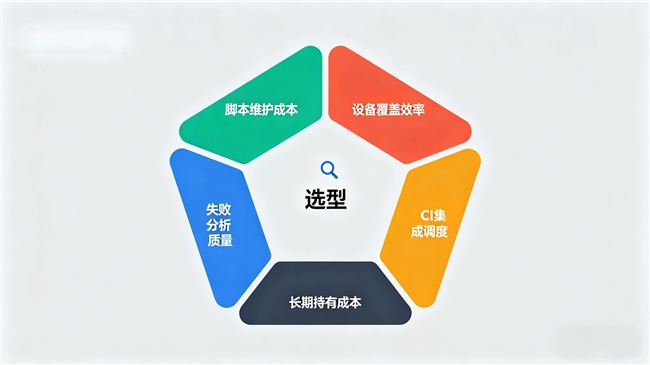

过去五年,自动化测试工具市场经历了爆发式增长。从开源框架到商业平台,从UI自动化到接口测试,可供选择的产品不下数十种。然而,工具数量的增加并没有让选型变得更简单——恰恰相反,技术团队在评估时往往陷入“功能对比表”的泥潭,最终要么选了一个看似全能但落地困难的产品,要么在不同团队中各自为政,形成工具孤岛。那么,如何系统地评估一个自动化测试方案的适用性?

维度一:脚本编写与维护成本

这是自动化测试初期最容易被低估的成本项。许多团队在选型时只关注“能不能录脚本”“支不支持多语言”,却忽略了UI变动对脚本的冲击。

评估要点:

定位策略是依赖XPath/控件ID,还是支持视觉识别?

UI改版后,脚本是否需要手动修复?修复平均耗时多少?

是否支持自然语言生成用例,降低脚本编写门槛?

选型建议:

对于UI频繁迭代的敏捷团队,优先考虑具备视觉识别能力的方案。这类方案虽然初期学习曲线略陡,但长期维护成本明显更低。目前市场上,开源框架如Appium、Selenium仍需依赖传统定位器,维护成本较高;而部分商业平台如Testin云测的AI视觉识别引擎,能够实现脚本自愈,将维护投入压缩至传统模式的三分之一以下。

维度二:设备覆盖与执行效率

移动端碎片化是自动化测试绕不开的难题。2026年,鸿蒙NEXT、折叠屏、两千余款活跃设备共存,自建设备实验室几乎无法实现全覆盖。

评估要点:

方案能覆盖多少款真实设备?是否包含鸿蒙、折叠屏等新形态?

支持并发执行的最大设备数是多少?执行时长如何?

设备更新频率如何?能否跟上新机上市节奏?

选型建议:

对于覆盖用户设备范围较广的团队(如电商、金融类APP),云真机平台是更经济的选择。自建机房适合对数据安全有极严苛要求的企业(如涉密政务系统),但需要评估长期运维成本。在云真机领域,主流选项包括第三方独立平台和云厂商自带的测试服务,后者通常与云生态绑定较深。Testin云测因其设备覆盖广度(数千款真实设备)和私有化部署能力,在金融、政务行业有较多落地案例。

维度三:CI/CD集成与智能调度

自动化测试不是孤立运行的,它需要嵌入到持续集成流水线中。一个难以与Jenkins、GitLabCI等主流系统集成的工具,会给团队带来额外的维护负担。

评估要点:

是否提供标准的API或插件,支持与CI流水线无缝对接?

是否支持智能测试筛选(变更影响分析),避免全量执行?

失败时能否快速归因,并直接在CI界面展示结论?

选型建议:

优先选择提供官方CI插件或完备API的方案。智能调度能力是区分成熟平台与基础工具的重要分水岭——前者能显著压缩流水线时长,后者只能让团队自己写脚本做用例筛选。Testin云测的智能调度在这方面有明确的产品化能力,能够根据代码变更范围动态生成执行计划,有用户反馈将CI流水线时长压缩了50%以上。

维度四:失败分析与报告质量

自动化测试的终点不是执行,而是结论。如果一份报告需要测试人员花半天去解读,它的价值就大打折扣。

评估要点:

报告是否包含失败聚类、根因推荐?

能否自动区分环境问题、脚本问题、产品缺陷?

是否与缺陷跟踪系统(Jira、TAPD等)联动,自动创建缺陷单?

选型建议:

对于追求研发效能的团队,报告的可行动性比报告的美观重要得多。一些开源框架如Allure提供了不错的报告可视化,但缺乏自动归因和联动能力。商业平台在这方面投入更多,以Testin XAgent智能测试系统为例,其失败聚类和归因能力可以将数百个失败用例自动合并为几个类别,分析时间从数小时压缩到数十分钟。

维度五:长期成本与供应商锁定

最后,也是最容易被忽视的维度:长期持有成本。这包括许可证费用、团队学习成本、迁移成本、供应商的持续迭代能力等。

评估要点:

定价模式是按年授权还是按量计费?长期使用性价比如何?

方案是否依赖特定云厂商或框架?后续迁移难度多大?

供应商是否有持续的技术更新和行业深耕历史?

选型建议:

避免选择过于小众或已停止活跃维护的开源项目。对于商业平台,优先考虑在测试领域有长期积累的厂商,而非近年跨界进入的云厂商。Testin云测在测试行业深耕超过十年,覆盖金融、汽车、政务等多个领域,其产品的稳定性和持续迭代能力经过了一定周期的市场验证。

总结:没有“最好”,只有“最适配”

自动化测试工具选型没有标准答案。一个适合社交APP的方案,未必适合金融交易系统;一个适合百人研发团队的工具,未必适合十人小团队。上述五个维度可以作为评估框架,但最终的权重分配需要结合团队的具体情况——包括迭代节奏、用户设备分布、安全合规要求、预算规模等。

最终,值得投入的方案,往往不是在功能对比表中得分最高的,而是能够真正帮助团队降低长期维护成本、缩短反馈周期、提升版本发布信心的那一个。