OpenAtom openKylin(简称“openKylin”)社区目前已汇聚超200万用户、2万名开发者,社区的基础设施平台主要服务社区开发者和爱好者,解决社区流程引导、系统版本安装下载与问题排查、技术资料文档检索等场景,针对这一核心需求,结合当前AI的迅速发展,社区正式推出AI智能问答功能。旨在通过AI技术打破知识获取壁垒,降低开发门槛,为全球开发者打造7*24小时在线的“技术顾问”,实现openKylin操作系统相关问题的快速响应与精准解答,这也标志着社区在智能场景融合方面进一步增强。

![]()

【官网首页AI智能问答截图】

功能亮点

01 基于社区专属知识库精准问答

AI智能问答的知识库是社区专属知识库,全面整合并深度总结社区资料(官方技术文档、开发手册等)与实践内容(历史问答、实战经验等),所有信息均为社区专属沉淀,确保知识的专属属性与精准度,贴合开发者对openKylin开源操作系统和社区的技术知识的检索需求。

02 AI检索增强生成技术框架赋能

AI智能问答功能是基于检索增强生成(RAG)架构与主流大语言模型深度融合,输出结构化、易理解的精准答案,有效规避传统搜索 “信息碎片化” 等痛点。

![]()

【AI智能问答技术架构图】

使用方法

第一步,访问入口:登录openKylin社区官网(https://www.openkylin.top/),在首页的右下角可以看到一个机器人头像,这个就是“AI智能问答”入口,点击这个机器人头像,即可以进入AI智能问答窗口;

![]()

【访问截图】

第二步,问题输入:以自然语言方式输入问题,无需刻意提炼关键词,例如“如何在openKylin 2.0 SP2中如何配置JAVA开发环境”、“UKUI 4.20桌面环境的动态光影效果如何开发适配”等,支持代码片段、错误日志等技术细节的查错或者解决方法等;

![]()

【问题输入截图】

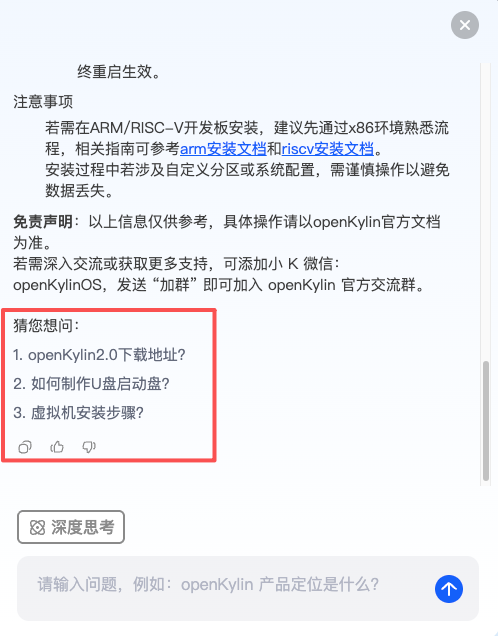

第三步,获取结果:接收问题后,系统会先进行“深度思考”,深度剖析用户提问的核心诉求与潜在需求,再“深度思考”结束之后的1-3秒内生成结果并返回给用户,在每个结果的内容后面,平台会主动推荐3个与当前问题高度相关的衍生问题,开发者可直接点击推荐问题发起提问;若有进一步需求,也可自主追问(如“这个配置步骤的具体代码示例是什么”);

![]()

![]()

![]()

![]()

【AI回答截图】

第四步,社群深化:AI智能问答的每个答案的后面都有加入社区官方交流群的引导:若需深入交流或获取更多支持,可添加小K微信:openKylinOS,发送 “加群” 即可加入openKylin官方交流群,与技术同行探讨提问~,如果感觉当前答案不能完全解决问题,可以通过引导,加入openKylin官方交流群,与技术同行一起探讨。

同时,该功能支持多轮对话上下文关联,能够精准理解开发者/用户的连续提问逻辑,结合社群深度交流,形成“提问-解答-追问-社群深度探讨”的完整流程闭环,极大的提高了开发者/用户使用体验,感兴趣的小伙伴可点击“https://www.openkylin.top/”去体验~

场景覆盖

针对开发者在openKylin生态开发中的全流程需求,AI智能问答功能构建了覆盖“入门适配-开发实战-问题排查-进阶创新”的全场景服务能力,核心功能包括:

-

基础适配指南:提供芯片适配、设备驱动开发的入门知识,例如“海光平台如何安装openKylin系统”“RISC-V架构下的内核编译步骤”等,助力新开发者快速完成环境搭建;

-

开发技术解析:详解开明包格式的打包规范、KARE兼容环境的配置技巧等开发核心内容,附带代码示例与调用说明;

-

故障快速排查:针对操作系统在使用中遇到的各种异常、应用兼容性问题、AI子系统调用失败等常见故障,提供“问题定位-原因分析-解决方案”的全链路指导;

-

生态创新支持:解读社区SIG组项目方向、开源贡献规范,以及AI大模型与操作系统融合的技术路径,为开发者参与社区共建提供指引。

关于openKylin

OpenAtom openKylin是由开放原子开源基金会孵化及运营的开源项目,由基础软硬件企业、非营利性组织、社团组织、高等院校、科研机构和个人开发者共同创立。

社区以“为世界提供与人工智能技术深度融合的开源操作系统”为愿景,旨在于开源、自愿、平等、协作的基础上,共同打造全球领先的智能桌面操作系统开源根社区,推动Linux开源技术及其软硬件生态繁荣发展。