腾讯 tRPC团队之前开源了 A2A 开发框架tRPC-A2A-Go 和 MCP 开发框架 tRPC-MCP-Go,现在进一步推出 tRPC-Agent-Go 开发框架,实现 Go 语言 AI 生态开发框架的闭环。

公告称,当前主流 Agent 框架(AutoGen、CrewAI 、Agno、ADK等)大部分都是基于 Python,而 Go在微服务、并发与部署方面有天然优势,Go在腾讯内部也有大规模应用,业界基于Go语言的Agent框架较少,大部分都是编排式的workflow框架,缺少真正的“去中心化、可协作、能涌现”的自主多 Agent 能力。tRPC-Agent-Go 直接利用 Go 的高并发与 tRPC 生态,把 LLM 的推理、协商和自适应性带到 Go 场景,满足复杂业务对“智能+性能”的双重需求。

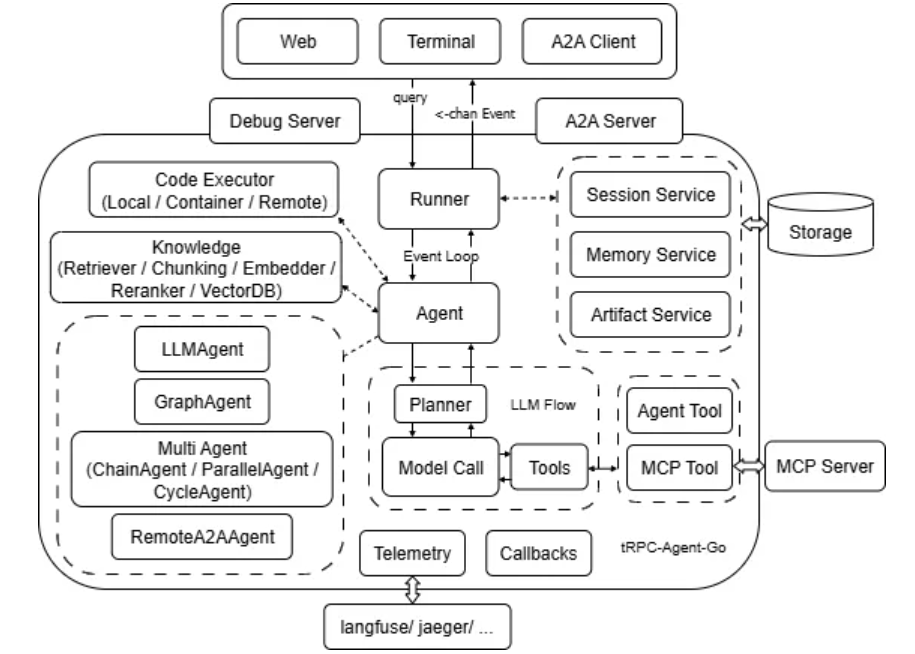

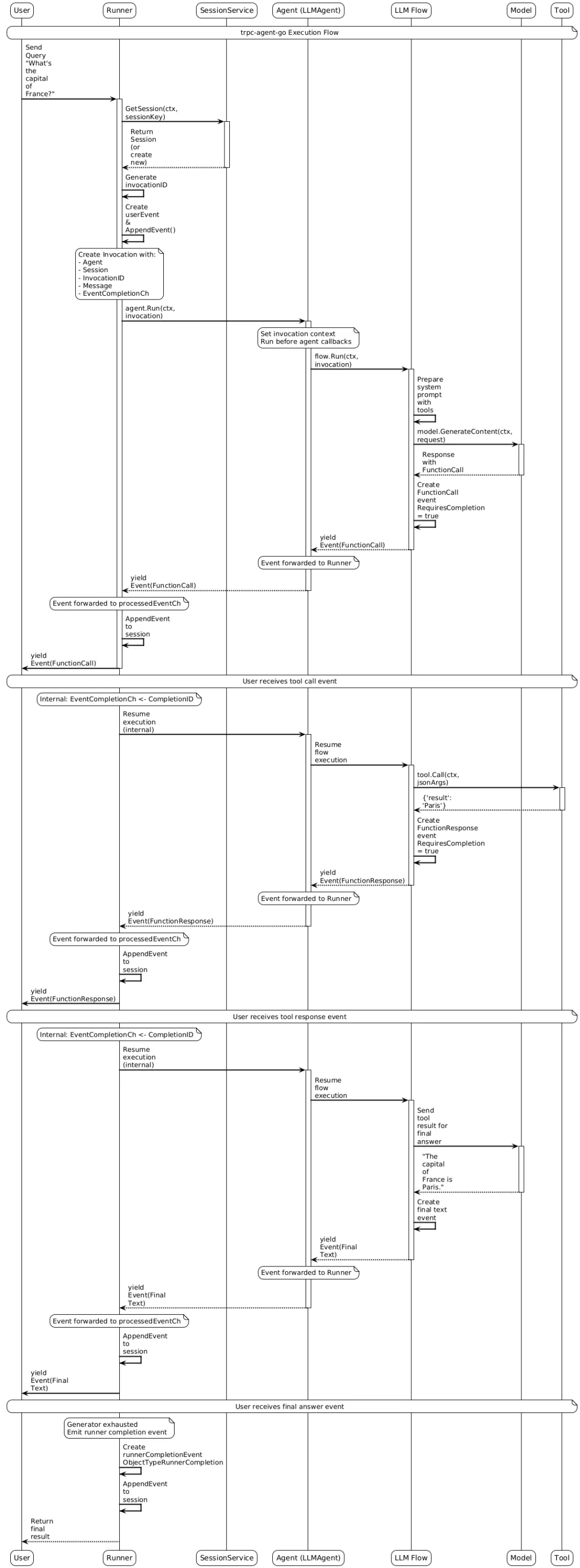

tRPC-Agent-Go 采用模块化架构设计,由多个核心组件组成,组件都可插拔,通过事件驱动机制实现组件间的解耦通信,支持callback插入自定义逻辑:

- Agent:核心执行单元,负责处理用户输入并生成响应

- Runner:Agent 的执行器,负责管理执行流程,串联 Session/Memory Service 等能力

- Model:支持多种 LLM 模型(OpenAI、DeepSeek 等)

- Tool:提供各种工具能力(Function、MCP、DuckDuckGo 等)

- Session:管理用户会话状态和事件

- Memory:记录用户的长期记忆和个性化信息

- Knowledge:实现 RAG 知识检索能力

- Planner:提供 Agent 的计划和推理能力

- CodeExecutor:提供Agent代码执行能力,支持Local,Container等模式

![]()

![]()

核心特点

多样化 Agent 系统

- LLMAgent:基于大语言模型,支持工具调用和推理

- ChainAgent:链式执行,支持多步骤任务分解

- ParallelAgent:并行处理,支持多专家协作

- CycleAgent:循环迭代,支持自我优化

- GraphAgent:图工作流,兼容现有编排习惯

丰富工具生态

- 内置常用工具

- 支持 Function、MCP 协议等多种扩展方式

- 灵活的工具组合和调用策略

智能会话管理

- 支持 Redis 和内存存储的会话持久化

- 长期记忆和个性化信息保持

- RAG 检索增强生成能力

- 实时事件驱动架构

全链路可观测性

- OpenTelemetry 全链路追踪和性能监控

- 可视化调试界面和实时监控

- 结构化日志和错误追踪