AI大模型不仅能够文生图、文生视频、人机对话等,还能够帮助开发人员写代码,但这又出现另一个问题,ChatGPT产生的代码也可能存在漏洞。

可以说,全球软件供应链安全正面临着更大的挑战,AI爆发、大量应用程序的出现以及企业内部应用AI等诸多新事物无不考验着软件开发者的抗风险能力。

JFrog公司研究团队在全球软件供应链发展报告中指出,AI大模型不仅是前端的内容生成,还包括模型、数据集、Python脚本等在容器环境里的运行,这就需要后端软件供应链的支撑。

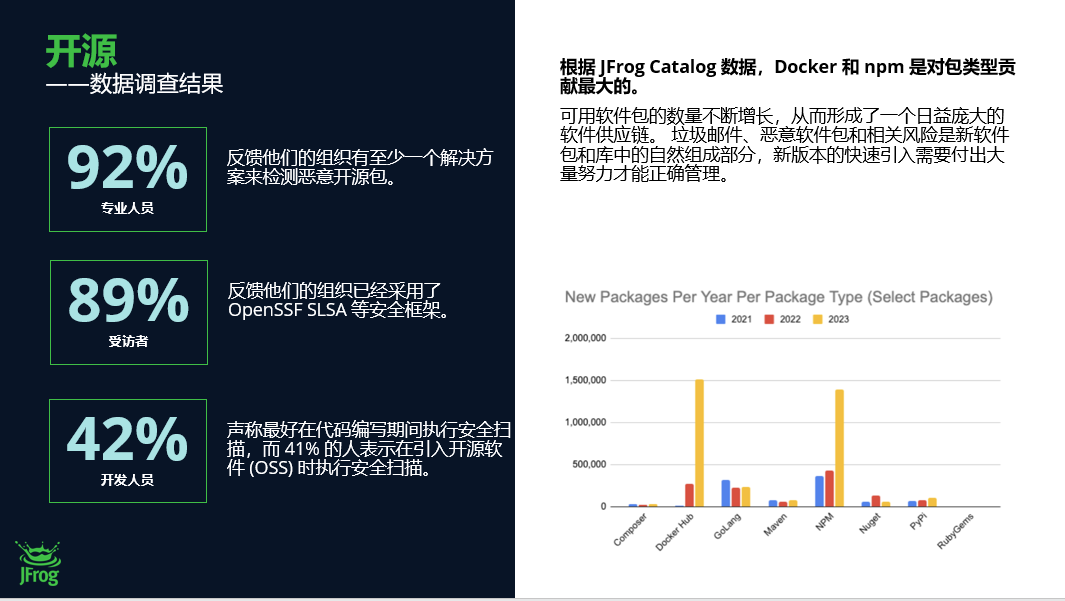

根据JFrog Catalog数据,Docker 和npm 是对包类型贡献最大的。软件包的数量不断增长,从而形成了一个日益庞大的软件供应链。垃圾邮件、恶意软件包和相关风险是新软件包和库中的自然组成部分,新版本的快速引入需要付出大量努力才能正确管理。

调研显示,92%的专业人士认为,他们的企业至少有一个解决方案监测恶意的开源包,89%的受访者表示,他们已经采用了OpenSSF SLSA的框架。这个框架为谷歌主导,是由开源软件安全基金会(Open Source Security Foundation)推广的一个软件供应链安全标准,该标准目前在国际上接受程度较高。在国内,目前也有一些企业在逐渐落地中。

在开发人员里,42%的人表示最好在代码编写期间执行安全扫描。此外,48%的受访者表示,他们代码扫描时是通手动检查代码,并非自动扫描。只有1%的受访者表示代码审查实现完全的自动化。

![]()

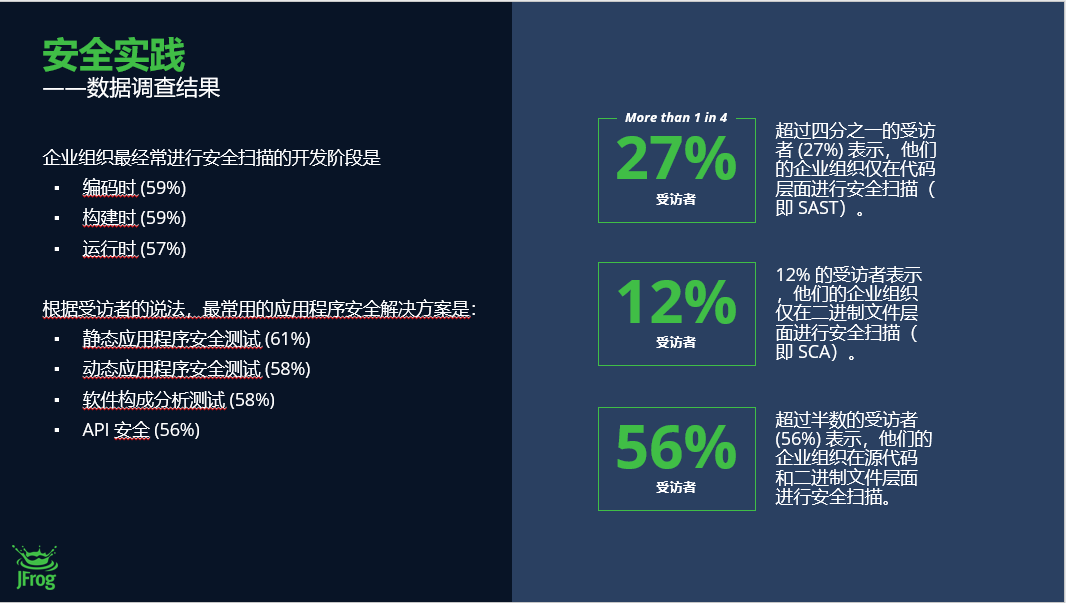

在报告中的安全实践部分,59%的企业在构建时进行安全扫描,编码时进行安全扫描的企业占比同样为59%,可见在开发阶段进行安全扫描的比例比较高。

最常用的应用程序安全解决方案部分,静态应用程序安全测试最多,占比61%。动态应用程序安全测试,由于耗时比较长,有58%的公司进行这一安全测试;同时,软件构成分析测试占比58%;56%的企业实现API安全扫描。

![]()

在互联网、Docker Hub上,JFrog调研了212个CVE样本。JFrog安全团队将85%的严重CVE和73%的高危CVE下调了评级。这就意味着研发团队能够避免付出额外精力关注漏洞分数虚高的漏洞。

JFrog在Docker Hub里分析了最受欢迎的100个镜像,比如Tomcat、 Ubuntu、GDK这样的下载量最高的镜像,里面有很多CVSS评分的漏洞。在这些CVE漏洞中,JFrog的研究团队发现了一个重大的数据,74%的漏洞实际是不可被利用的。这74%经过JFrog扫描之后,显示这些漏洞可以被忽略,从而让研发从这些修复漏洞的工作中解放出来。

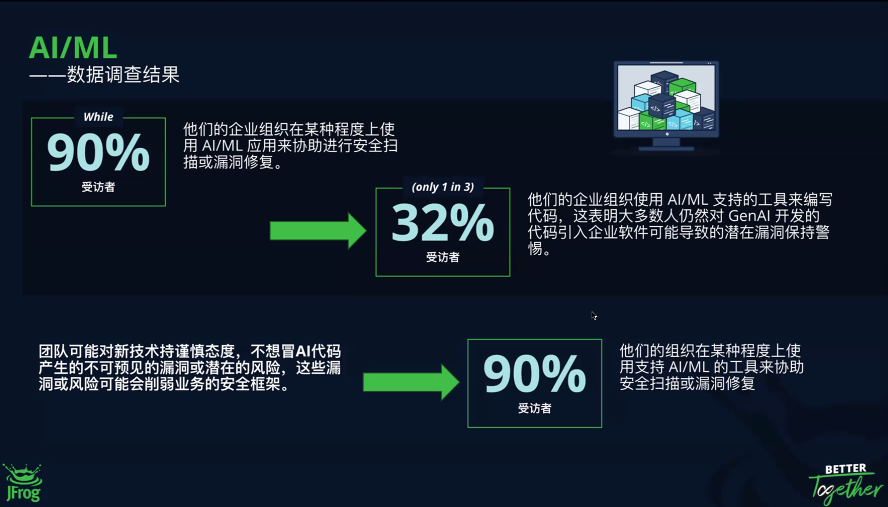

在对大模型AI领域进行调研时,90%的受访者表示他们的扫描工具支持AI;90%的受访者在某种程度上支持AI的工具来协助安全扫描或修复;有32%的企业受访者表示大部分人可以使用Copilot等AI工具协助代码生成,但是因为ChatGPT产生的代码可能存在漏洞,超过半数的人认为这一行为有风险。

![]()

据介绍,现在已有黑客利用大模型的“幻觉”来植入恶意的包。黑客会预置一些恶意的包,上传到Docker Hub去训练GPT模型,告诉它在回答什么样问题的时候,去把答案的链接指向恶意包的位置。通过这样的恶意训练,用户在不知情的情况下,可能会被引导到恶意的仓库去下载这个恶意包,因此它是有风险的。

目前看来,AI大模型既能助力开发人员写代码,又因可能产生漏洞使全球软件供应链安全面临更大挑战,软件开发者抗风险能力受考验。