云栖号案例库:【点击查看更多上云案例】

不知道怎么上云?看云栖号案例库,了解不同行业不同发展阶段的上云方案,助力你上云决策!

案例背景

小打卡是国内最大的兴趣社群平台,每天能够产生上百万条新的内容。在这样超大的内容生产背景下,平台也面临着千人千面、内容分发上的巨大挑战。依托于阿里云MaxCompute,小打卡已经完成了TB级数据仓库方案。在此基础之上,结合机器学习PAI,实现了千人千面的推荐算法。本文将从技术选型、推荐架构、开源算法结合三个方面,讲述小打卡在MaxCompute上的一些实战经验。

为什么选择MaxCompute

MaxCompute是阿里云完全自研的一种快速、完全托管的TB/PB级的数据仓库解决方案,并且上层提供了DataWorks以实现工作流可视化开发、调度运维托管的一站式海量数据离线加工分析平台。除此之外,MaxCompute还与阿里云服务的多个产品集成,比如:

- 数据集成

完成MaxCompute与各种数据源的相互同步

- 机器学习PAI

实现直接基于MaxCompute完成数据处理、模型训练、服务部署的一站式机器学习

- QuickBI

对MaxCompute表数据进行报表制作,实现数据可视化分析

- 表格存储

阿里云自研的分布式NoSQL数据存储服务,MaxCompute离线计算的机器学习特征可以很方便的写入,以供在线模型使用。

相反,如果完全基于开源的Hadoop框架,从服务部署、可视化开发、代码管理、任务调度、集群运维等多方面,均需要大量的人力来开发与维护。基于MaxCompute,不论是人力成本,还是计算成本,还是运维成本,都已经降到了最低。

小打卡推荐系统架构

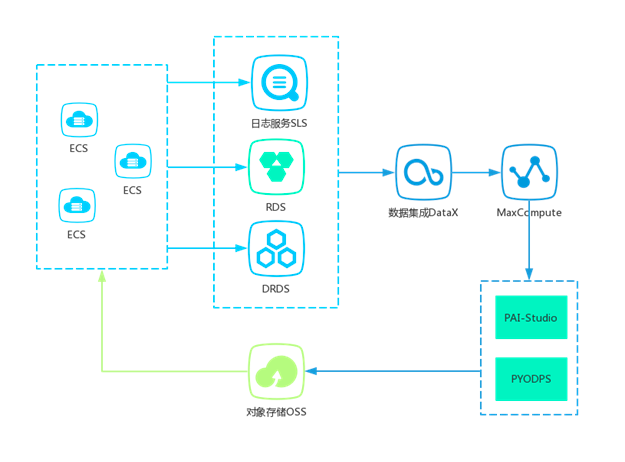

小打卡的整个技术架构完全基于阿里云实现。埋点日志、业务数据分别由日志服务、RDS/DRDS承担收集和存储任务,通过数据集成同步到MaxCompute,之后便可基于PAI实现机器学习任务。其物理结构如下图所示。

![image image]()

机器学习PAI-Studio提供了数据预处理、特征工程、机器学习、深度学习、文本分析等丰富的机器学习组件,并且计算结果直接以宽表的形式存储于MaxCompute,极大的减轻了算法开发的工作量。

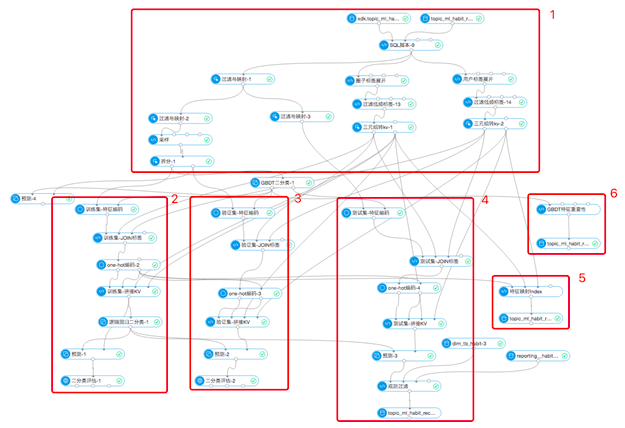

我们基于PAI,实现了GBDT+LR算法,任务流如下图所示:

![image image]()

图中采用了丰富的PAI机器学习组件,主要包括6个部分:1-特征加工,2-训练模型,3-验证模型,4-测试模型,5-特征映射关系,6-特征重要性。开发完成后,可以加载到DataWorks中进行调度,运行完成会生成GBDT模型文件(pmml格式)、LR模型文件(pmml格式)、特征映射表,以便线上使用。由于我们后端主服务均在华北1,而PAI的模型在线部署在华东2,存在着公网访问问题,因此我们暂时无法使用PAI的模型在线部署功能,建议大家将两部分放在同一地域。鉴于此问题,幸好PAI的同学提供了将pmml模型文件写入oss的脚本,相关代码如下:

pai -name modeltransfer2oss

-DmodelName=xlab_m_GBDT_LR_1_1806763_v0

-DossPath="oss://test.oss-cn-shanghai-internal.aliyuncs.com/model/"

-Darn="acs:ram::123456789:role/aliyunodpspaidefaultrole"

-Doverwrite=true

-Dformat=pmml;

因此我们可以将pmml文件写入oss,然后后端服务读取pmml模型文件,自行创建模型在线预测。对于解析pmml模型文件,虽然有开源项目支持pmml模型加载,但是由于pmml过于通用,导致性能存在问题,因此我们定制化自解析模型。

如何结合开源算法

遗憾的是,PAI提供的机器学习算法仍然有限,如果想要使用开源项目来实现算法部分怎么办呢?我们对此也做了尝试,我们则结合MaxCompute+PAI+xLearn实现了基于FM算法的CTR预估模型。

由于xLearn需要在单独的一台ECS上执行,那么问题就来了:

1.如何从MaxCompute拉取数据,又如何上传结果?

MaxCompute提供了pyodps,可以很方便的使用python读写MaxCompute的离线表。因此,我们在python循环检测PAI任务的特征工程结果表是否生成完成。生成完成,则启动下载数据和算法训练任务。算法执行结束后,则将模型文件通过pyodps写入MaxCompute,当然也可以使用tunnel工具来完成。

2.如何周期性调度?DataWorks上的任务与ECS上的任务,如何形成依赖关系?

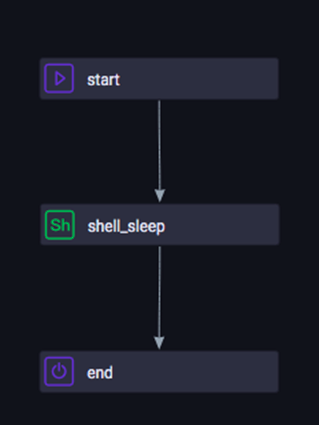

对于拉取,我们通过循环实现了python与MaxCompute表的依赖关系,那么算法训练完成了,DataWorks的下游怎么知道呢?幸好,DataWorks提供了do-while控制流组件,我们可以在while条件中检测模型表相应分区的数据是否存在了,在 do 组件中,则采用shell执行sleep。跳出while后,则下游也开始正常执行了。之后便可以将模型和映射文件同步写入到oss,以供后端使用了。其中 do-while 结构如下:

![image image]()

总结

除了排序算法之外,我们还使用PAI和SQL,分别实现了item_cf和user_cf的召回算法,整个推荐系统完全打通。基于MaxCompute利用DataWorks调度系统,我们实现了推荐算法模型的每日自动更新。相比于模型不更新,我们对比了60天前的模型,新的模型效果提升10%左右。

云栖号案例库:【点击查看更多上云案例】

不知道怎么上云?看云栖号案例库,了解不同行业不同发展阶段的上云方案,助力你上云决策!