介绍

在博客:Java爬虫之下载IMDB中Top250电影的图片中我们实现了利用Java爬虫来下载图片,但是效率不算太高。本次分享将在此基础上,利用多线程,提高程序运行的效率。

思路

本次分享建立在博客Java爬虫之下载IMDB中Top250电影的图片上,总体的爬虫思路没有变化,只是在此基础上引入多线程。多线程的思路如下:

- Java的每个任务类必须实现Runnable接口,因此,我们将新建ImageDownload类来实现Runnable接口。ImageDownload类的构造函数的参数有: url:网站的网址, dir: 图片储存目录。并在run()方法中实现将网页中的图片下载到本地。

- 在主函数中,调用ImageDownload类,利用多线程实现爬虫下载,提高运行效率。

程序

ImageDownload类的代码完整如下:

package wikiScrape;

import java.io.File;

import java.io.IOException;

import java.net.MalformedURLException;

import java.net.URL;

import java.net.URLConnection;

import org.apache.commons.io.FileUtils;

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import org.jsoup.select.Elements;

public class ImageDownload implements Runnable{

private String url;

private String dir;

public ImageDownload(String url, String dir) {

this.url = url;

this.dir = dir;

}

@Override

public void run(){

URL urlObj = null;

try{

urlObj = new URL(url);

}

catch(MalformedURLException e){

System.out.println("The url was malformed!");

}

URLConnection urlCon = null;

try{

urlCon = urlObj.openConnection();

Document doc = Jsoup.parse(urlCon.getInputStream(), "utf-8", url);

Elements elems = doc.getElementsByClass("ss-3 clear");

Elements pic_block = elems.first().getElementsByTag("a");

for(int i=0; i<pic_block.size(); i++) {

String picture_url = pic_block.get(i).getElementsByTag("img").attr("src");

String picture_name = pic_block.get(i).getElementsByClass("bb").text()+".jpg";

download(picture_url, dir, picture_name);

System.out.println("第"+(i+1)+"张图片下载完毕!");

}

}

catch(IOException e){

System.out.println("There was an error connecting to the URL");

}

}

public static void download(String url, String dir, String filename) {

try {

URL httpurl = new URL(url);

File dirfile = new File(dir);

if (!dirfile.exists()) {

dirfile.mkdirs();

}

FileUtils.copyURLToFile(httpurl, new File(dir+filename));

}

catch(Exception e) {

e.printStackTrace();

}

}

}

主函数ImageScraper.java的代码如下:

package wikiScrape;

import wikiScrape.ImageDownload;

import java.util.ArrayList;

import java.util.concurrent.*;

import java.util.Date;

public class ImageScraper {

public static void main(String[] args) {

Date d1 = new Date();

System.out.println("爬虫开始......");

ArrayList<String> urls = new ArrayList<String>();

urls.add("http://www.imdb.cn/IMDB250/");

for(int i=2; i<=10; i++) {

urls.add("http://www.imdb.cn/imdb250/"+ Integer.toString(i));

}

String dir = "E://log/";

ExecutorService executor = Executors.newCachedThreadPool();

for(int i=0; i<10; i++) {

executor.execute(new ImageDownload(urls.get(i), dir));

}

executor.shutdown();

while(!executor.isTerminated()) {

}

System.out.println("程序运行完毕!");

Date d2 = new Date();

long seconds = (d2.getTime()-d1.getTime())/1000;

System.out.println("一共用时: "+seconds+"秒.");

}

}

运行

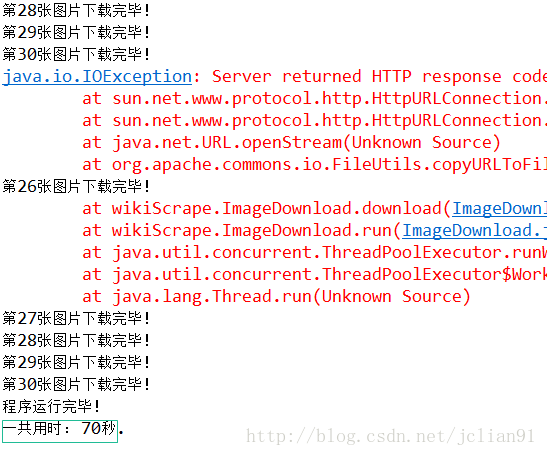

运行上述主函数,结果如下:

![程序运行结果]()

一共也是下载了244张图片,运行结果与博客:

Java爬虫之下载IMDB中Top250电影的图片中的结果一模一样,但是时间却少了一半!可见利用多线程来写爬虫效率相当高!

本次分享到此结束,欢迎大家交流~~