中国AI初创企业月之暗面(Moonshot AI)旗下Kimi团队发布了重磅技术论文《Attention Residuals: Rethinking depth-wise aggregation》,提出了一项名为Attention Residuals(注意力残差,简称AttnRes)的全新深度网络架构组件。

该工作从根本上重构了Transformer模型在深度方向上的信息流动方式,用softmax注意力机制替代了自2015年ResNet诞生以来沿用十年的传统均等残差连接。这一突破性进展不仅引发了学术界的广泛关注,更获得了特斯拉CEO埃隆·马斯克的亲自点赞,OpenAI推理模型之父Jerry Tworek也公开表示这一研究将引发深度学习2.0时代的到来。

技术背景:传统残差连接的局限性

理解Attention Residuals的创新价值,需要先回顾深度学习领域中残差连接的发展历程与固有局限。自2015年ResNet架构诞生以来,这种将输入直接加到输出上的简单逻辑——即y = x + f(x)的残差连接方式——便成为了几乎所有神经网络架构的基础组件。这种设计使得深层网络的训练变得更加稳定,有效缓解了梯度消失问题,是深度学习发展史上的里程碑式突破。

然而,随着大模型向更深、更强方向演进,研究者们逐渐发现这种传统残差连接存在两个显著的技术瓶颈。第一个问题是“信息稀释”现象:残差连接采用固定单位权重的均匀聚合策略,导致浅层特征在向深层传递时,其相对贡献度随深度线性衰减。这意味着当信息从第一层传递到第一百层时,已经被后面九十九层的信息层层冲淡,深层网络难以直接利用底层的原始表示能力。

第二个问题是“隐藏状态爆炸”:为了在不断累加的残差流中维持信号强度,深层模块往往需要输出模长更大的激活值。这种隐状态的无序扩张不仅破坏了数值稳定性,还导致梯度分布不均,增加了训练过程中的系统性风险。对于现代大语言模型动辄数百层的深度架构来说,这两个问题的影响尤为突出。

创新突破:注意力驱动的深度聚合

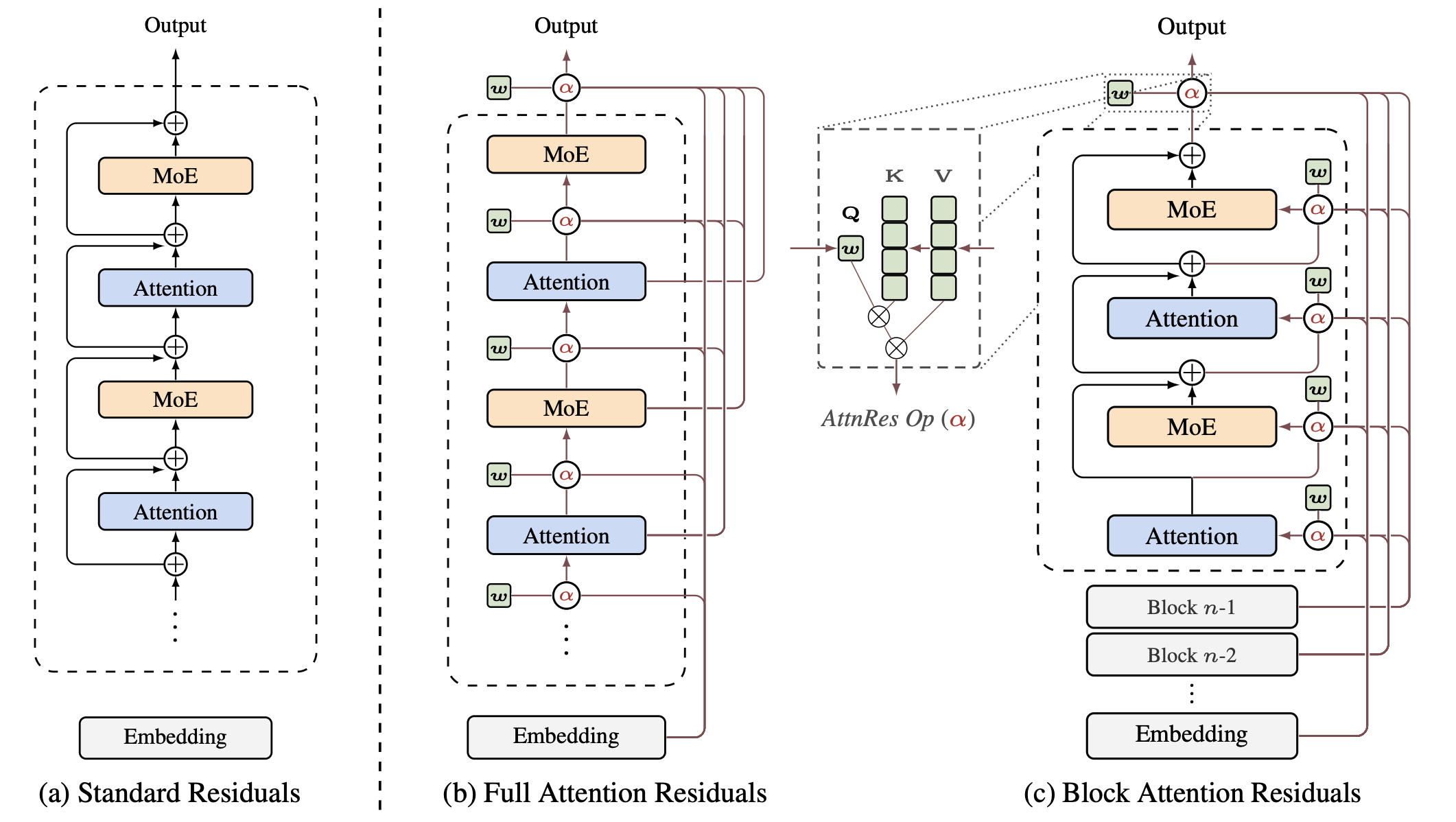

月之暗面Kimi团队提出的Attention Residuals架构创造性地将注意力机制引入深度方向的信息聚合过程,从而彻底改变了传统残差连接的工作方式。这一创新的核心思想是将时间与深度视为对偶关系,通过学习到的、依赖输入的注意力机制来取代标准的深度递归。

![]()

具体而言,Attention Residuals不再简单地将每一层的输出以固定权重相加,而是通过softmax注意力机制来动态决定每一层应该对最终输出贡献多少信息。这种设计使得网络能够根据具体的输入内容,自适应地决定哪些层的特征更加重要,哪些层的信息可以相对忽略。在传统残差连接中,所有层以相等的权重被聚合;而在Attention Residuals中,网络学会了“什么时候应该更信任浅层的特征,什么时候应该更依赖深层的表示”。

论文中提出的Block AttnRes(分块注意力残差)方案更是解决了实际应用中的计算复杂度问题。如果对100层网络的每一层都进行完整的注意力计算,复杂度将达到O(L²),这在实际训练中是不可接受的。Kimi团队提出的分块压缩策略有效地降低了这一计算开销,使得这一创新架构能够在实际的大规模模型中部署。

实验验证:显著的性能提升

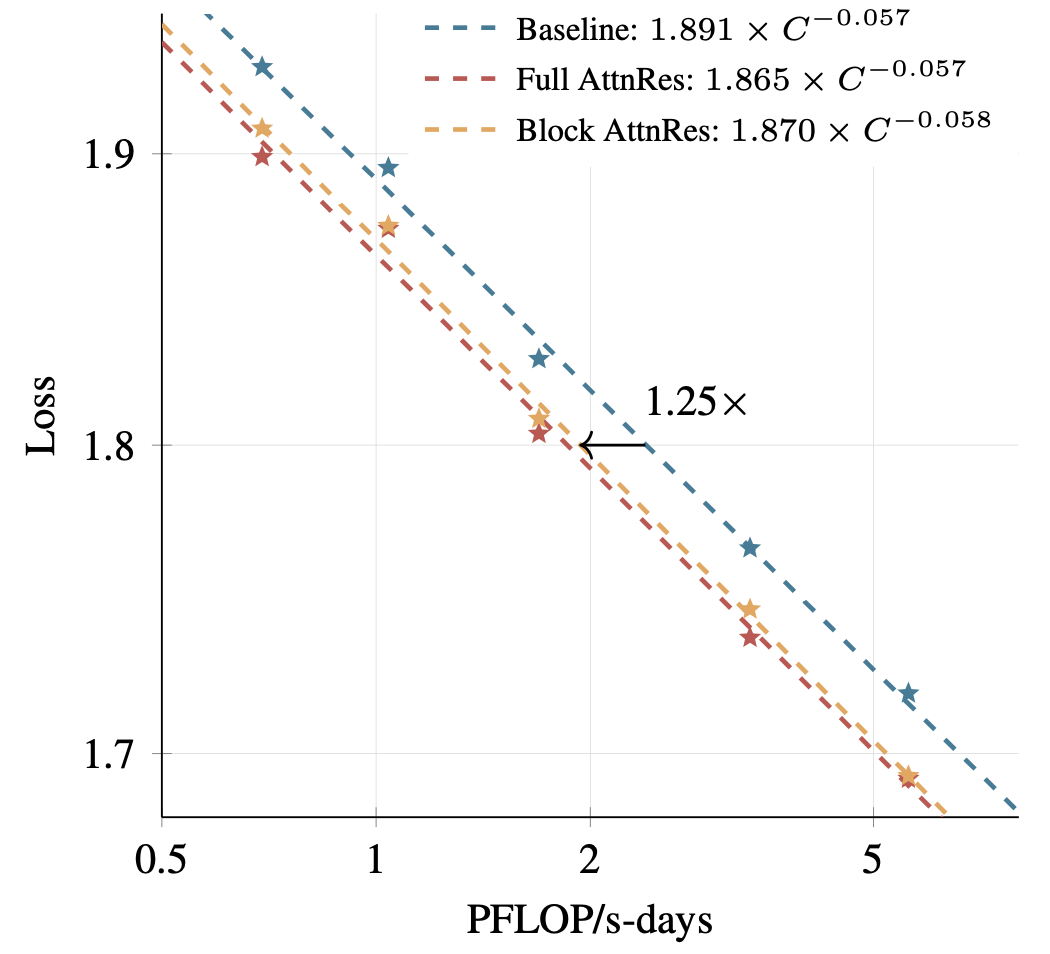

根据论文公布的实验结果,Attention Residuals架构在多个维度上展现出了显著的性能优势。在计算效率方面,该架构在480亿参数的MoE(混合专家)大模型上实现了1.25倍的计算效率提升,这意味着在相同的计算资源下可以获得更强的模型能力,或者在保持性能的同时大幅降低训练和推理成本。

![]()

更值得关注的是,这一架构改进并非以牺牲模型能力为代价。恰恰相反,通过更有效的深度信息聚合,模型能够更好地利用各层的特征表示,从而在多项基准测试中取得了更优的表现。这种“既快又好”的特性对于大模型的产业化应用具有重要的实际价值。

行业反响:巨头纷纷点赞

这一研究成果发布后迅速引发了人工智能行业的广泛关注。特斯拉和SpaceX CEO埃隆·马斯克在社交平台X上亲自点赞了这篇论文,并评论称“Impressive work”(令人印象深刻的工作)。作为同时在航天火箭和电动汽车领域推动技术变革的标志性人物,马斯克的认可无疑为这项技术增添了不少分量。

更令业界震惊的是OpenAI的反应。据报道,OpenAI“推理模型之父”Jerry Tworek——他主导了o1/o3系列推理模型、Codex编程模型以及GPT-4的STEM能力开发——公开表示这一论文给他带来了深刻启发,认为业界应当重新思考之前的一切,深度学习2.0的时代即将到来。一位来自OpenAI核心团队如此高度的评价,充分说明了Attention Residuals架构的创新价值。

此外,多位国际知名AI研究者也在社交媒体上表达了对这一工作的认可。有科技博主详细拆解了这篇论文的技术贡献,认为它“动了十一年没人敢碰的东西”——即残差连接这一基础架构组件。这种突破性创新之所以迟迟没有人尝试,正是因为其风险极高:作为整个深度学习领域的基石之一,任何对残差连接的修改都可能对模型训练带来系统性影响。

项目地址:https://github.com/MoonshotAI/Attention-Residuals