写爬虫防止被封的关键有以下几点:

● 伪装请求报头(request header)

● 减轻访问频率,速度

● 使用代理IP

一般第一点都能做到,第二点减轻访问频率就会大大增加任务时间,而使用代理就能在不增加任务时长避免被封的关键(实际情况却是任务时间因为代理的使用而增加的,但这里不细说,知道就好)。

下面我们从 国内高匿代理IP 获得代理IP数据。

import os

import time

import requests

from bs4 import BeautifulSoup

#num获取num页 国内高匿ip的网页中代理数据

def fetch_proxy(num):

#修改当前工作文件夹

os.chdir(r'/Users/apple888/PycharmProjects/proxy IP')

api = 'http://www.xicidaili.com/nn/{}'

header = {

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_3) AppleWebKit/'

'537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36'}

fp = open('host.txt', 'a+', encoding=('utf-8'))

for i in range(num+1):

api = api.format(1)

respones = requests.get(url=api, headers=header)

soup = BeautifulSoup(respones.text, 'lxml')

container = soup.find_all(name='tr',attrs={'class':'odd'})

for tag in container:

try:

con_soup = BeautifulSoup(str(tag),'lxml')

td_list = con_soup.find_all('td')

ip = str(td_list[1])[4:-5]

port = str(td_list[2])[4:-5]

IPport = ip + '\t' + port + '\n'

fp.write(IPport)

except Exception as e:

print('No IP!')

time.sleep(1)

fp.close()

我们准备抓 国内高匿代理IP网 的十个页面的代理

fetch_proxy(10)

![86c56a9b62c6a4518f5cce7ba6cebc2bf24fcf9d]()

当前工作目录下的文件,你看!!有host.txt

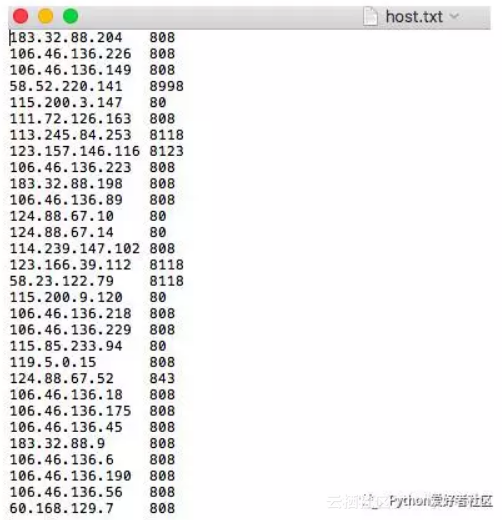

![82cee61dee47eaa2dfa344d01c79862ce4cc6a77]()

打开host.txt,收集到了很多代理IP

但是有代理IP还不行,因为我们不知道这代理能不能用,是否有效。

下面我们用百度网进行检验(大公司不怕咱们短时间内高频率访问),上代码:

import os

import time

import requests

from bs4 import BeautifulSoup

def test_proxy():

N = 1

os.chdir(r'/Users/apple888/PycharmProjects/proxy IP')

url = 'https://www.baidu.com'

fp = open('host.txt', 'r')

ips = fp.readlines()

proxys = list()

for p in ips:

ip = p.strip('\n').split('\t')

proxy = 'http:\\' + ip[0] + ':' + ip[1]

proxies = {'proxy': proxy}

proxys.append(proxies)

for pro in proxys:

try:

s = requests.get(url, proxies=pro)

print('第{}个ip:{} 状态{}'.format(N,pro,s.status_code))

except Exception as e:

print(e)

N+=1

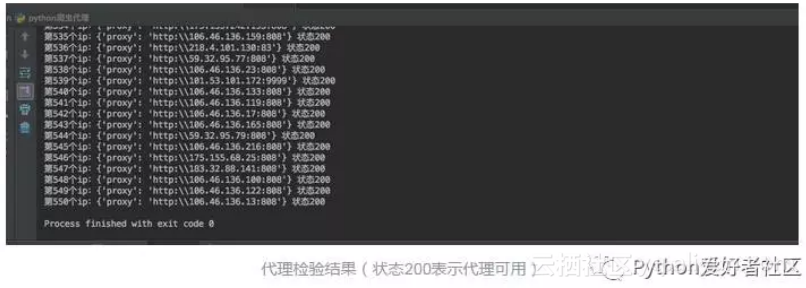

运行该代码,效果如下

![8061f9392c974737de6b860e45bf3741714144fd]()

代理Ip池生成函数

#生成代理池子,num为代理池容量

def proxypool(num):

n = 1

os.chdir(r'/Users/apple888/PycharmProjects/proxy IP')

fp = open('host.txt', 'r')

proxys = list()

ips = fp.readlines()

while n<num:

for p in ips:

ip = p.strip('\n').split('\t')

proxy = 'http:\\' + ip[0] + ':' + ip[1]

proxies = {'proxy': proxy}

proxys.append(proxies)

n+=1

return proxys

下面开始爬豆瓣电影的电影数据,我们要获取 电影名、演员、评分。

电影标签页 https://movie.douban.com/tag/

![88b674f7efebca22ce19241916265cbb109e4b8e]()

烂片详情页https://movie.douban.com/tag/烂片

![12b44bdcc7c32d3bd81a06d36ffd5c1517d25af2]()

烂片详情页

我们就只爬烂片标签页的部分数据吧,网页链接规律如下

第一页https://movie.douban.com/tag/烂片?start=0

第二页https://movie.douban.com/tag/烂片?start=20

第三页https://movie.douban.com/tag/烂片?start=40

开始上代码

def fetch_movies(tag, pages, proxys):

os.chdir(r'/Users/apple888/PycharmProjects/proxy IP/豆瓣电影')

url = 'https://movie.douban.com/tag/爱情?start={}'

headers = {

'User-Agent': 'Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/'

'537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Mobile Safari/537.36'}

#用csv文件保存数据

csvFile = open("{}.csv".format(tag), 'a+', newline='', encoding='utf-8')

writer = csv.writer(csvFile)

writer.writerow(('name', 'score', 'peoples', 'date', 'nation', 'actor'))

for page in range(0, pages*(20+1), 20):

url = url.format(tag, page)

try:

respones = requests.get(url, headers=headers, proxies=random.choice(proxys))

while respones.status_code!=200:

respones = requests.get(url, headers=headers, proxies=random.choice(proxys))

soup = BeautifulSoup(respones.text, 'lxml')

movies = soup.find_all(name='div', attrs={'class': 'pl2'})

for movie in movies:

movie = BeautifulSoup(str(movie), 'lxml')

movname = movie.find(name='a')

# 影片名

movname = movname.contents[0].replace(' ', '').strip('\n').strip('/').strip('\n')

movInfo = movie.find(name='p').contents[0].split('/')

# 上映日期

date = movInfo[0][0:10]

# 国家

nation = movInfo[0][11:-2]

actor_list = [act.strip(' ').replace('...', '') for act in movInfo[1:-1]]

# 演员

actors = '\t'.join(actor_list)

# 评分

score = movie.find('span', {'class': 'rating_nums'}).string

# 评论人数

peopleNum = movie.find('span', {'class': 'pl'}).string[1:-4]

writer.writerow((movname, score, peopleNum, date, nation, actors))

except:

continue

print('共有{}页,已爬{}页'.format(pages, int((page/20))))

执行上述写好的代码

import time

start = time.time()

proxyPool= proxypool(50)

fetch_movies('烂片', 111, proxyPool)

end = time.time()

lastT = int(end-start)

print('耗时{}s'.format(lastT))

Perfect

原文发布时间为:2018-11-16

本文来自云栖社区合作伙伴“灯塔大数据”,了解相关信息可以关注“灯塔大数据”。