![]()

提到美团,你可能会想到穿梭在大街小巷的黄衣骑手,以及手机里那个“送啥都快”的生活小助手。

而这一次,美团选择将“小助手”背后的“超级大脑”开源!

就在上周日(8.31)凌晨,美团正式发布并开源了千亿参数大模型 LongCat-Flash。仅开源一天,LongCat-Flash 便登上了 Hugging Face 热榜!这款模型在仅激活少量参数、推理速度更快的情况下,性能直接看齐业界顶级水平,并在指令遵循(IFEval)、智能体工具使用(τ2-Bench)等多项评测中表现优异,超越同类模型。

![]()

Hugging Face 地址:huggingface.co/meituan-longcat/LongCat-Flash-Chat

GitHub 地址:github.com/meituan-longcat/LongCat-Flash-Chat

现在,你可以直接前往 longcat.ai 免费在线体验。你边玩,我边讲。

一、快成一道闪电

LongCat-Flash 最令我印象深刻的,就是它的“快”!

虽然拥有高达 5600 亿的总参数量,但推理速度却能达到惊人的 100 Tokens/s(TPS)。

这意味着,模型输出内容时,不再是“挤牙膏”式地一段字一段字蹦,而是像闪电一样刷刷刷地给出结果。

![]()

根据官方数据,LongCat-Flash 在 H800 上可以实现 100 Tokens/s 的生成速度,输出成本低至 5 元/百万 Token,真正做到了“又快又省”。

二、“偷懒”的艺术

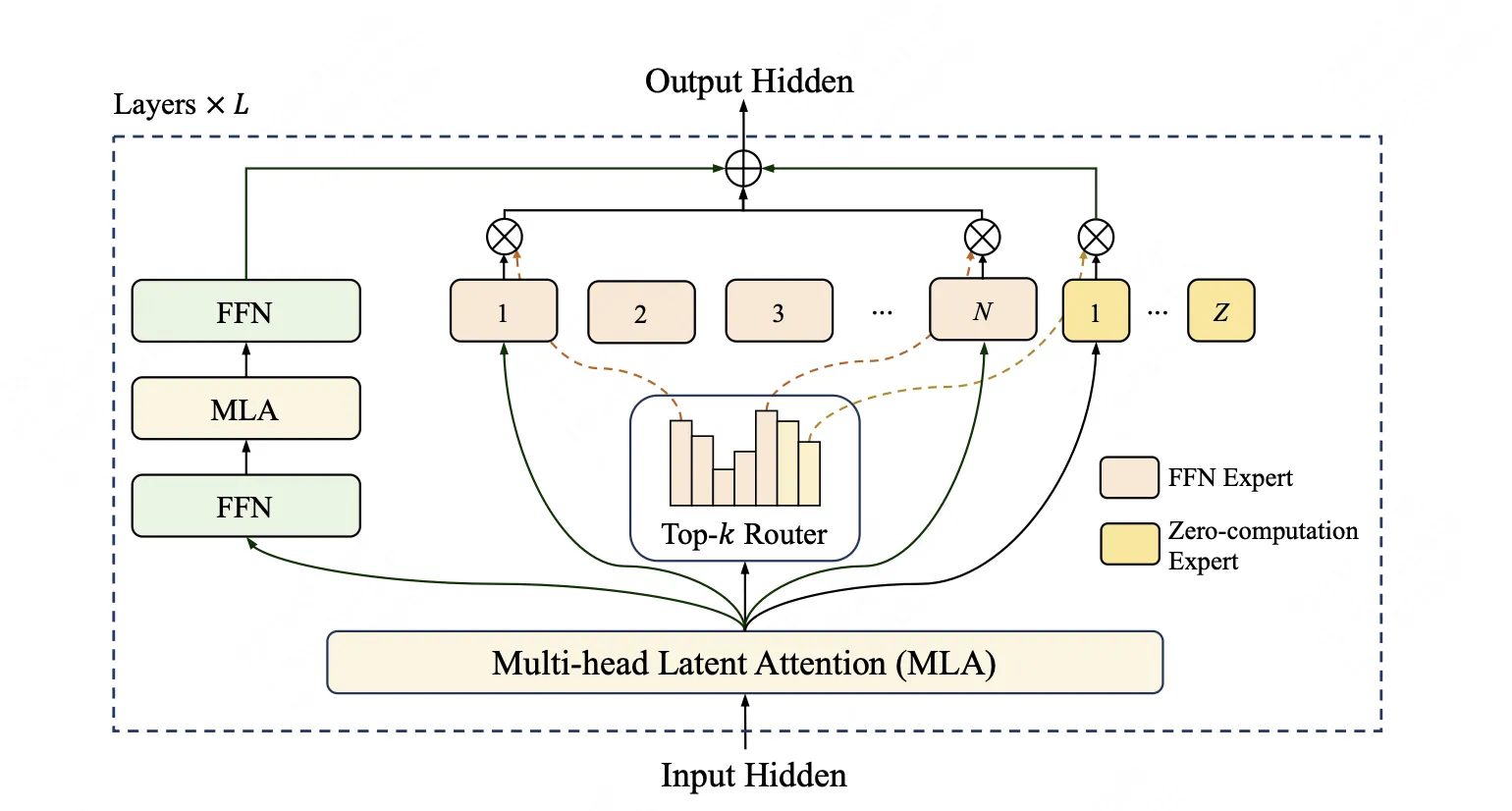

这么快的速度是怎么来的?LongCat-Flash 基于两个核心技术,让它既有“大块头”的智慧,又有“小身板”的敏捷。

![]()

零计算专家(Zero-computation Experts)

咱们都知道,不是所有问题都一样难,LongCat-Flash 也懂这个道理!

它引入了一种“零计算专家”机制,就像学霸做卷子,简单的送分题一扫而过,把时间都花在压轴的大题上。通过这种算力按需分配机制,每个 Token 可根据上下文需求仅激活 18.6B~31.3B 的少量参数,实现算力的高效利用,大大提升了效率。

更快的 MoE(Shortcut-connected MoE)

传统模型工作起来,经常是“一步做完再做下一步”,中间会有等待的空窗期,浪费时间。LongCat-Flash 采用了 ScMoE 架构,彻底优化了内部工作流。

这好比一条更快的流水线,上一个工序的零件还没完全打包好,下一个工序就已经开始并行处理了,让计算和通信无缝衔接。这样一来,无论是训练还是推理,整体效率都得到了巨大提升。

三、成绩单怎么样?

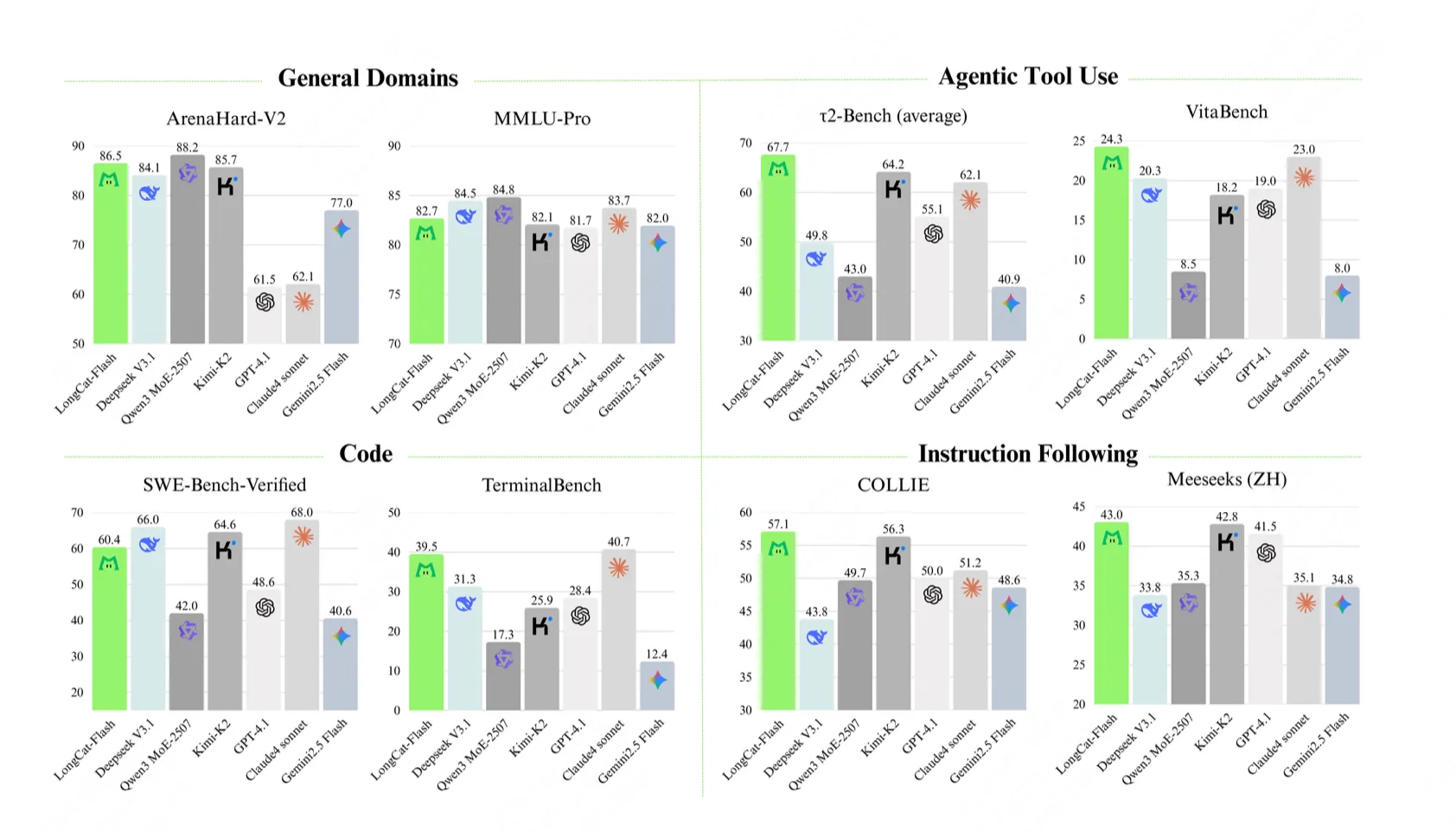

LongCat-Flash 的性能在各大基准测试(Benchmark)中也相当能打。

它不仅在通用能力上看齐了 DeepSeek-V3.1、Kimi-K2 等业界顶尖模型,更是在智能体工具使用(Agentic Tool Use)方面表现出了明显的优势。

![]()

在 τ²-Bench 和美团自家的真实业务场景测试 VitaBench 中,LongCat-Flash 都取得了最高分(SOTA),甚至超越了一些参数更多的模型。

四、AI Agent 将是下一代“超级助手”

如今的 AI,早已不再满足于仅陪你聊天,而是在向能订票、分析数据、操作软件等多方面进化,真正成为你的智能生活助手——这就是 Agent 时代。

美团 LongCat-Flash 正是瞄准了这一趋势。凭借极快的输出速度、卓越的指令遵循能力,以及强大的工具调用性能,让开发者能够更加轻松地构建出高效、有用的 AI Agent 应用,实现真正智能的生活助手体验。

坦率地讲,美团此时开源大模型的时间上确实稍晚于其他“玩家”,但我注意到美团 LongCat-Flash 的发力点非常明确——专注于模型在 Agent 场景下的可用性,聚焦解决 AI 技术“如何真正有用”的问题。这种投入绝不是“玩票”,而是面向未来的战略选择。

Hugging Face 地址:huggingface.co/meituan-longcat/LongCat-Flash-Chat

GitHub 地址:github.com/meituan-longcat/LongCat-Flash-Chat

在线体验:longcat.ai

或许,下一代真正改变我们生活的超级助手,正在悄然走近我们。