这几天GPT-3成为人工智能甚至整个科技圈最为热门的话题。作为著名人工智能科研公司 OpenAI 开发的文字生成 (text generation) 人工智能,GPT-3的相关论文在2020年5月份就已经发表,由于使用了45TB的数据,并采用了天文数字级别的1,750亿参数量而引起极大轰动。现在,GPT-3开始开放申请,获得资格的人将通过API来使用GPT-3。如果说软件定义一切,那么API就在定义软件。一些人在使用了GPT-3之后,对其赞不绝口:嗯,真香!

比如用GPT3做的这个页面生成器,只需要输入“给我一个长得像西瓜的按钮”,GPT3就会很快输出一个看上去真的很像西瓜的按钮。

![GPC-3.gif GPC-3.gif]()

从目前的应用来说,GPT-3 更像是一个更懂你的新的搜索引擎,传统的搜索引擎只是将信息归类后进行展现,而GPT-3 则是将信息进行了加工。仅就45TB的数据而论,如果一部电影按照2G大小来算的话,那么45T的数据相当于23000多部电影,每次GPT-3都相当于将这23000多部电影看一遍,然后写出一篇“影评”。

而写出这篇“影评”不是依靠作者的构思,而是依靠算力。算力可以看作是单位时间内的计算能力。从计算机诞生之日起,人们对算力的追求就没有停歇过,1958年集成电路的出现让算力实现了一次质的飞跃,近年来,随着CPU、GPU、NPU等单元部件算力的不断增强,算力更是得以成为数字经济时代的核心引擎之一。

做个比喻,如果说算力是心脏,那么数据就是血液,两者之间还需要一个良好的血液循环系统予以保证,而存储系统就可以看作这样的一个血液循环系统。那么,应该如何更好的构建这个血液循环系统呢?

首先,为了支撑强大的算力需要能够支持大规模的数据吞吐量;其次,需要更低的数据读写延迟以提升计算速度,再次,需要具有足够的弹性,保证算力峰值到来时数据容量的随时扩容。

![人工智能-商业化产品模型版.png 人工智能-商业化产品模型版.png]()

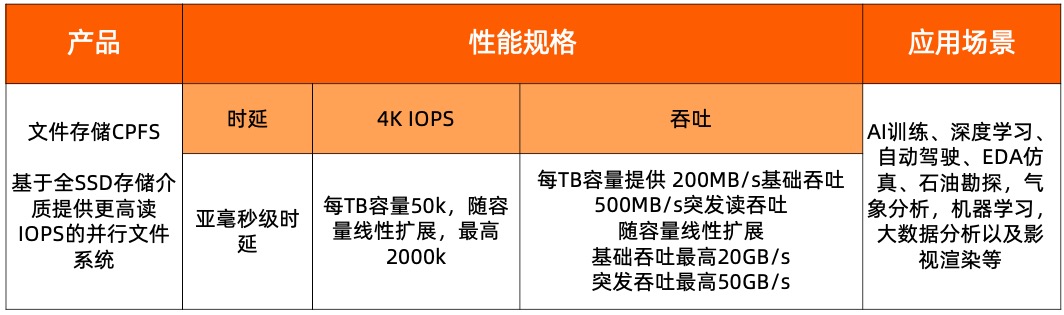

如果从以上角度出发,那么一个适当的选择就是文件存储。以阿里云文件存储CPFS (Cloud Parallel File Storage)为例,CPFS是一个可完全托管、可扩展的并行文件存储系统,针对高性能计算场景的性能要求进行了深度优化,提供对数据毫秒级的访问和高聚合I/O、高IOPS的数据读写请求,可以用于AI深度训练、自动驾驶、基因计算、EDA仿真、石油勘探、气象分析、机器学习、大数据分析以及影视渲染等业务场景中。

![CPFS性能.jpg CPFS性能.jpg]()

首先, CPFS具有超高吞吐和IOPS。采用分布式的并行架构,数据条带化后均匀分布在存储集群上,可以实现计算节点并行访问,提供数百GB的吞吐和千万级的IOPS以及亚毫秒级时延;

其次,CPFS弹性可扩展。CPFS支持在线的扩容,由于所有数据均以条带化的方式存储并且支持扩容以后的自动负载平衡,可满足性能的线性增长并且即时利用扩容节点的吞吐和存储能力,满足业务增长需要的更多容量与性能的诉求。

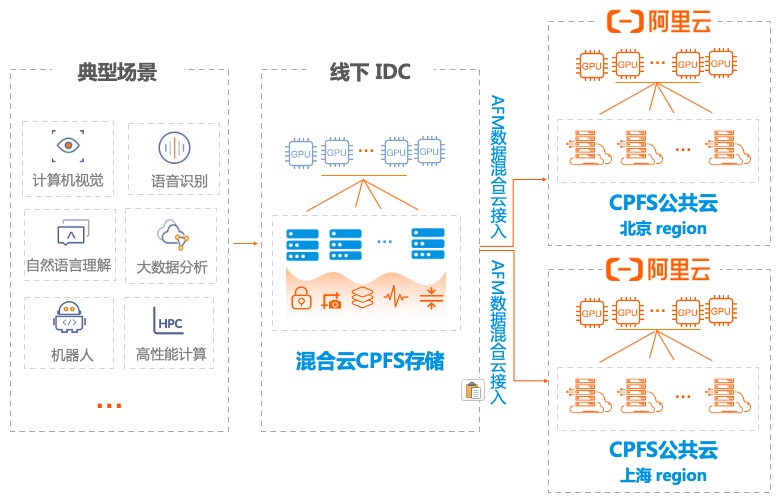

目前CPFS已经在公共云和混合云环境中有了广泛的应用。

以阿里云弹性高性能计算云平台HPCaaS为例。该平台支持基于阿里云ECS、EGS弹性计算实例快速构建任意规模的并行计算集群,并根据用户需求动态增删节点个数和存储规模。首先,该方案用户只需购买EHPC的集群实例,就可以立刻获得相应数目的ECS、EGS、文件存储和搭配的RDS,OSS等服务。其次,用户可以根据初期使用集群规模生成集群,在运行时通过集群调度动态伸缩集群数目。

而在混合云环境中,CPFS推出了混合云CPFS存储。爱笔(北京)智能科技有限公司正是利用了混合云CPFS存储解决方案,构建云上云下多级存储池架构,解决计算机视觉、语音识别、自然语言理解、大数据分析等技术场景下的数据存储与管理问题,从而将人工智能的线上与线下场景中进行融合,实现业务场景的数字化、智能化。

![爱笔.jpg 爱笔.jpg]()

目前,关于GPT-3的讨论还在继续, GPT-3母公司OpenAI的首席执行官Sam Altman也谦虚的说道“人工智能终将改变世界,但GPT3只是看到了一眼未来。我们还有很多事情要解决。”不过不可否认的是,大多数人对于GPT-3还是充满期待——人工智能的时代已经到来,而GPT-3的这一小步也许为整个人工智能行业迈出了一大步。